Устройство съемки изображения - RU2474850C1

Код документа: RU2474850C1

Чертежи

Описание

Область техники, к которой относится изобретение

Настоящее изобретение относится к устройству съемки изображения, в котором возможно AF (АФ, автофокусирование) на основе разности фаз в плоскости считывания изображения.

Уровень техники

Одно из свойств цифровых камер представляет собой возможность записи даты и времени съемки, установочных значений камеры, таких как величина управления экспозицией, и различной информации о фотографировании, такой как информация об объективе, вместе с данными изображения в файле снятого изображения.

Например, была предложена цифровая камера, в которой записывают точку детектирования фокуса, используемую при управлении фокусированием объектива для фотографирования, и когда файл изображения воспроизводят, положение точки детектирования фокуса отображают с наложением на изображение (см. выложенный японский патент № 2001-128044).

Кроме того, было предложено устройство съемки изображения, в котором возможно записывать множество выбранных точек детектирования фокуса и данные детектирования фокуса (например, информацию расстояния, обозначающую расстояние от плоскости считывания изображения до объекта) в таких точках детектирования фокуса (см. выложенный японский патент № 2005-12307).

Информация, обозначающая такие точки детектирования фокуса и данные детектирования фокуса, используется в различных приложениях, таких как определение, был ли снят объект так, как предполагалось пользователем, при манипуляциях с изображением, уравнением изображения и поиске.

Однако в решении, представленном в выложенном японском патенте № 2001-128044, имеется проблема, состоящая в том, что известна только точка детектирования фокуса, которая использовалась при управлении фокусированием, и данные детектирования фокуса не известны.

Кроме того, в выложенной заявке на японский патент № 2005-12307 данные детектирования фокуса, которые были записаны в записанном файле изображения, представляют собой данные, непосредственно предшествующие фактической съемке изображения, и хотя это не представляет проблему в случае неподвижного объекта, если объект движется, данные детектирования фокуса и изображение не полностью соответствуют из-за временной задержки от момента, когда будет выполнено детектирование фокуса, до момента съемки изображения; соответственно, существует проблема, состоящая в том, что трудно использовать данные детектирования фокуса.

Сущность изобретения

Настоящее изобретение было выполнено с учетом описанных выше вопросов, и в соответствии с настоящим изобретением точка детектирования фокуса и данные детектирования фокуса, которые были сняты в момент, в который была произведена съемка изображения, записывают в файле изображения, и такие данные могут использоваться пользователем.

Устройство съемки изображения в соответствии с настоящим изобретением включает в себя: датчик изображения, имеющий первую группу пикселей, которая выполняет фотоэлектрическое преобразование изображения объекта из первой области выходного зрачка, которая представляет собой часть общей области выходного зрачка фотообъектива, вторую группу пикселей, которая выполняет фотоэлектрическое преобразование изображения объекта из второй области выходного зрачка, которая отличается от первой области выходного зрачка, и третью группу пикселей, предназначенную для съемки, в которой происходит фотоэлектрическое преобразование изображения объекта из области выходного зрачка, которая включает в себя первую область выходного зрачка и вторую область выходного зрачка; модуль детектирования фокуса, который детектирует информацию фокуса фотообъектива путем выполнения расчета дефокусирования, используя первый сигнал изображения, полученный из первой группы пикселей, и второй сигнал изображения, полученный из второй группы пикселей; модуль обработки изображения, который преобразует данные снятого изображения, для которых было выполнено фотоэлектрическое преобразование с помощью, по меньшей мере, третьей группы пикселей датчика изображения и захват в файл изображения для записи и сохранения; и модуль записи данных, который записывает, в ассоциации с файлом изображения, сигналы, полученные из первой группы пикселей и второй группы пикселей, таким образом, что может быть выполнен расчет дефокусирования.

Другие свойства настоящего изобретения будут понятны из следующего описания примерных вариантов осуществления со ссылкой на приложенные чертежи.

Краткое описание чертежей

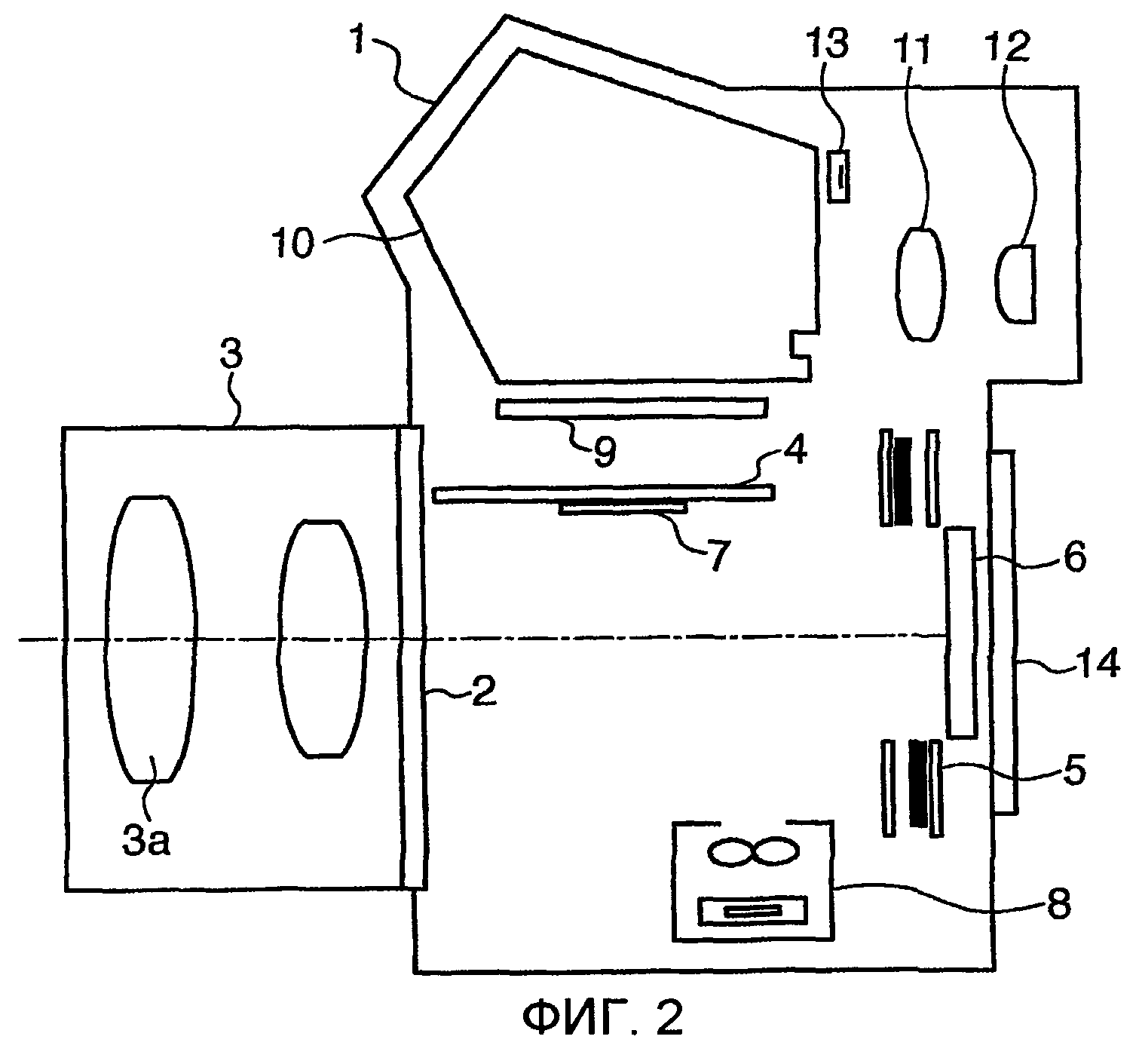

На фиг.1 показан вид в поперечном сечении цифровой камеры в соответствии с Вариантом 1 осуществления во время наблюдения через видоискатель.

На фиг.2 показан вид в поперечном сечении цифровой камеры в соответствии с Вариантом 1 осуществления во время предварительного просмотра и съемки.

На фиг.3 показана блок-схема, представляющая систему управления цифровой камерой, показанной на фиг.1.

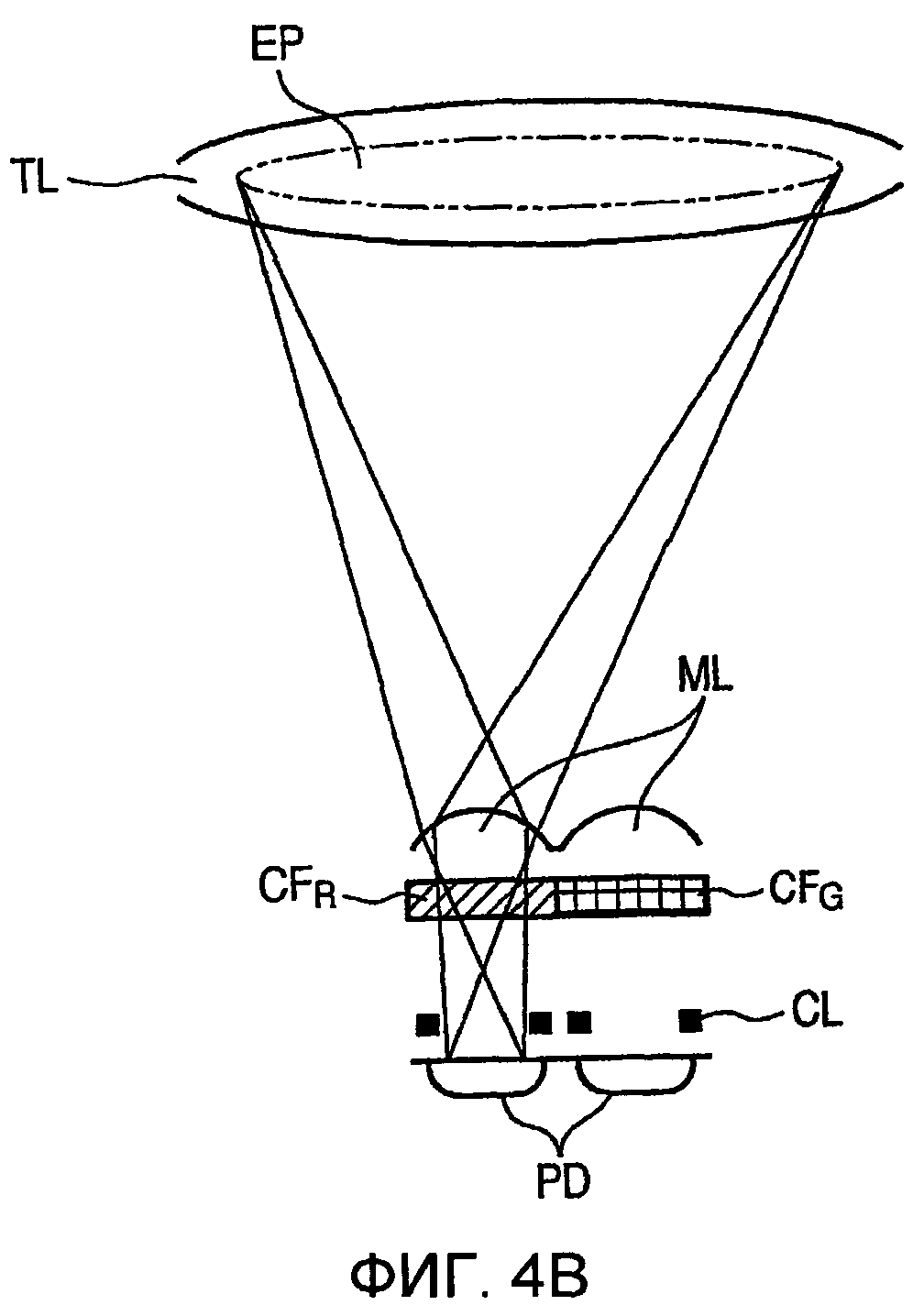

На фиг.4A и 4B показаны схемы, предназначенные для описания структуры пикселей съемки, которые используются в датчике изображения, показанном на фиг. 1.

На фиг.5A и 5B показаны схемы для описания структуры пикселей детектирования фокуса, которые используются в датчике изображения, показанном на фиг.1.

На фиг.6A и 6B показаны схемы для описания структуры других пикселей детектирования фокуса, которые используются в датчике изображения, показанном на фиг.1.

На фиг.7 показана схема, иллюстрирующая массив пикселей наименьшего модуля датчика изображения, показанного на фиг.1.

На фиг.8 показана схема, иллюстрирующая массив пикселей модуля наивысшего порядка датчика изображения, показанного на фиг.1.

На фиг.9 показана схема, иллюстрирующая массив пикселей во всех областях датчика изображения, показанного на фиг.1.

На фиг.10 показана схема, иллюстрирующая способ группирования пикселей, выполняемый при поперечном детектировании дефокусирования.

На фиг.11 показана схема, иллюстрирующая характеристики выборки изображения при поперечном детектировании дефокусирования.

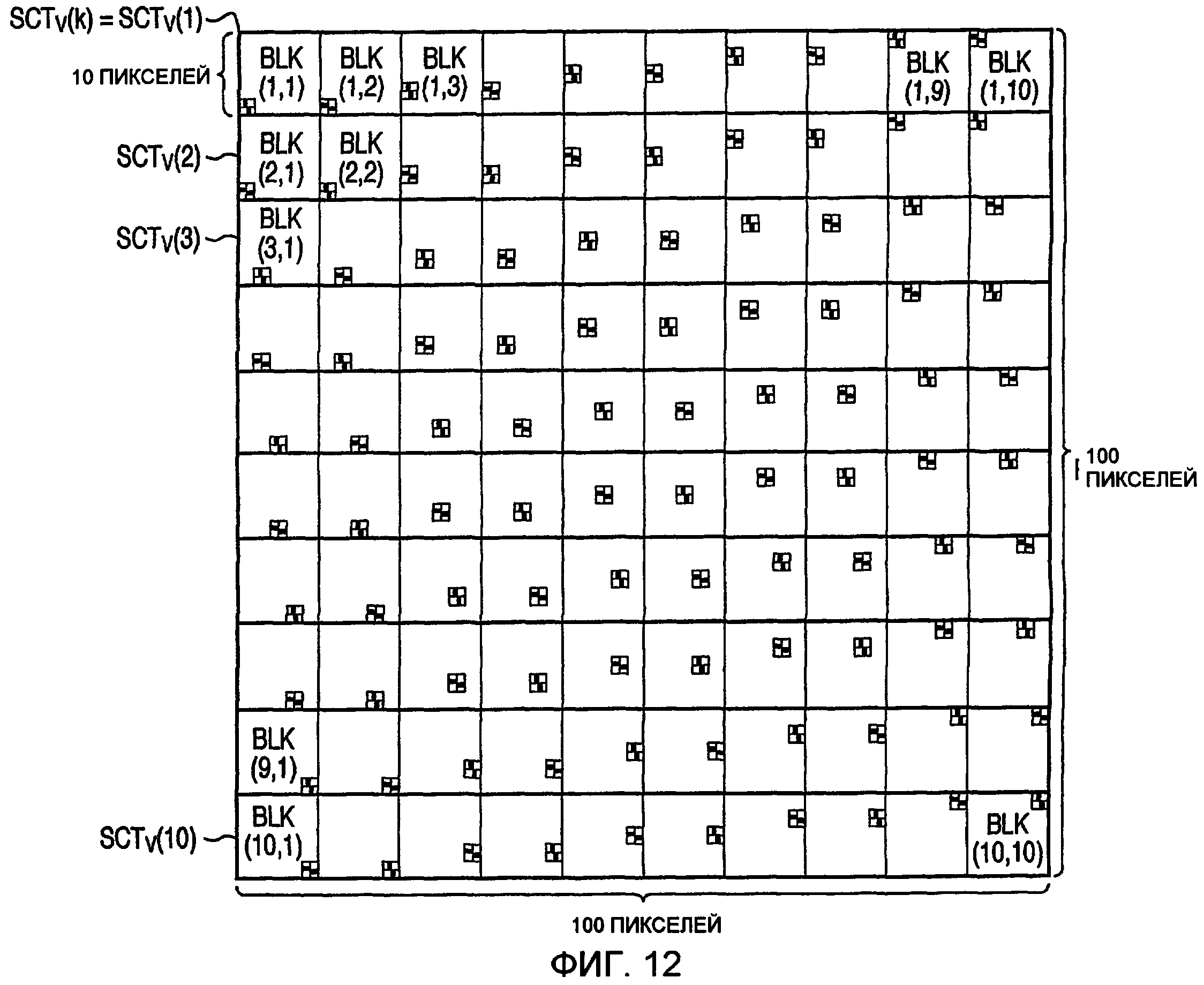

На фиг.12 показана схема, иллюстрирующая способ группирования пикселей, выполняемый при продольном детектировании дефокусирования.

На фиг.13 показана схема, иллюстрирующая характеристики выборки изображения при продольном детектировании дефокусирования.

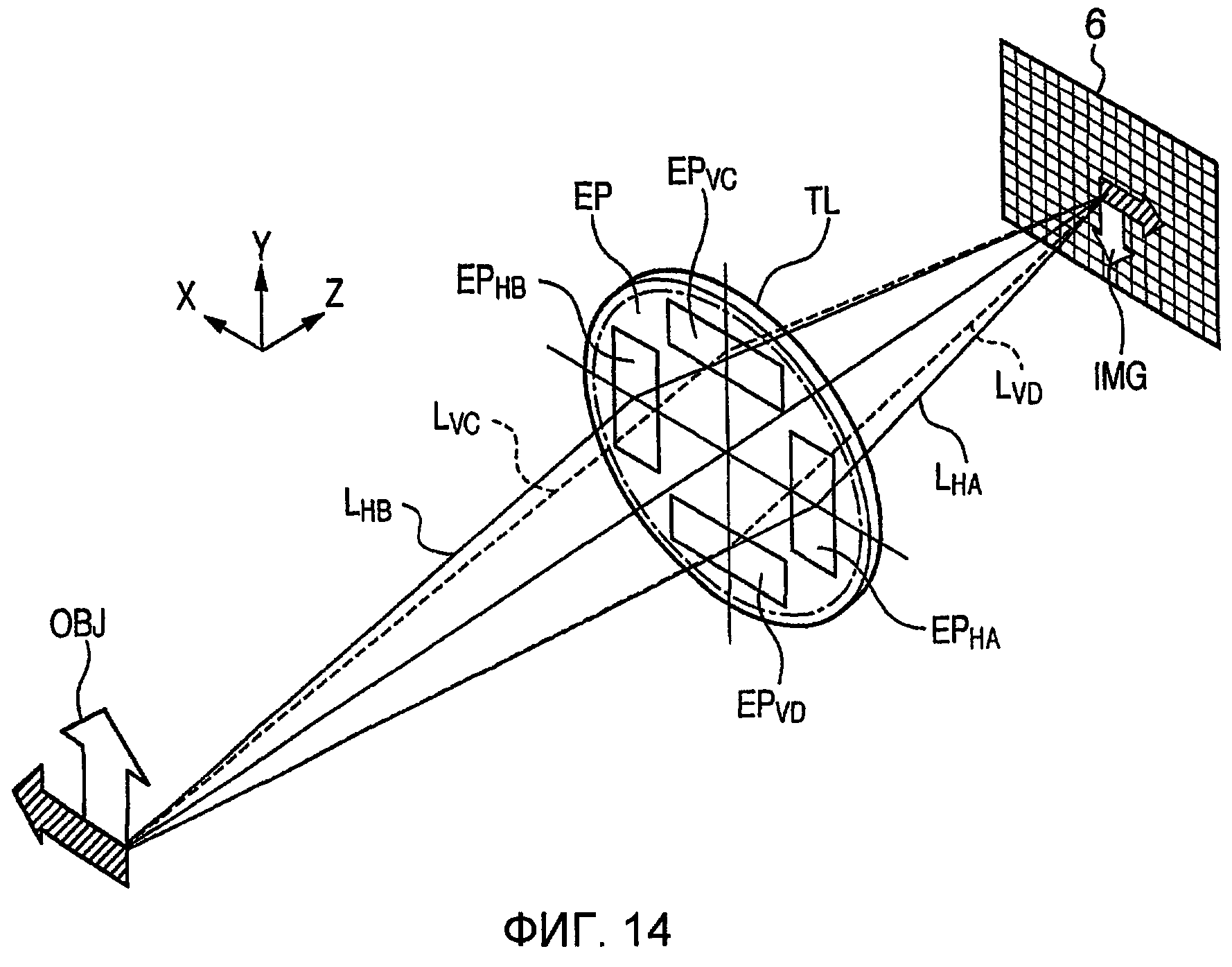

На фиг.14 показана концептуальная схема для описания состояний разделения зрачка в датчике изображения, показанном на фиг.1.

На фиг.15 показана схема, иллюстрирующая операции AF во время предварительного просмотра в реальном времени.

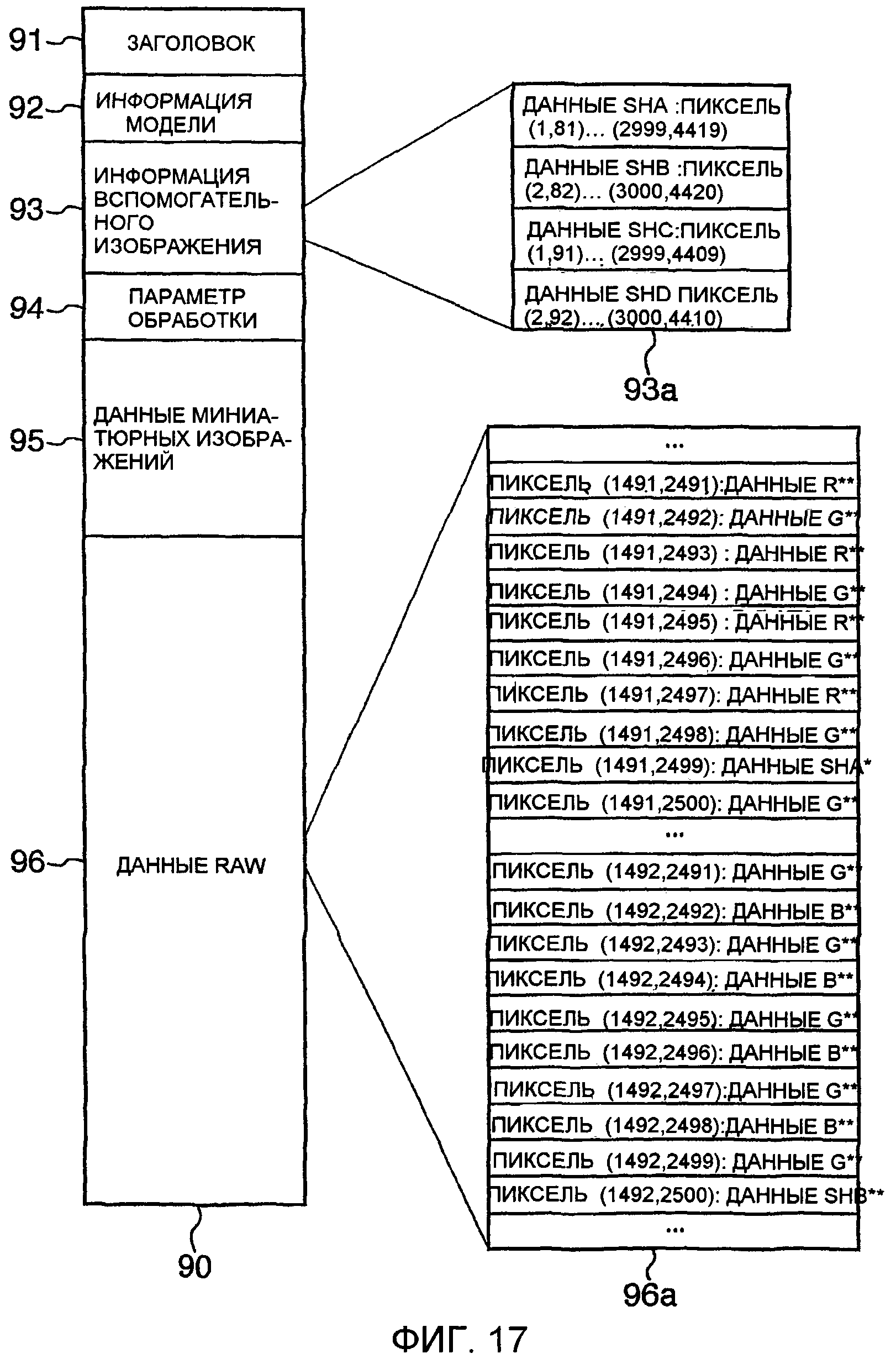

На фиг.16 показана схема, представляющая структуру формата сжатого файла изображения Exif.

На фиг.17 показана схема, представляющая структуру формата файла данных изображения RAW.

На фиг.18 показана блок-схема последовательности операций, представляющая основные операции цифровой камеры, представленной на фиг.1.

На фиг.19 показана блок-схема последовательности операций, предназначенная для описания деталей нормальной процедуры захвата, показанной на фиг.18.

На фиг.20 показана блок-схема последовательности операций, предназначенная для описания деталей процедуры записи сигнала пикселя AF, представленной на фиг.18.

На фиг.21 показана блок-схема последовательности операций, предназначенная для описания деталей процедуры отображения при предварительном просмотре в реальном времени, показанной на фиг.18.

На фиг.22 показана блок-схема последовательности операций, предназначенная для описания деталей процедуры AF разности фаз в плоскости считывания изображения, показанной на фиг.18.

На фиг.23 показана блок-схема последовательности операций, предназначенная для описания подробностей процедуры съемки при предварительном просмотре в реальном времени, показанной на фиг.18.

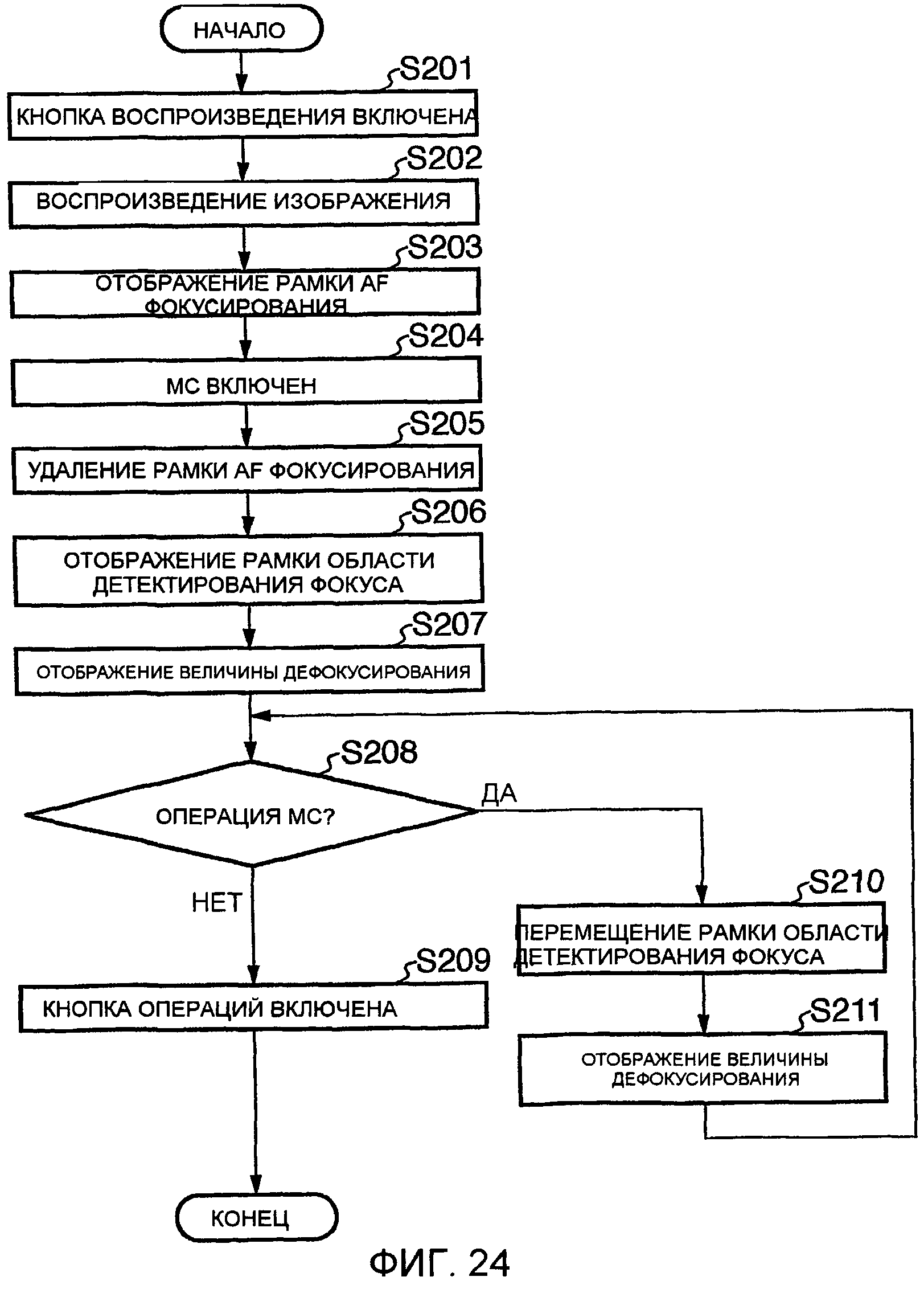

На фиг.24 показана блок-схема последовательности операций, представляющая операции цифровой камеры, представленной на фиг. 1, во время воспроизведения изображения.

На фиг.25 показана схема, представляющая операции, выполняемые во время воспроизведения изображения на жидкокристаллическом мониторе цифровой камеры, показанной на фиг.1.

На фиг.26 показана основная блок-схема последовательности операций, представляющая основные операции программного обеспечения для обработки файла RAW в устройстве обработки изображения.

На фиг.27 показана схема, представляющая условие, при котором программное обеспечение обработки файла RAW отображается на дисплее устройства обработки изображения.

Подробное описание изобретения

Ниже приведено подробное описание вариантов осуществления настоящего изобретения со ссылкой на чертежи.

Вариант 1 осуществления

На фиг.1 и 2 показаны виды в поперечном сечении цифровой зеркальной камеры с одним объективом, которая представляет собой Вариант 1 осуществления устройства съемки изображения в соответствии с настоящим изобретением.

Позицией 1 обозначен корпус камеры, и позицией 2 обозначено крепление, которое обеспечивает возможность прикрепления описанного ниже фотообъектива 3 и отсоединения его от корпуса 1 камеры и которое имеет модуль интерфейса для обеспечения возможности передачи различных типов сигналов и подачи питания для привода. Позицией 3 обозначен съемный фотообъектив, который включает в себя группу линз фокусирования, группу линз масштабирования и устройство диафрагмы, которое не показано. На фиг.1 и 2 каждая группа линз показана как отдельная линза для удобства, и, например, группа линз фокусирования показана как линза 3a фокусирования. Однако фотообъектив 3 фактически выполнен с использованием сложной комбинации групп линз, которые включают в себя множество линз. Следует отметить, что линзы 3a фокусирования не ограничены линзами, расположенными с передней стороны фотообъектива 3, как показано на фиг.1 и 2.

Позицией 4 обозначено основное зеркало, которое выполнено, как полупрозрачное зеркало и может поворачиваться в соответствии с рабочим состоянием камеры. Когда требуется наблюдать объект через видоискатель, основное зеркало 4 устанавливают так, что оно наклонено на оптическом пути фотографирования, и, таким образом, основное зеркало 4 отклоняет луч света от фотообъектива 3 и направляет этот луч света на описанную выше оптическую систему видоискателя (фиг.1). Во время захвата и предварительного просмотра в реальном времени основное зеркало 4 выводят из оптического пути фотографирования, и, таким образом, луч света направляется через фотообъектив 3 к описанному ниже датчику 6 изображения (фиг.2). Позицией 5 обозначен затвор, который управляет падением луча света от фотообъектива 3 на описанный ниже датчик 6 изображения, в результате чего затвор 5 обычно находится в закрытом состоянии (фиг.1) и в открытом состоянии во время захвата и предварительного просмотра в реальном времени (фиг.2).

Позицией 6 обозначен датчик изображения, который выполнен как датчик изображения CMOS, и его периферийные схемы. Датчик 6 изображения выполнен так, что возможен независимый выход из всех пикселей. Кроме того, некоторые из пикселей представляют собой пиксели детектирования фокуса, которые обеспечивают возможность, таким образом, детектирования фокуса, с использованием способа детектирования разности фаз на плоскости считывания изображения (AF разности фаз). Более конкретно, датчик 6 изображения имеет множество пикселей съемки изображения, которые генерируют изображение объекта в результате приема света, который прошел через все области выходного зрачка (описанный ниже EP) фотообъектива 3, который формирует изображение объекта. Датчик 6 изображения, кроме того, имеет множество пикселей детектирования фокуса, которые принимают свет, который прошел через некоторые области (ниже описанные EPHA и EPHB) выходного зрачка EP фотообъектива 3. Все вместе пиксели детектирования фокуса могут принимать свет, который прошел через все области выходного зрачка фотообъектива 3.

Позицией 7 обозначено вспомогательное зеркало, которое поворачивается вместе с основным зеркалом 4, и когда основное зеркало 4 установлено так, что оно наклонено в оптический пути фотографирования, вспомогательное зеркало 7 изгибает луч света, который прошел через основное зеркало 4, в направлении описанного ниже датчика 8 AF и направляет луч света к датчику 8 AF (фиг.1). Во время съемки и во время предварительного просмотра вспомогательное зеркало 7 отводят из оптического пути фотографирования путем поворота вместе с основным зеркалом 4 (фиг.2). Вспомогательное зеркало 7 не является полупрозрачным зеркалом и поэтому экранирует датчик 6 изображения, не пропуская на него свет. Позицией 8 обозначен датчик AF, который выполнен, например, как вторичный объектив формирования изображения, и в области датчика, состоящего из CCD (ПЗС, прибор с зарядовой связью) или CMOS (КМОП, комплементарный металлооксидный полупроводник), и который обеспечивает AF на основе разности фаз.

Позицией 9 обозначен экран фокусирования, расположенный в первичной плоскости формирования изображений фотообъектива 3, в результате чего обеспечиваются линзы Френеля (конденсорные линзы) на передней поверхности падения экрана 9 фокусирования, и изображение объекта (изображение видоискателя) формируется на выходной поверхности экрана 9 фокусирования. Позицией 10 обозначена пентапризма, предназначенная для изменения оптического пути видоискателя, и пентапризма 10 преобразует изображение объекта, формируемое на выходной поверхности экрана 9 фокусирования, в расположенное вертикально нереверсивное изображение. Позициями 11-12 обозначен окуляр. Здесь оптическая система, выполненная на основе экрана 9 фокусирования, пентапризма 10 и окуляры 11 и 12 называются оптической системой видоискателя.

Позицией 13 обозначен датчик автоматической экспозиции (AE), который выполнен на основе фотодиодов во взаимно-однозначном соответствии с областями разделенной на множество частей области съемки, и датчик 13 AE измеряет яркость изображения объекта, сформированного на выходной поверхности экрана 9 фокусирования. Позицией 14 обозначен жидкокристаллический монитор (модуль дисплея), который отображает снятые изображения и различные типы информации фотосъемки. В режиме предварительного просмотра в реальном времени жидкокристаллический монитор 14 отображает изображение объекта (изображение объекта), снимаемого датчиком 6 изображения, и также отображает рамку AF, которая может быть установлена с помощью описанного ниже микроконтроллера 33, который представляет собой модуль установки рамки AF, и рамку AF, которая была установлена микроконтроллером 33.

На фиг.3 показана блок-схема, представляющая систему управления цифровой зеркальной камеры с одним фотообъективом.

Позицией 20 обозначен микрокомпьютер (центральный процессор, ниже называемый "MPU"), который управляет модулем камеры и выполняет общее управление камерой. MPU (модуль управления) 20 рассчитывает величину дефокусирования рамки детектирования фокуса путем выполнения AF на основе разности фаз в рамке AF, которая была установлена микроконтроллером 33, который представляет собой описанный ниже модуль установки рамки, путем выполнения расчетов выходных сигналов из пикселей детектирования фокуса в рамке AF.

Позицией 21 обозначен контроллер запоминающего устройства, который выполняет управление различного типа для данных изображения, и позицией 22 обозначено EEPROM (ЭСППЗУ, электрически стираемое программируемое постоянное запоминающее устройство), в котором содержатся, например, данные регулирования и установки для выполнения различных типов управления. Позицией 23 обозначена схема управления объективом в фотообъективе 3, в результате чего схема 23 управления объективом подключена к MPU 20 через соединение 2 и выполняет управление апертурой (не показана) и регулировкой фокуса (управление фокусированием) группы линз фокусирования (не показана) на основе различной информации, которая описана ниже.

Позицией 24 обозначена схема детектирования фокуса, которая выполняет управление накоплением и управление считыванием в отношении датчика области датчика 8 AF и выводит информацию пикселей в каждой точке детектирования фокуса в MPU 20. MPU 20 выполняет известное AF на основе разности фаз при использовании информации пикселей в каждой точке детектирования фокуса, передает обнаруженную информацию детектирования фокуса в схему 23 управления объективом и выполняет регулировку фокусирования для группы линз фокусирования (не показана). Последовательность операций от детектирования фокуса до регулировки фокуса называется операцией автофокусирования AF.

Позицией 25 обозначена схема фотометрии, которая выводит сигналы яркости из каждой области датчика 13 AE в MPU 20. MPU 20 выполняет аналого-цифровое A/D преобразование по сигналам яркости для получения информации фотометрии в отношении объекта, рассчитывает и устанавливает экспозицию съемки при использовании такой информации фотометрии. Последовательность операций от получения такой информации фотометрии до установки экспозиции съемки называется операцией AE.

Позицией 26 обозначена схема управления двигателем, которая управляет двигателем (не показан), который осуществляет приведение в действие основного зеркала 4 и запуск двигателя (не показан), который заряжает затвор 5. Позицией 27 обозначена схема управления затвором, которая управляет подачей энергии к катушке (не показана) для открывания и закрывания затвора 5. Позицией 28 обозначен DC/DC преобразователь (преобразователь постоянного напряжения), который преобразует напряжение источника 29 питания в напряжение, требуемое для схем.

Позицией 30 обозначена пусковая кнопка, которая выводит сигнал SW1 и SW2 в MPU 20. SW1 представляет собой переключатель для начала операции фотометрии (AE) и операции AF, и его устанавливают в положении ВКЛЮЧЕНО во время операции первого нажатия (половинный нажим) пусковой кнопки 30. SW2 представляет собой переключатель для начала операции экспонирования, и его устанавливают в положение ВКЛЮЧЕНО во время операции второго нажатия (полный нажим) на пусковую кнопку 30. Позицией 31 обозначена кнопка режима, и когда выполняют операции с описанной ниже круговой электронной шкалой 32 или микроконтроллером 33 после выполнения операции с кнопкой 31 режима, выбирают один из различных режимов в соответствии с такой входной операцией, и выбранный режим определяют, когда снова нажимают на кнопку 31 режима. Например, тип качества регулируемого изображения для снимаемых изображений может изменяться. Позицией 32 обозначена круговая электронная шкала, которая выводит сигнал ВКЛЮЧЕНО в соответствии с поворотом со щелчком круговой шкалы для реверсивного счетчика (не показан) в MPU 20, и при этом выполняют подсчет количества щелчков во время поворота. Выбор различных цифровых значений, данных и т.п. выполняют в соответствии с таким подсчетом.

Позицией 33 обозначен микроконтроллер (MC), который представляет собой устройство ввода, используемое при выборе и определении различных режимов и рамки AF (рамки детектирования фокуса), отображаемой на жидкокристаллическом мониторе 14 во время описанного ниже предварительного просмотра в реальном времени. Микроконтроллер 33 можно использовать для выполнения восьми типов направленного ввода, а именно вверх, вниз, влево, вправо, вверх вправо, вниз вправо, вверх влево и вниз влево, а также в качестве ввода с использованием операции нажатия. Микроконтроллер 33 функционирует как модуль установки режима, который устанавливает режим предварительного просмотра в реальном времени. Микроконтроллер 33 также функционирует как модуль установки рамки, который устанавливает рамку AF, которая представляет собой цель детектирования фокуса, в произвольное положение в области захвата датчика 6 изображения. Позицией 34 обозначена кнопка источника питания, и источник питания камеры включают/выключают, когда выполняют операции с кнопкой 34 источника питания. Позицией 35 обозначена кнопка воспроизведения, и изображение, записанное на описанном ниже носителе 48 информации, отображают на жидкокристаллическом мониторе 14 при выполнении операций с кнопкой 35 воспроизведения.

Позицией 40 обозначена схема CDS/AGC (КДВ/АРУ, коррелированная двойная выборка/автоматическая регулировка усиления), которая выполняет выборки и хранит сигналы изображения, выводимые из датчика 6 изображения, и выполняет автоматическую регулировку усиления. Позицией 41 обозначен A/D (А/Ц, аналогово-цифровой) преобразователь, который преобразует аналоговый выходной сигнал схемы 40 CDS/AGC в цифровой сигнал. Позицией 42 обозначена схема TG (ГТ, генерирования тактовой частоты), которая передает сигнал управления в датчик 6 изображения, подает сигнал выборки и удержания в схему 40 CDS/AGC и подает сигнал тактовой частоты выборки в A/D преобразователь 41.

Позицией 43 обозначено SDRAM (СЛОЗУ, синхронное динамическое оперативное запоминающее устройство), предназначенное для временной записи, например, изображения, которое было преобразовано в цифровую форму с помощью A/D преобразователя 41. SDRAM 43 может записывать выходные сигналы из пикселей детектирования фокуса во всех областях области съемки 6 изображения. В качестве альтернативы, SDRAM 43 может рассчитывать величину дефокусирования путем выполнения AF на основе разности фаз для всех областей области съемки датчика 6 изображения и записывать величину дефокусирования.

Позицией 44 обозначена схема обработки изображения, которая выполняет разделение Y/C (сигнала яркости/цветоразностного сигнала), коррекцию баланса белого, γ-коррекцию и т.п. Позицией 45 обозначена схема сжатия/восстановления изображения, которая сжимает изображения в соответствии с форматом JPEG или тому подобное и восстанавливает сжатые изображения. Здесь контроллер 21 запоминающего устройства может получать фотометрическую информацию, относящуюся к объекту, обеспечивая выполнение схемой 44 обработки данных изображения обработки сигнала изображения, выводимого из датчика 6 изображения. Позицией 46 обозначен D/A (Ц/А, цифроаналоговый) преобразователь, который преобразует изображение, записанное в SDRAM 43 или на описанный ниже носитель 48 информации, в аналоговый сигнал, так что изображение может отображаться на жидкокристаллическом мониторе 14. Позицией 47 обозначен I/F (ИФ, интерфейс) с носителем 48 информации для записи/сохранения изображений.

Ниже приведено описание AF на основе разности фаз в плоскости считывания изображения, выполняемого с помощью датчика 6 изображения.

В настоящем варианте осуществления в следующем описании раскрыт пример датчика изображения, шаг пикселя которого составляет 8 мкм, эффективное количество пикселей которого составляет 3000 строк по вертикали 4500 столбцов по горизонтали =13,5 миллионов пикселей и размер экрана которого составляет 36 мм по горизонтали 24 мм по вертикали. Кроме того, такой датчик 6 изображения представляет собой двумерный датчик цвета на одном кристалле, в котором был сформирован мозаичный фильтр первичных цветов в виде массива Байера на кристалле на принимающих свет пикселях.

На фиг.4A-6B показаны схемы, предназначенные для описания структуры пикселей съемки и пикселей детектирования фокуса. В настоящем варианте осуществления используется массив Байера, в котором среди группы из четырех пикселей 2 строки на 2 столбца пиксели, которые имеют G (зеленую) спектральную чувствительность, расположены как два пикселя в противоположных углах и пиксель, имеющий R (красную) спектральную чувствительность, и пиксель, имеющий B (синюю) спектральную чувствительность, расположены как два других пикселя. Кроме того, пиксели детектирования фокуса, структура которых описана ниже, расположены дискретно в пределах массива Байера в соответствии с предварительно заданным правилом.

На фиг.4A и 4B показано размещение и структура пикселей съемки.

На фиг.4A показан вид в плане группы пикселей съемки размером 2 строки на 2 столбца (третья группа пикселей). Как известно, в массиве Байера пиксели G расположены по диагонали в противоположных углах, и пиксель R и пиксель B расположены как два других пикселя. Кроме того, такая структура размером две строки на два столбца размещена с повторением. На фиг.4B показан вид в поперечном сечении, взятый вдоль линии А-А на фиг.4A. Символом ML обозначены установленные на кристалле микролинзы, расположенные на кристалле поверх каждого пикселя, символом CFR обозначен R (красный) цветной фильтр, и символом CFG обозначен G (зеленый) цветной фильтр. Символом PD (ФД, фотодиод) схематично представлен элемент фотоэлектрического преобразования датчика изображения CMOS. Символом CF (КС, контактный слой) представлен слой разводки для формирования сигнальных линий сигнала, через которые передают различные типы сигналов в датчик изображения CMOS. Символом TL (ОС, съемочный объектив) схематично представлена оптическая фотосистема фотообъектива 3.

Здесь микролинзы ML на кристалле и элементы PD фотоэлектрического преобразования пикселей съемки выполнены так, что луч света, который прошел через оптическую фотосистему TL, принимают с как можно большей эффективностью. Другими словами, выходной зрачок EP (ВЗ, выходной зрачок) оптической фотосистемы TL и элементы PD фотоэлектрического преобразования находятся в сопряженной взаимосвязи, благодаря микролинзам ML, и, кроме того, были разработаны так, что эффективная площадь элементов фотоэлектрического преобразования велика. Следует отметить, что пиксели съемки принимают свет, который прошел через все области выходного зрачка оптической фотосистемы TL. Кроме того, хотя только луч света, который падает на R пиксель, показан на фиг. 4B, эта структура является такой же для пикселя G и пикселя B (синего). В соответствии с этим, выходной зрачок EP, соответствующий каждому из пикселей съемки RGB, имеет большой диаметр, и луч света (фотоны) от объекта принимают эффективно, улучшая, таким образом, S/N (С/Ш, сигнал/шум) сигнала изображения.

На фиг.5A и 5B показаны размещение и структура пикселей детектирования фокуса для разделения зрачка в горизонтальном направлении (направление слева направо или в поперечном направлении) оптической фотосистемы (разделение на первую область выходного зрачка и вторую область выходного зрачка). Здесь горизонтальное направление относится, в случае когда устройство съемки изображения построено так, что оптическая ось оптической фотосистемы и длинная сторона области захвата параллельны земле, к направлению, которое является ортогональным оптической оси и, кроме того, соответствует прямой линии, продолжающейся в горизонтальном направлении. На фиг.5A показан вид в плане группы пикселей размером 2 строки на 2 столбца, которая включает в себя пиксели детектирования фокуса. В случае получения сигнала изображения для записи или просмотра, основные компоненты информации яркости получают из пикселей G. Кроме того, поскольку характеристики распознавания изображения у людей таковы, что чувствительность к информации яркости является высокой, деградация качества изображения легко воспринимается в случае дефицита пикселей G. С другой стороны, пиксели R и пиксели B представляют собой пиксели, которые получают информацию цвета (цветоразностную информацию), и поскольку характеристики зрения людей таковы, что чувствительность к информации цвета низкая, деградация качества изображения слабо воспринимается, даже если в определенной степени недостаточно пикселей, которые получают информацию цвета. Учитывая это, в настоящем варианте осуществления среди пикселей в группе пикселей размером 2 строки на 2 столбца пиксели G были оставлены как пиксели съемки, и пиксели R и пиксели B были заменены пикселями детектирования фокуса (первая группа пикселей и вторая группа пикселей). На фиг.5A такие пиксели детектирования фокуса обозначены как SHA и SHB.

На фиг.5B показан вид в поперечном сечении, взятый вдоль линии А-А на фиг.5A. Структура микролинз ML и элементов PD фотоэлектрического преобразования является той же, что и структура пикселей съемки, показанных на фиг.4B. В настоящем варианте осуществления, поскольку сигналы от пикселей детектирования фокуса не используются при формировании изображения, прозрачная пленка, CFW (белая) установлена на месте фильтров разделения цветов. Кроме того, для разделения зрачка в датчике 6 изображения, апертуры в слое CL разводки проводов размещены в одном направлении относительно центральной линии микролинз ML. В частности, апертура OPHA в пикселе SHA смещена в направлении вправо, и пиксель SHA принимает луч света, который прошел через выходной зрачок EPHA с левой стороны от оптической фотосистемы TL. Апертура OPHB пикселя SHB смещена в направлении влево, и пиксель SHB принимает луч света, который прошел через выходной зрачок EPHB с правой стороны от оптической фотосистемы TL. Пиксели SHA расположены регулярно в горизонтальном направлении, и изображение объекта, получаемое группой таких пикселей, рассматривают как изображение А (первый сигнал изображения). Пиксели SHB также расположены регулярно в горизонтальном направлении, и изображения объекта, получаемые группой таких пикселей, рассматриваются как изображение B (второй сигнал изображения). В соответствии с этим, величину дефокусирования (информацию фокуса) в изображении объекта можно детектировать путем детектирования относительных положений изображения А и изображения B. Следует отметить, что с пикселями SHA и SHB становится возможным выполнять детектирование фокуса в случае, когда изображение объекта имеет распределение яркости в горизонтальном направлении области захвата (то есть вертикальная линия), но при этом невозможно выполнить детектирование фокуса в случае горизонтальной линии, которая имеет распределение яркости в вертикальном направлении. Учитывая это, для обеспечения возможности детектирования состояния фокусирования, также и в последнем случае, настоящий вариант осуществления выполнен так, что он также включает в себя пиксели, которые также выполняют разделение зрачка в вертикальном направлении (продольном направлении) оптической фотосистемы.

На фиг.6A и 6B показаны размещение и структура пикселей детектирования фокуса для выполнения разделения зрачка в вертикальном направлении (в направлении вверх-вниз или в продольном направлении) оптической фотосистемы. Здесь вертикальное направление относится, в случае когда устройство съемки изображения построено так, что оптическая ось оптической фотосистемы и длинная сторона области захвата параллельны земле, к направлению, которое ортогонально оптической оси и, кроме того, соответствует прямой линии, продолжающейся в вертикальном направлении. На фиг.6A показан вид в плане группы пикселей размером 2 строки на 2 столбца, которая включает в себя пиксели детектирования фокуса, и аналогично фиг.5A, пиксели G были оставлены как пиксели съемки, и пиксель R и пиксель B были заменены пикселями детектирования фокуса. На фиг.6A такие пиксели детектирования фокуса обозначены как SVC и SVD ссылочных позиций.

На фиг.6B показан вид в поперечном сечении, взятый вдоль линии А-А на фиг.6A. Структура пикселей, показанная на фиг.6B, является той же, что и структура, показанная на фиг.5B, за исключением того, что в случае, когда пиксели, показанные на фиг.5B, выполняют поперечное разделение зрачка, пиксели, показанные на фиг.6B, выполняют продольное разделение зрачка. Апертура OPVC пикселя SVC смещена в направлении вниз, и пиксель SVC принимает луч света, который прошел через выходной зрачок EPVC на верхней стороне оптической фотосистемы TL. Аналогично, апертура OPVD пикселя SVD смещена в направлении вверх, и пиксель SVD принимает луч света, который прошел через выходной зрачок EPVD на нижней стороне оптической фотосистемы TL. Пиксели SVC расположены регулярно в вертикальном направлении, и изображение объекта, получаемое с помощью группы таких пикселей, рассматривают как изображение C. Пиксели SVD также расположены регулярно в вертикальном направлении, и изображение объекта, получаемое с помощью группы таких пикселей, рассматривают как изображение D. В соответствии с этим, величину дефокусирования (информацию расстояния) в изображении объекта, имеющего распределение яркости в вертикальном направлении, можно детектировать путем детектирования относительных положений изображения C и изображения D.

На фиг.7-9 показаны схемы для описания правила размещения для пикселей съемки и пикселей детектирования фокуса, показанных на фиг.4A-6B. На фиг.7 показана схема для описания правила размещения для минимального модуля в случае, в котором пиксели детектирования фокуса расположены дискретно среди пикселей съемки.

На фиг.7 показана квадратная область из 10 строк × 10 столбцов =100 пикселей, которая определена как блок. В верхнем левом блоке BLKH(1,1) нижний самый левый R пиксель и B пиксель были заменены набором пикселей SHA и SHB детектирования фокуса, которые выполняют разделение зрачка в горизонтальном направлении. В блоке BLKV(1,2), который расположен рядом справа от блока BLKH(1,1), нижний самый левый пиксель R и пиксель B также были заменены набором пикселей SVC и SVD детектирования фокуса, которые выполняют разделение зрачка в вертикальном направлении. Кроме того, массив пикселей блока BLKV(2,1), расположенный рядом и снизу от первого блока BLKH(1,1), является тем же, что и массив пикселей блока BLKV(1,2). Массив пикселей блока BLKH(2,2), расположенный рядом справа от блока BLKV(2,1), является тем же, что и массив пикселей ведущего блока BLKH(1,1). Такое правило размещения может быть обобщено следующим образом: в блоке BLK (i, j) предусмотрены пиксели детектирования фокуса для горизонтального разделения зрачка, если i+j представляет собой четный номер, и предусмотрены пиксели детектирования фокуса для вертикального разделения зрачка, если i+j представляет собой нечетный номер. Кроме того, блоки 2·2=4 на фиг.7, то есть область из 20 строк x 20 столбцов = 400 пикселей, определены как кластер, который представляет собой модуль массива более высокого порядка для блоков.

На фиг.8 показана схема, предназначенная для описания правила размещения с использованием кластера в качестве модуля. На фиг.8 верхний самый левый кластер, составленный из 20 строк × 20 столбцов = 400 пикселей, рассматривают как CST(u, w) = CST(1,1). В кластере CST(1,1) нижний самый левый R пиксель и B пиксель каждого блока были заменены пикселями SHA и SHB или SVC и SVD детектирования фокуса. В кластере CST(1,2), расположенном рядом справа от кластера CST(1,1), пиксели детектирования фокуса в каждом блоке были расположены в положениях, которые сдвинуты на два пикселя вверх относительно кластера CST(1,1). Кроме того, в кластере CST(2,1), который расположен рядом с первым кластером CST(1,1) и ниже от него, пиксели детектирования фокуса в каждом блоке были размещены в положениях, которые сдвинуты на два пикселя вправо относительно кластера CST(1,1). Применяя описанное выше правило, получим размещение, показанное на фиг.8.

Для случая обобщения такое правило размещения описано ниже. Следует отметить, что четыре пикселя, включающие в себя пиксели G, показанные на фиг.5 или 6, рассматриваются как один модуль (пара) и координаты пикселей детектирования фокуса определены координатами верхнего самого левого пикселя среди четырех пикселей. Кроме того, координаты в каждом верхнем левом блоке рассматриваются как (1,1), и направление вниз и направление вправо рассматриваются как положительные. В кластере CST(u, w) горизонтальные координаты пары пикселей детектирования фокуса в каждом из блоков представляют собой 2xu-1, и вертикальные координаты представляют собой 11-2xw. Кроме того, 5×5=25 кластеров на фиг.8, то есть область из 100 строк × 100 столбцов = 10000 пикселей, определены как поле, которое представляет собой модуль массива более высокого порядка для кластеров.

На фиг.9 показана схема для описания правила размещения с использованием поля в качестве модуля. На фиг.9 верхнее самое левое поле, составленное из 100 строк x 100 столбцов = 10000 пикселей, рассматривается как FLD(q, r) = FLD(1,1). Кроме того, в настоящем варианте осуществления массив всех полей FLD(q, r) аналогичен массиву ведущего поля FLD(1,1). Учитывая это, когда 45 полей FLD(q, r) расположены в горизонтальном направлении и 30 полей FLD(q, r) расположены в вертикальном направлении, область съемки, состоящая из 3000 строк × 4500 столбцов = 13,5 миллионов пикселей, будет составлена из 1350 полей FLD(q, r). Таким образом, пиксели детектирования фокуса могут быть распределены однородно по всей области съемки.

Далее описан способ выполнения группирования и суммирования сигнала пикселей во время детектирования фокуса со ссылкой на фиг.10-13.

На фиг.10 показана схема для описания способа группирования пикселей в случае выполнения детектирования фокуса в поперечном направлении дефокусирования изображения объекта, сформированного оптической фотосистемой. Детектирование фокуса в поперечном направлении дефокусирования относится к выполнению детектирования фокуса на основе разности фаз, используя пиксели детектирования фокуса, которые описаны со ссылкой на фиг.5, для разделения выходного зрачка оптической фотосистемы в поперечном направлении (горизонтальном направлении или в направлении слева направо).

Массив пикселей, показанный на фиг.10, является тем же, что и массив пикселей на фиг.8, и в случае выполнения детектирования фокуса всего 10 блоков, то есть один блок по горизонтали и десять блоков по вертикали, рассматривают как одну группу и эту группу определяют как секцию. Область детектирования фокуса формируется в результате конкатенации секций SCTH(k), выровненных в поперечном направлении. В качестве одного примера в настоящем варианте осуществления, область детектирования фокуса выполнена путем конкатенации 10 секций от секции SCTH(1) до секции SCTH(10). Другими словами, область детектирования фокуса представляет собой область из 100 строк × 100 столбцов = 10000 пикселей. Эта область является той же, что и поле, и, как описано со ссылкой на фиг.9, выполняют такие установки, чтобы область съемки была составлена из 1350 фиксированных областей детектирования фокуса. Конечно, существуют различные способы установки, и возможен способ установки, в котором установлены переменные области детектирования фокуса в произвольных положениях в области съемки путем конкатенации секций SCTH(k) в произвольных положениях в области съемки, в соответствии с объектом.

Здесь секция включает в себя пять пикселей SHA, которые выполняют разделение зрачка на одной стороне в поперечном направлении, и пять пикселей SHB, которые выполняют разделение зрачка с другой стороны. Учитывая это, в настоящем варианте осуществления выходные сигналы пяти пикселей SHA суммируют вместе и рассматривают как сигнал для одного пикселя, получая, таким образом, AF пиксель сигнала одного изображения (далее упоминается как изображение А) для расчета разности фаз. Аналогично, выходные сигналы пяти пикселей SHB суммируют вместе и рассматривают как сигнал для одного пикселя, получая, таким образом, пиксель AF другого сигнала изображения (далее упоминается как изображение B) для расчета разности фаз.

На фиг.11 показана схема, предназначенная для описания возможности съемки (захвата) изображения объекта в секции. На фиг.11 показан вид с вырезом секции SCTH(1) на левой кромке фиг.10. Горизонтальные линии PRJH, обозначенные снизу, представляют собой первые линии проекции, продолжающиеся в направлении разделения зрачка пикселей SHA и SHB детектирования фокуса, и вертикальные линии PRJV, обозначенные справа, представляют собой вторые линии проекции, продолжающиеся в направлении, ортогональном направлению разделения зрачка. Здесь выходные сигналы всех пикселей SHA в секции суммируют вместе, и такое же суммирование также выполняют для пикселей SHB. Учитывая это, можно видеть, что в случае рассмотрения пикселя AF в качестве секции, когда модули приема света, включенные в пиксель AF, проецируют вдоль линий PRJH проекции в направлении разделения зрачка, пиксели SHA и SHB плотно совмещены с чередованием. Здесь P1=PHH=2 (единица представляет собой пиксель), где P1 представляет собой шаг массива пикселей SHA на линиях PRJH проекции в направлении разделения зрачка. Если это выразить, используя пространственную частоту F1 вместо шага, в результате получим F1=0,5 (единица представляет собой пиксель/пиксель). Аналогично, шаг массива пикселей SHB на линиях PRJH проекции также составляет P1=2 (единица представляет собой пиксель), и, с учетом пространственной частоты, результат составляет F1=0,5 (единица представляет собой пиксель/пиксель).

С другой стороны, когда модули приема света, включенные в пиксель AF, проецируют вдоль линий PRJV проекции в направлении, ортогональном направлению разделения зрачка, пиксели SHA и SHB выравниваются не часто. Здесь P2=PHV=20 (единица представляет собой пиксель), где P2 представляет собой шаг массива пикселей SHA на линиях PRJV проекции. Когда это выражается с использованием пространственной частоты F2 вместо шага, результат представляет собой F2=0,05 (единица представляет собой пиксель/пиксель). Аналогично, шаг массива пикселей SHB на линиях PRJV проекции также равен P2=20 (единица представляет собой пиксель), и в обозначениях пространственной частоты результат равен F2=0,05 (единица представляет собой пиксель/пиксель).