Устройство обработки изображения, способ обработки изображения и программа - RU2415480C1

Код документа: RU2415480C1

Чертежи

Описание

Область техники, к которой относится изобретение

Настоящее изобретение относится к устройствам обработки изображения, способам обработки изображения и программам, и более конкретно, к устройству обработки изображения, которое позволяет воспроизводить состояние, в котором, используя первое устройство дисплея, которое отображает изображение, такое как LCD (ЖКД, жидкокристаллический дисплей), изображение отображают во втором устройстве дисплея, которое имеет характеристики, отличающиеся от характеристик первого устройства дисплея, таком как PDP (ППД, плазменная панель дисплея), способу обработки изображения и программе.

Уровень техники

Существуют различные устройства дисплея, в которых изображают сигналы дисплея, такие как CRT (ЭЛТ, электронно-лучевая трубка), ЖКД, ППД, органическая EL (ЭЛ, электролюминесценция) и проектор.

Например, что касается ППД, был предложен способ подавления генерирования ложного контура, путем расчета интенсивности света, попадающего в каждое положение сетчатки глаза, в то время, когда линия взгляда следит за движущимся пикселем на экране дисплея из его выходных данных, генерируя новые данные подполя (например, см. Патентный документ 1).

Патентный документ 1: Публикация №2000-39864 находящейся на экспертизе заявки на японский патент

Сущность изобретения

Техническая задача

Кроме того, характеристики дисплея отличаются в различных устройствах дисплея. Таким образом, различия в характеристиках (характеристиках дисплея) среди устройств дисплея становятся существенной проблемой при выполнении отслеживания для проверки, находится ли сигнал изображения в соответствующем состоянии просмотра (состояние отображения). Таким образом, даже когда определенный сигнал изображения отображают в ЖКД и отслеживают, трудно проверить, как этот сигнал изображения будет выглядеть, когда такой сигнал изображения отображают в ППД.

Поэтому, когда требуется выполнять отслеживание, учитывая характеристики множества устройств дисплея, необходимо, подготовить требуемое количество устройств дисплея, в результате чего увеличиваются размеры системы отслеживания.

Кроме того, ППД представляет устройство дисплея, в котором одно поле входного сигнала изображения составлено из множества подполей, и реализуется отображение с множеством уровней градаций, путем управления каждым подполем, так оно излучает или не излучает свет.

Поэтому существует характеристика, состоящая в том, что, во время отображения движущегося изображения, когда линия взгляда человека следует за движущимся объектом или тому подобное в пределах изображения, отображаемое изображение и изображение, видимое глазами человека, могут отличаться друг от друга в зависимости от структуры излучения света подполей. Однако для того, чтобы проверить, как движущееся изображение могло бы фактически выглядеть в ППД, необходимо отображать движущееся изображение в ППД и обеспечить просмотр и проверку человеком отображаемого движущегося изображения. Такая операция проверки является утомительной, и, кроме того, при этом затруднена объективная оценка.

Настоящее изобретение составлено с учетом этих обстоятельств и позволяет воспроизводить состояние, в котором, используя первое устройство дисплея, такое как ЖКД, изображение отображают во втором устройстве дисплея, таком как ППД, характеристики которого отличаются от характеристик первого устройства дисплея.

Техническое решение

Аспект настоящего изобретения направлен на устройство обработки изображения, которое воспроизводит состояние, в котором, используя первое устройство дисплея, которое отображает изображение, изображение отображают во втором устройстве дисплея, которое имеет характеристики, отличающиеся от характеристик первого устройства дисплея, или на программу, которая обеспечивает выполнение компьютером функций устройства обработки изображения. Устройство обработки изображения включает в себя средство детектирования движения, предназначенное для детектирования движения изображения из входного сигнала изображения; средство формирования подполя, предназначенное для формирования входного сигнала изображения по множеству подполей; и средство интегрирования интенсивности света, предназначенное для расчета на основе моделирования интенсивности света, интегрируемой на сетчатке глаза человека в то время, когда человек рассматривает входной сигнал изображения, отображаемый во втором устройстве дисплея, из направления движения, детектируемого средством детектирования движения, и структуры излучения света подполей, сформированных средством формирования подполя, и генерирования выходного сигнала изображения, значение пикселя которого представляет собой интенсивность света.

Кроме того, аспект настоящего изобретения относится к способу обработки изображения, который состоит в воспроизведении состояния, в котором при использовании первого устройства дисплея, в котором отображают изображение, изображение отображают во втором устройстве дисплея, характеристики которого отличаются от характеристик первого устройства дисплея. Способ обработки изображения включает в себя этапы детектирования движения изображения из входного сигнала изображения; формирования входного сигнала изображения по множеству подполей; и расчета на основе моделирования интенсивность света, интегрированную на сетчатке глаза человека во время, когда человек рассматривает входной сигнал изображения, отображаемый во втором устройстве дисплея, из направления движения изображения, и структуру излучения света подполей, и генерирования выходного сигнала изображения, значение пикселей которого составляет интенсивность света.

В соответствии с предыдущим аспектом движение изображения детектируют из входного сигнала изображения, и входной сигнал изображения сформирован по множеству подполей. Интенсивность света, интегрированная на сетчатке глаза человека, в то время, когда человек рассматривает входной сигнал изображения, отображаемый во втором устройстве дисплея, рассчитывают на основе модели из направления движения изображения, и структуру излучения света подполей, и генерируют сигнал выходного изображения, значение пикселя которого составляет интенсивность света.

Предпочтительные эффекты

В соответствии с аспектом настоящего изобретения можно воспроизводить состояние, в котором, используя первое устройство дисплея, такое как ЖКД, изображение отображают во втором устройстве дисплея, таком как ППД, характеристики которого отличаются от характеристик первого устройства дисплея.

Краткое описание чертежей

На фиг.1 показана блок-схема, иллюстрирующая примерную структуру первого варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

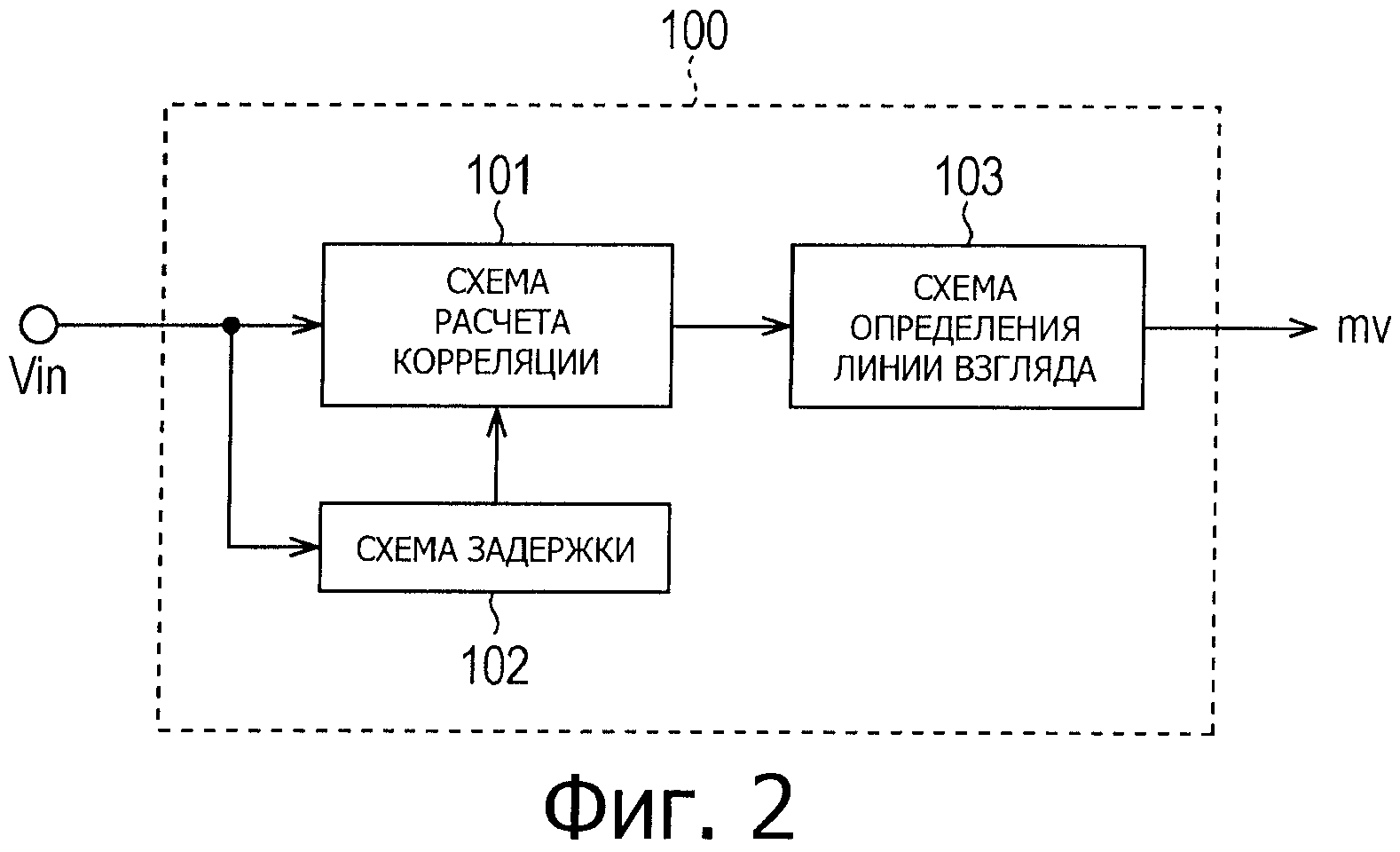

На фиг.2 показана блок-схема, иллюстрирующая примерную структуру модуля 100 детектирования движения.

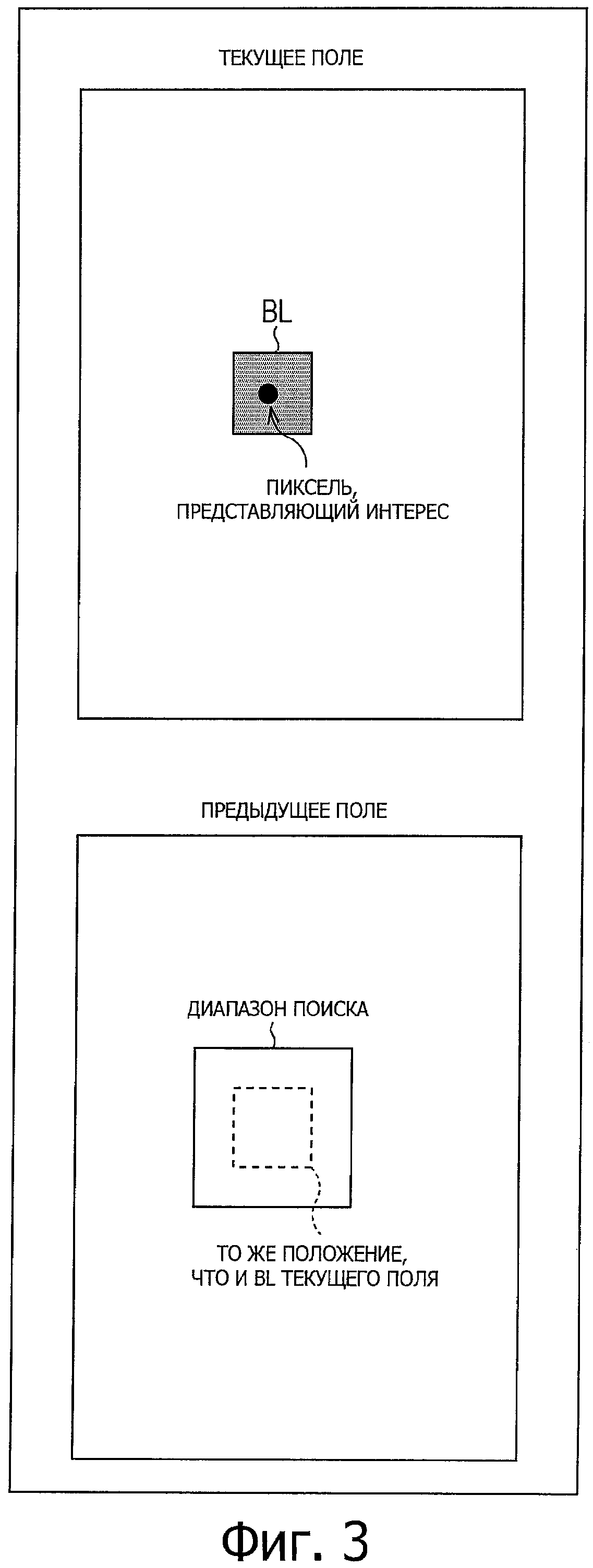

На фиг.3 показана схема, описывающая детектирование движения.

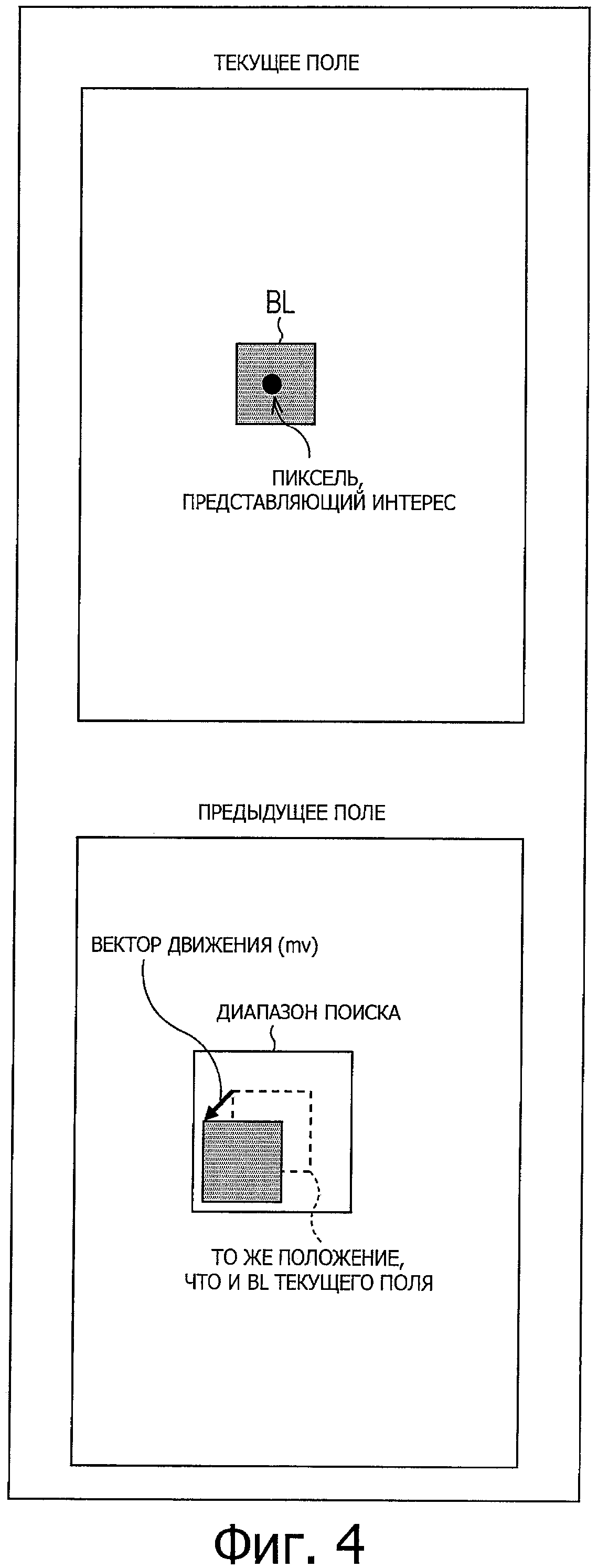

На фиг.4 показана схема, описывающая детектирование движения.

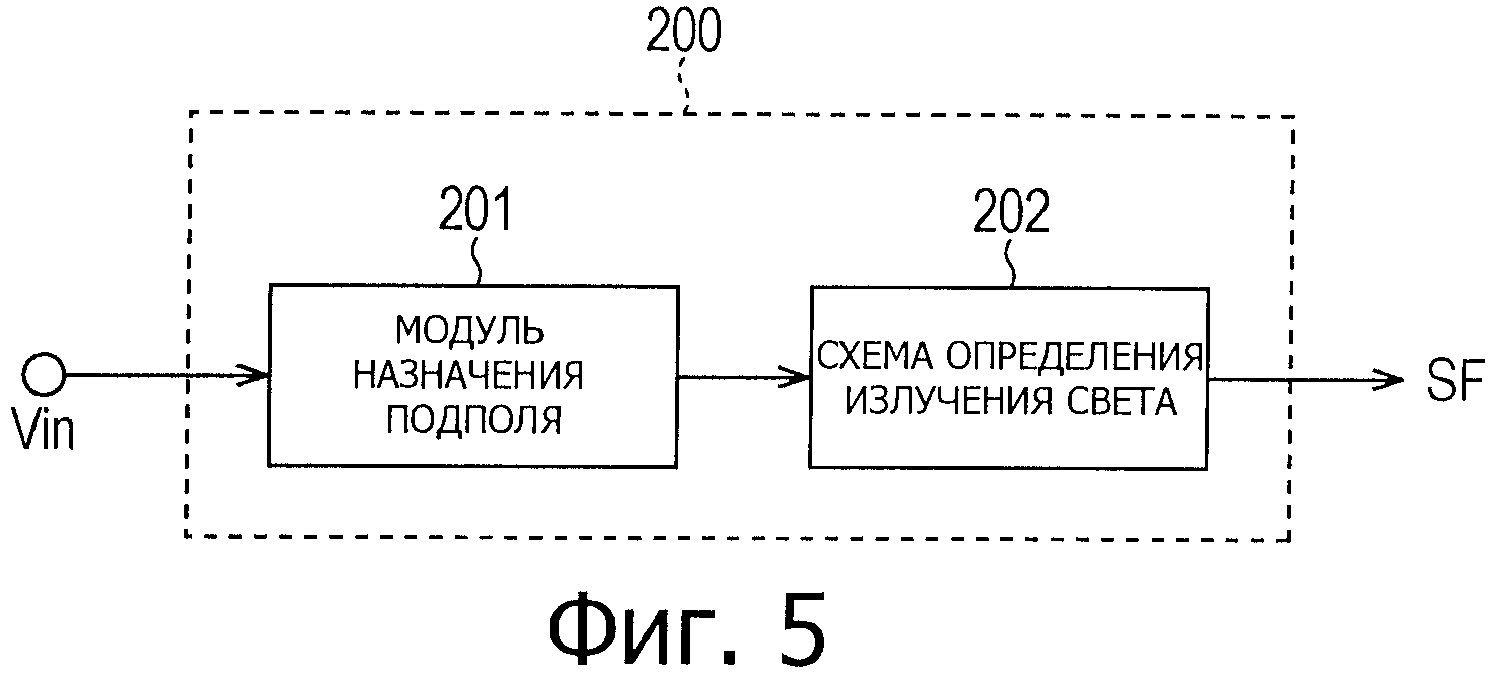

На фиг.5 показана блок-схема, иллюстрирующая примерную структуру модуля 200 формирования подполя.

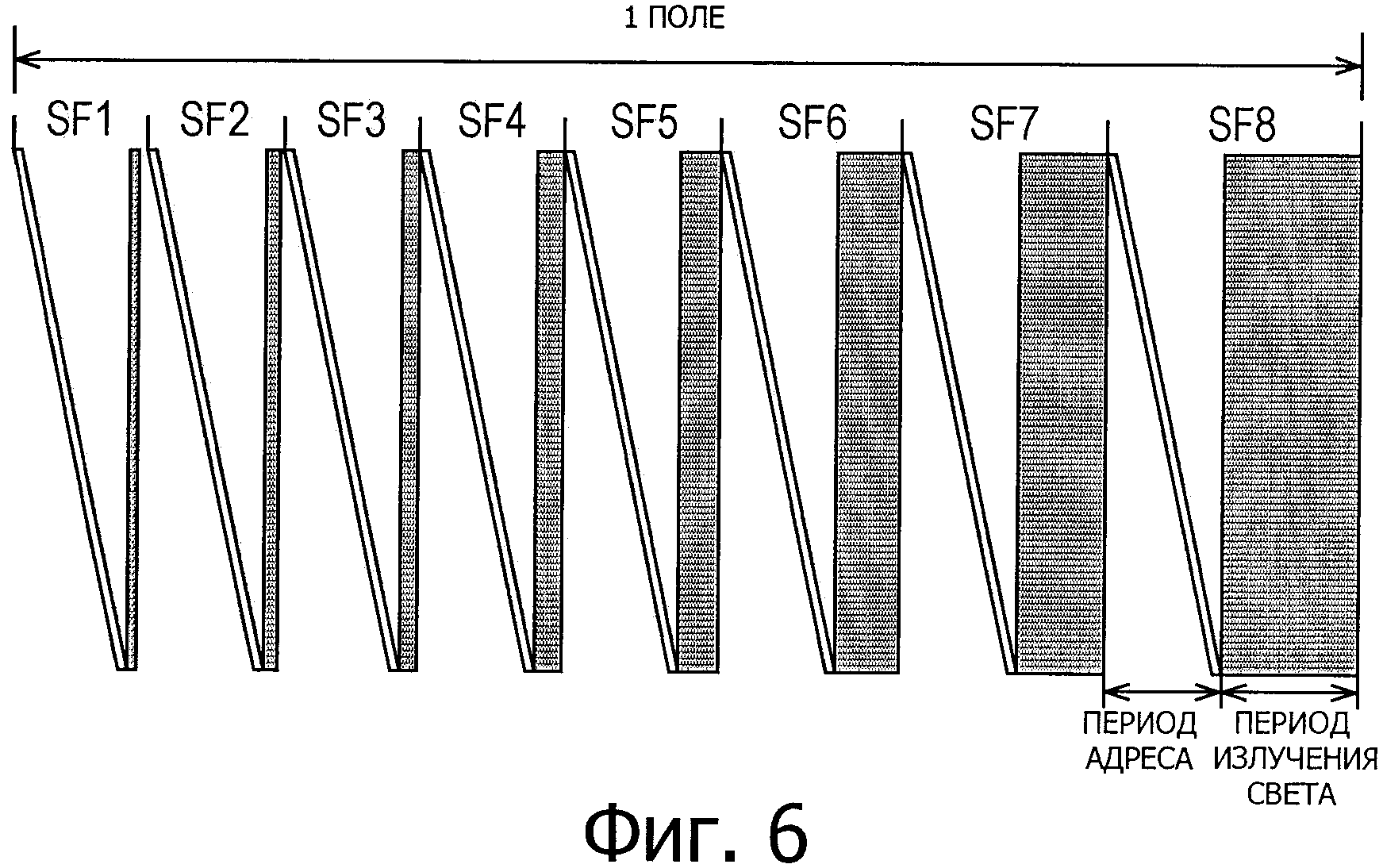

На фиг.6 показана схема, иллюстрирующая примерную структуру подполей.

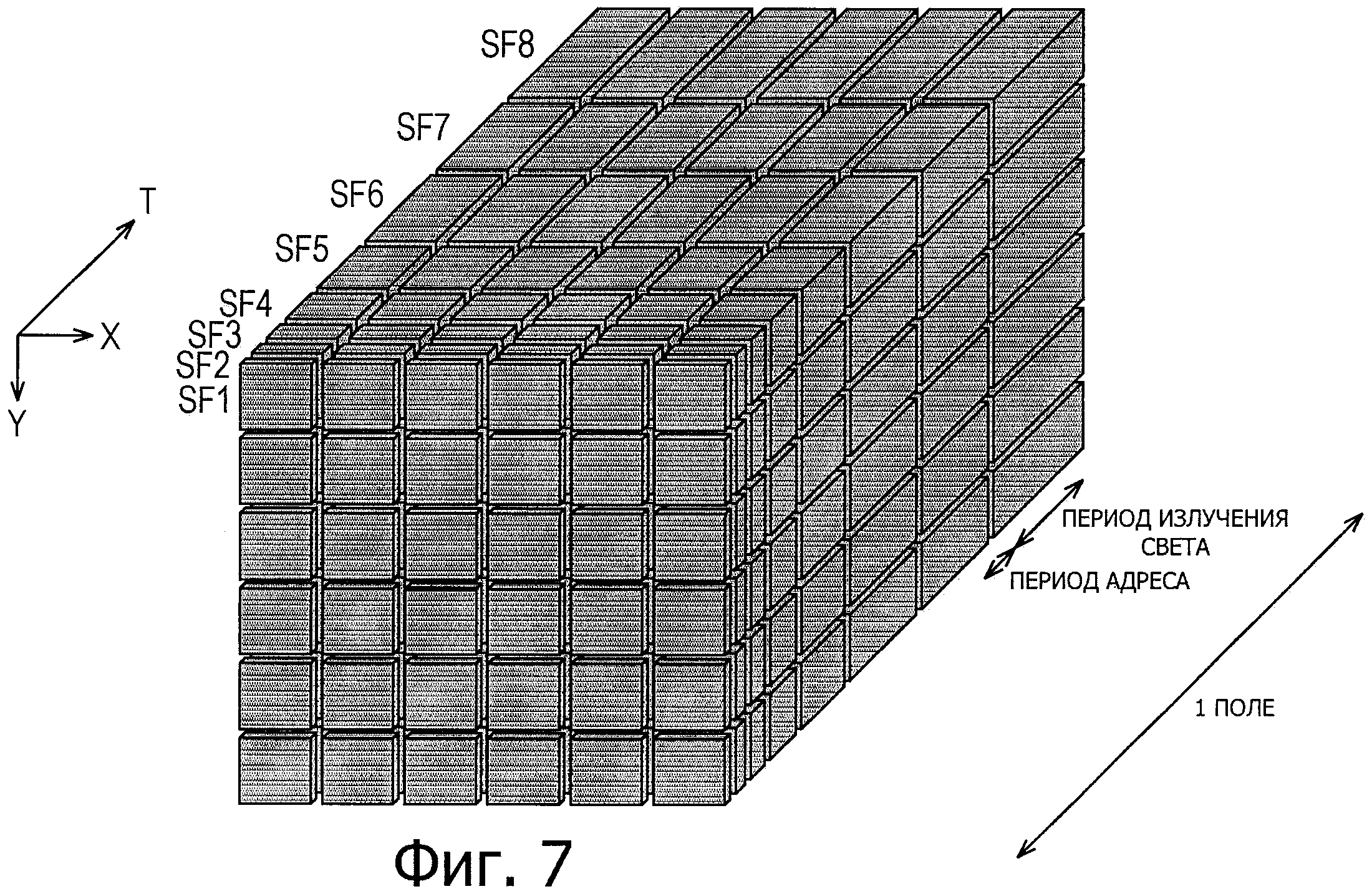

На фиг.7 показана схема, иллюстрирующая примерную структуру подполей.

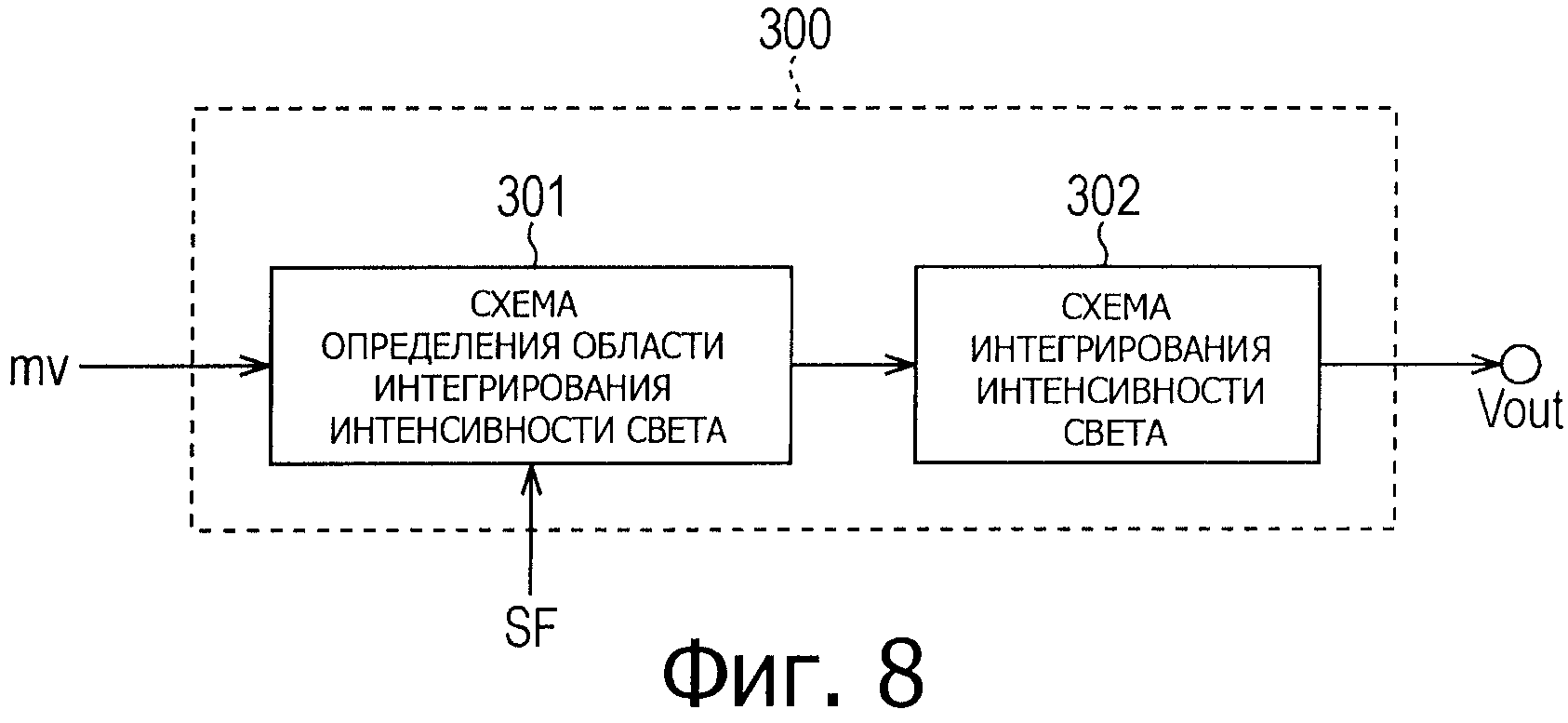

На фиг.8 показана блок-схема, иллюстрирующая примерную структуру модуля 300 интегрирования интенсивности света.

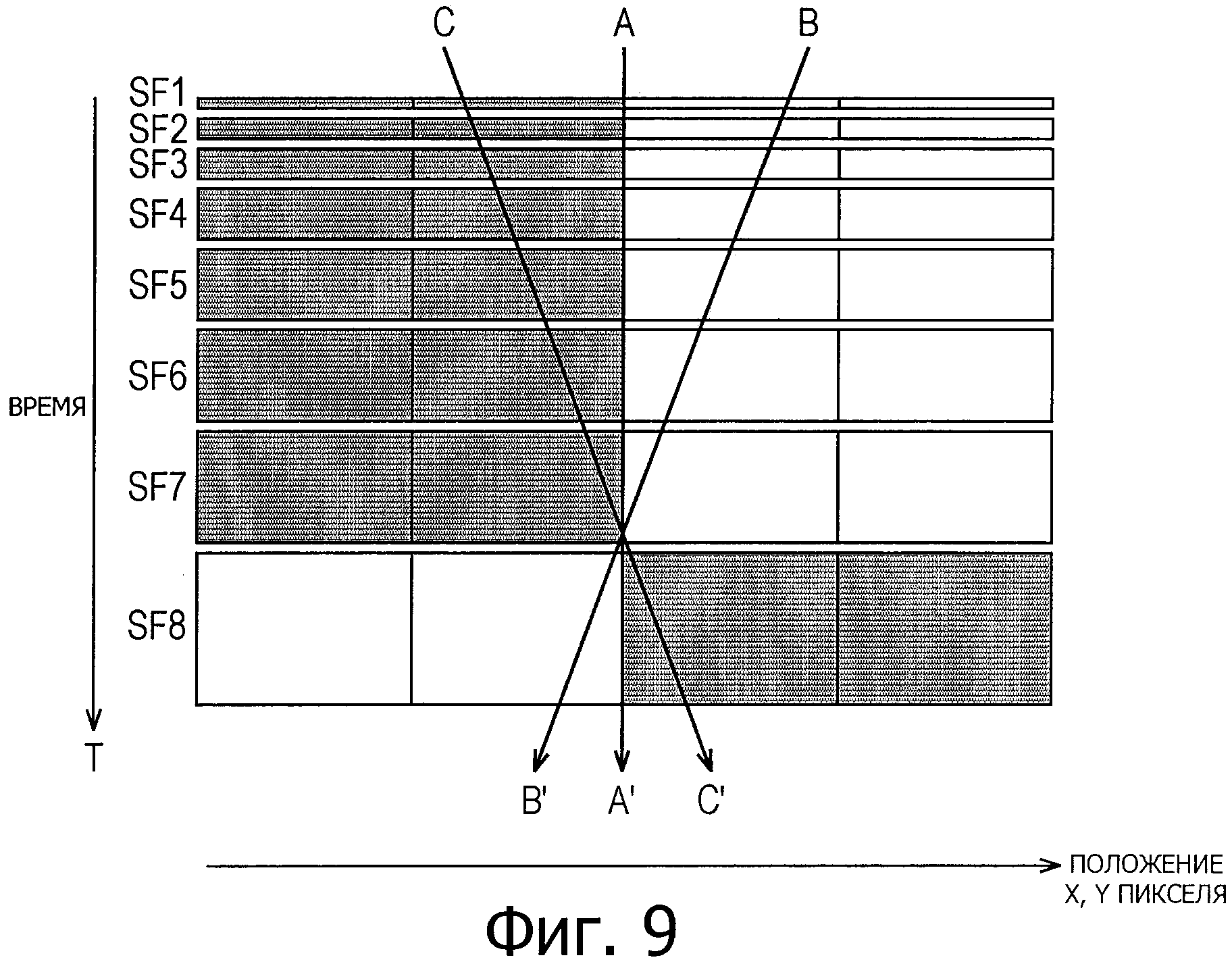

На фиг.9 показана схема, описывающая генерирование ложного контура.

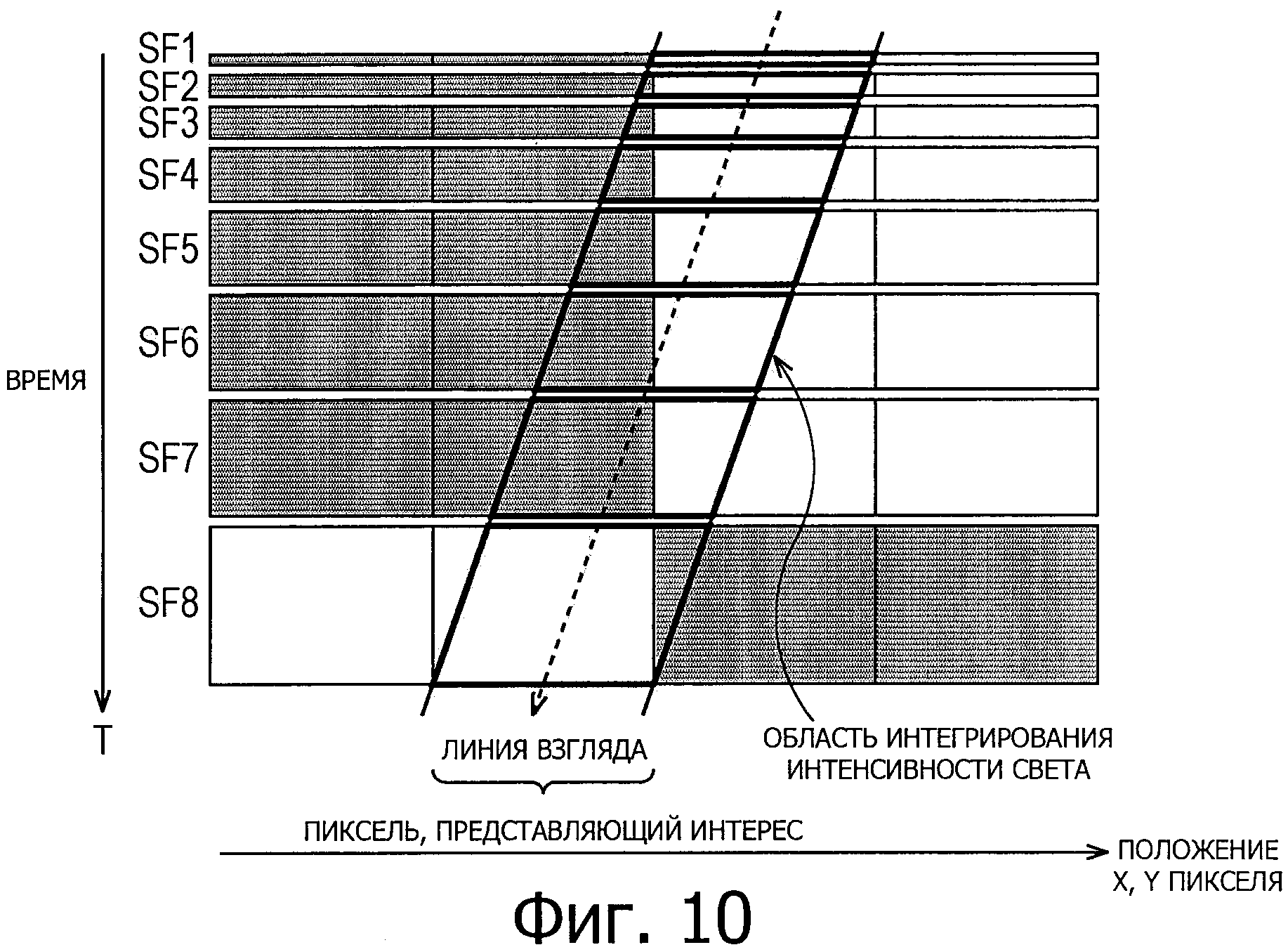

На фиг.10 показана схема, иллюстрирующая область интегрирования интенсивности света.

На фиг.11 показана схема, иллюстрирующая область интегрирования интенсивности света.

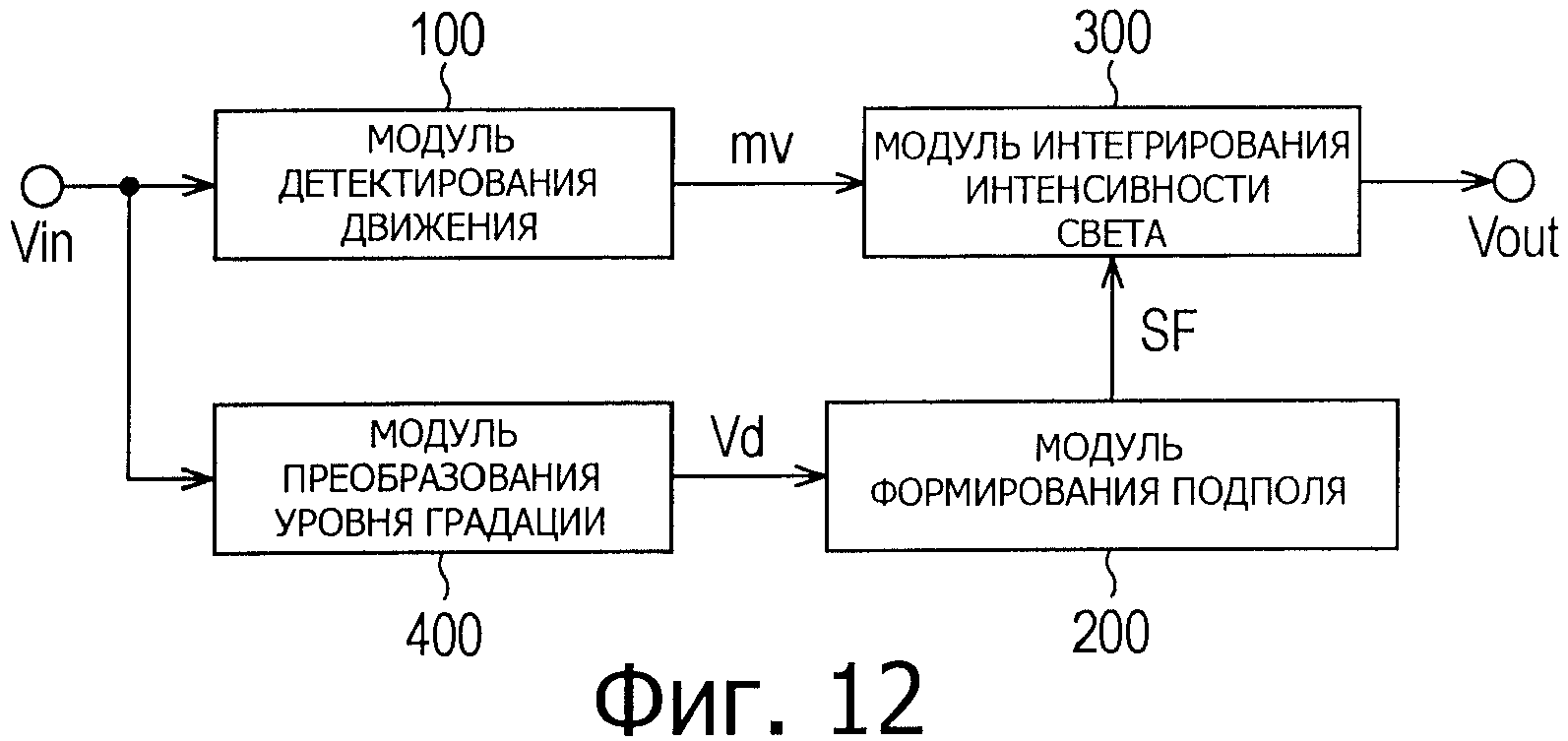

На фиг.12 показана блок-схема, иллюстрирующая пример структуры второго варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

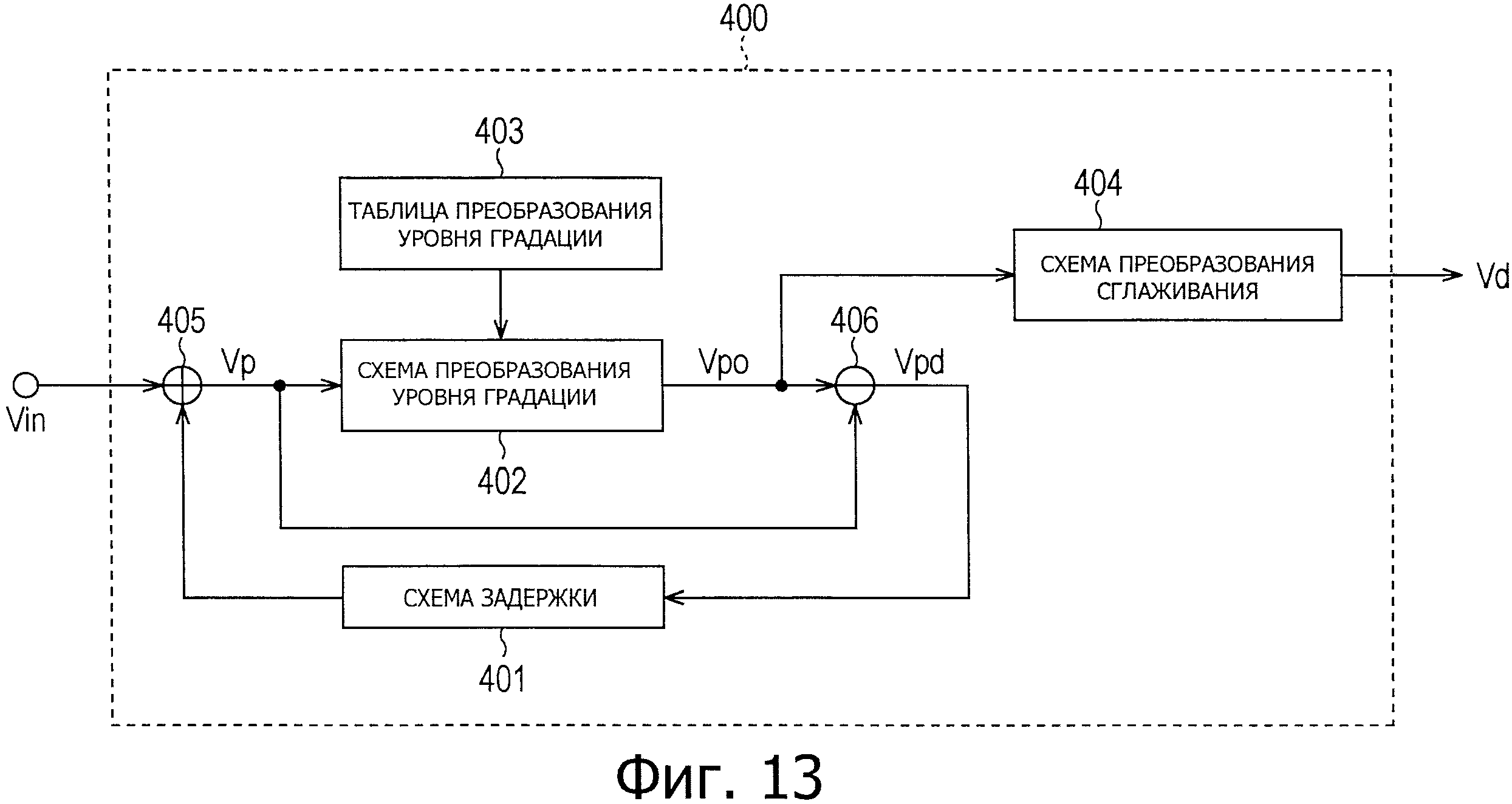

На фиг.13 показана блок-схема, иллюстрирующая примерную структуру модуля 400 преобразования уровня градации.

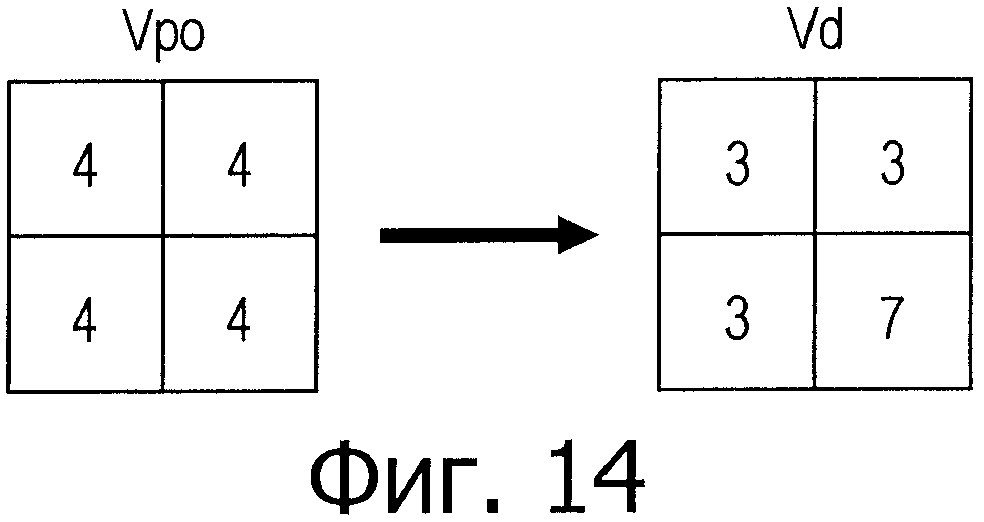

На фиг.14 показана схема, описывающая работу схемы 404 преобразования сглаживания.

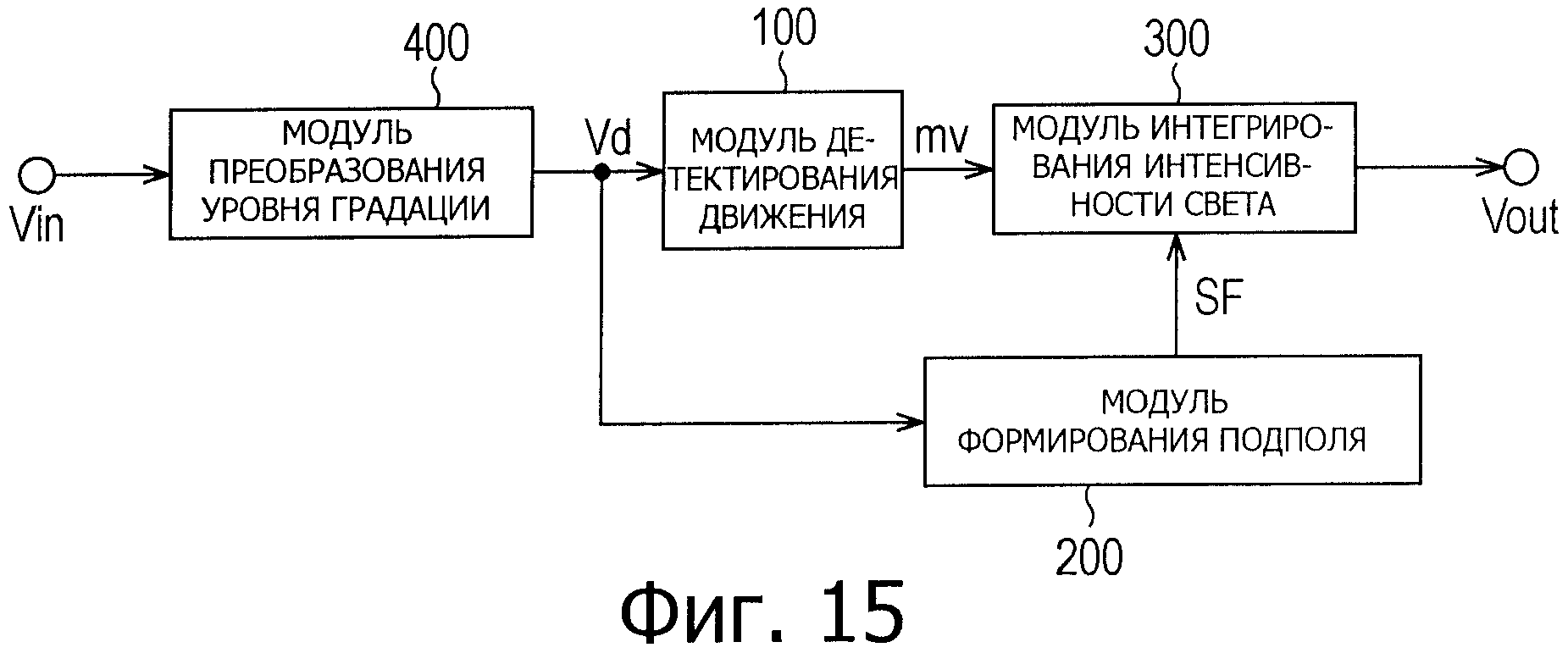

На фиг.15 показана блок-схема, иллюстрирующая примерную структуру третьего варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

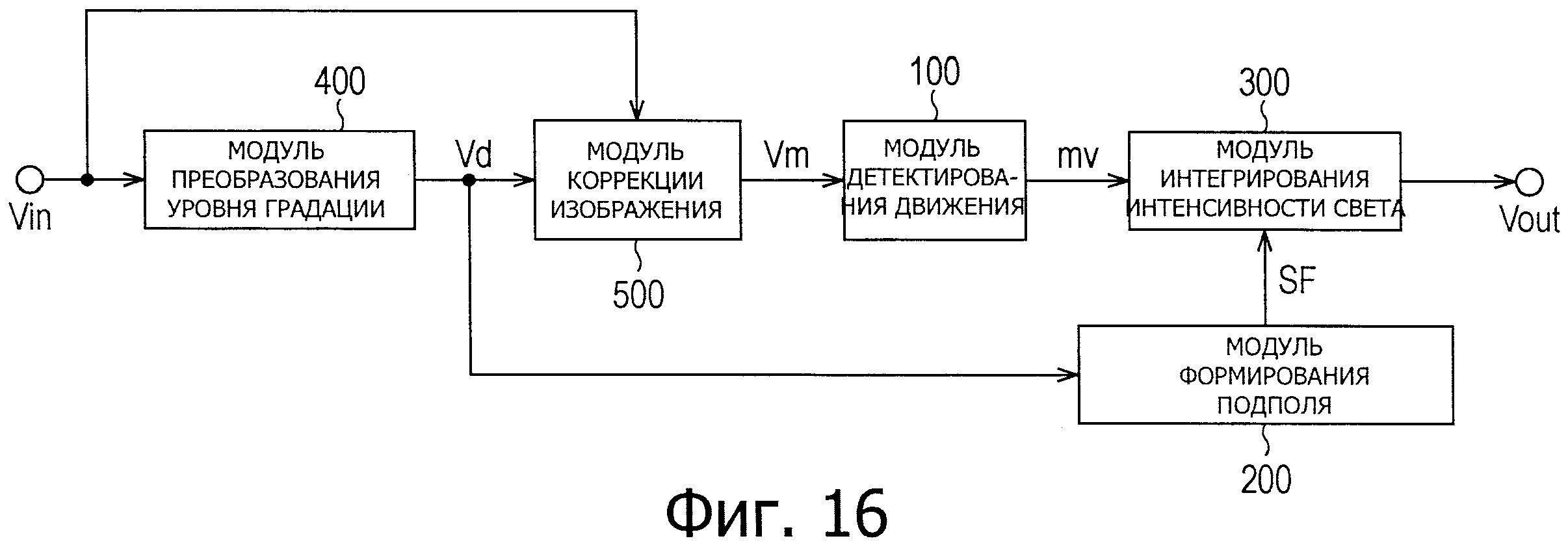

На фиг.16 показана блок-схема, иллюстрирующая примерную структуру четвертого варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

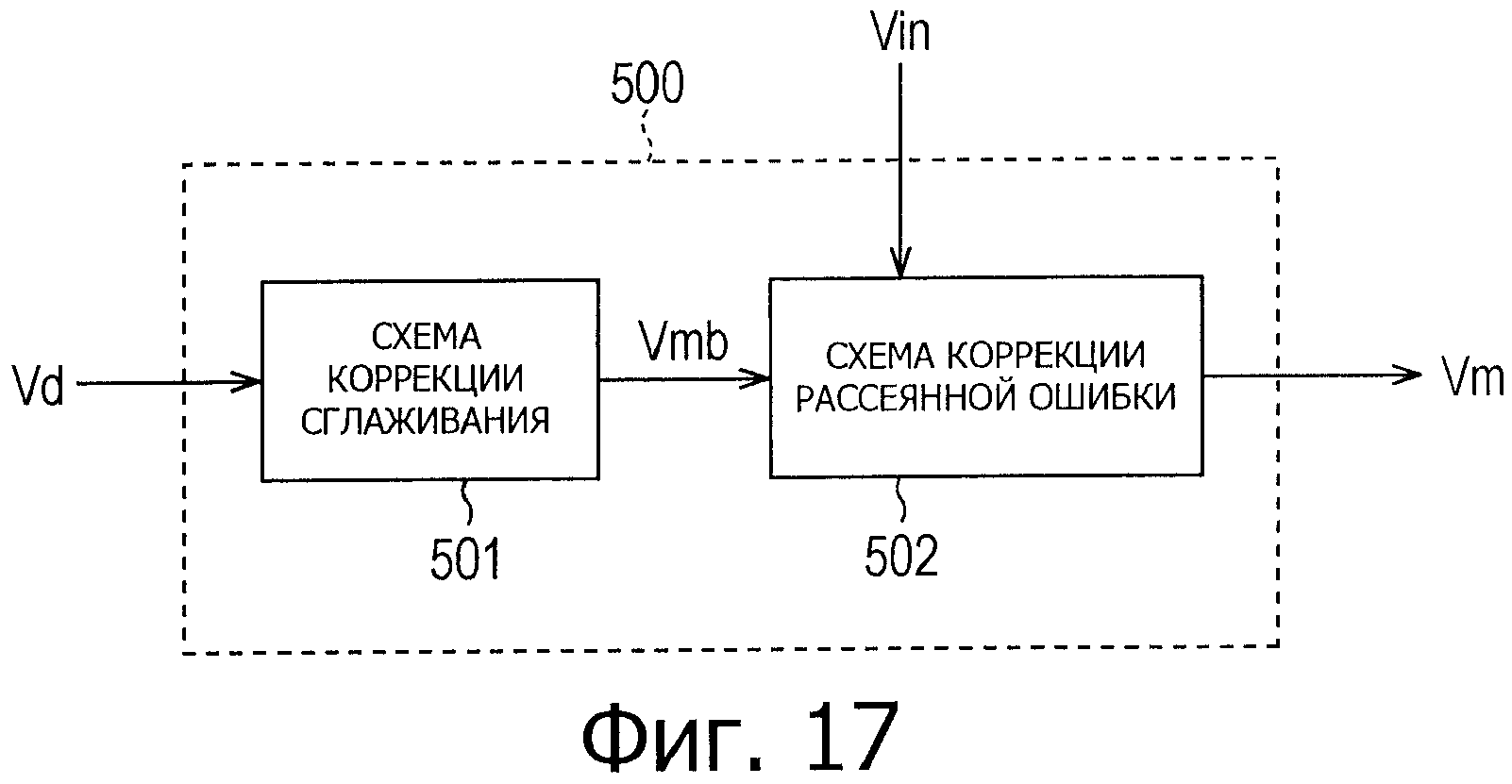

На фиг.17 показана блок-схема, иллюстрирующая примерную структуру модуля 500 коррекции изображения.

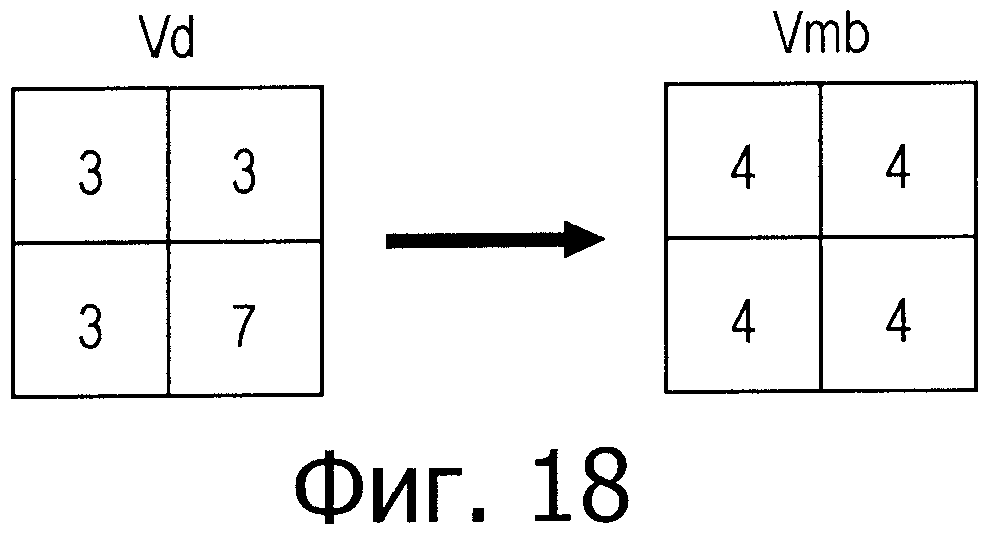

На фиг.18 показана схема, описывающая работу схемы 501 коррекции сглаживания.

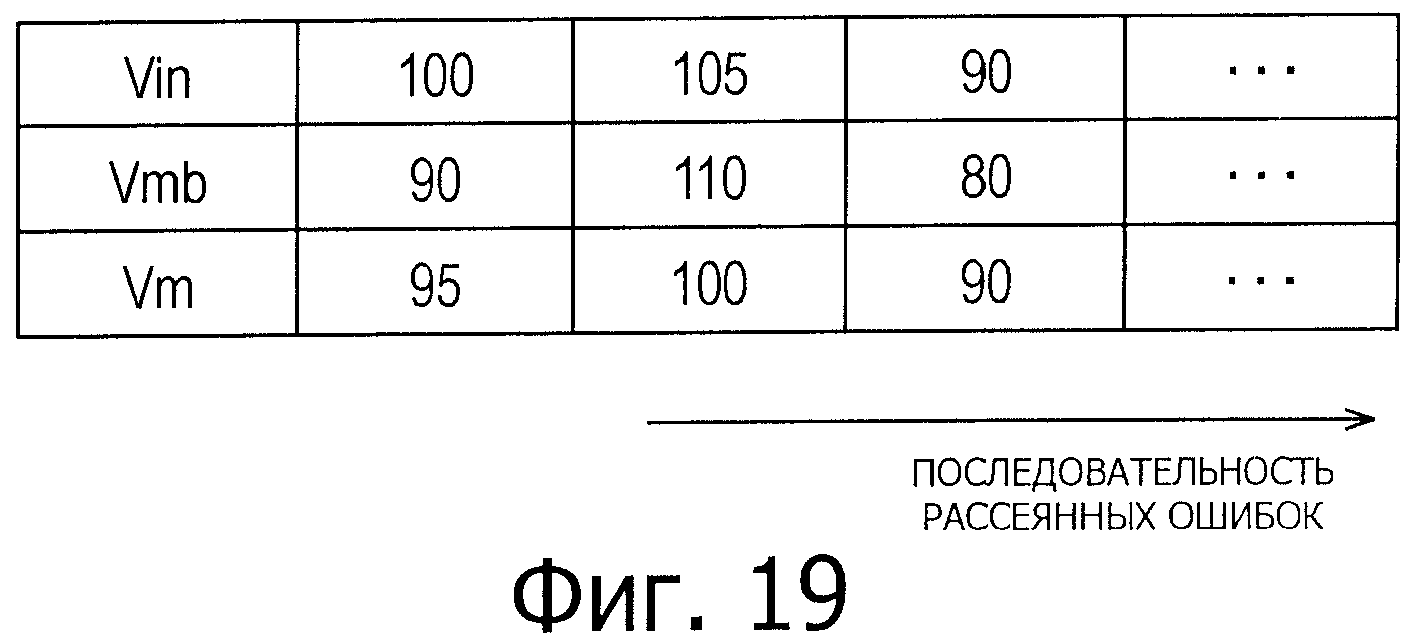

На фиг.19 показана схема, описывающая работу схемы 502 коррекции рассеянной ошибки.

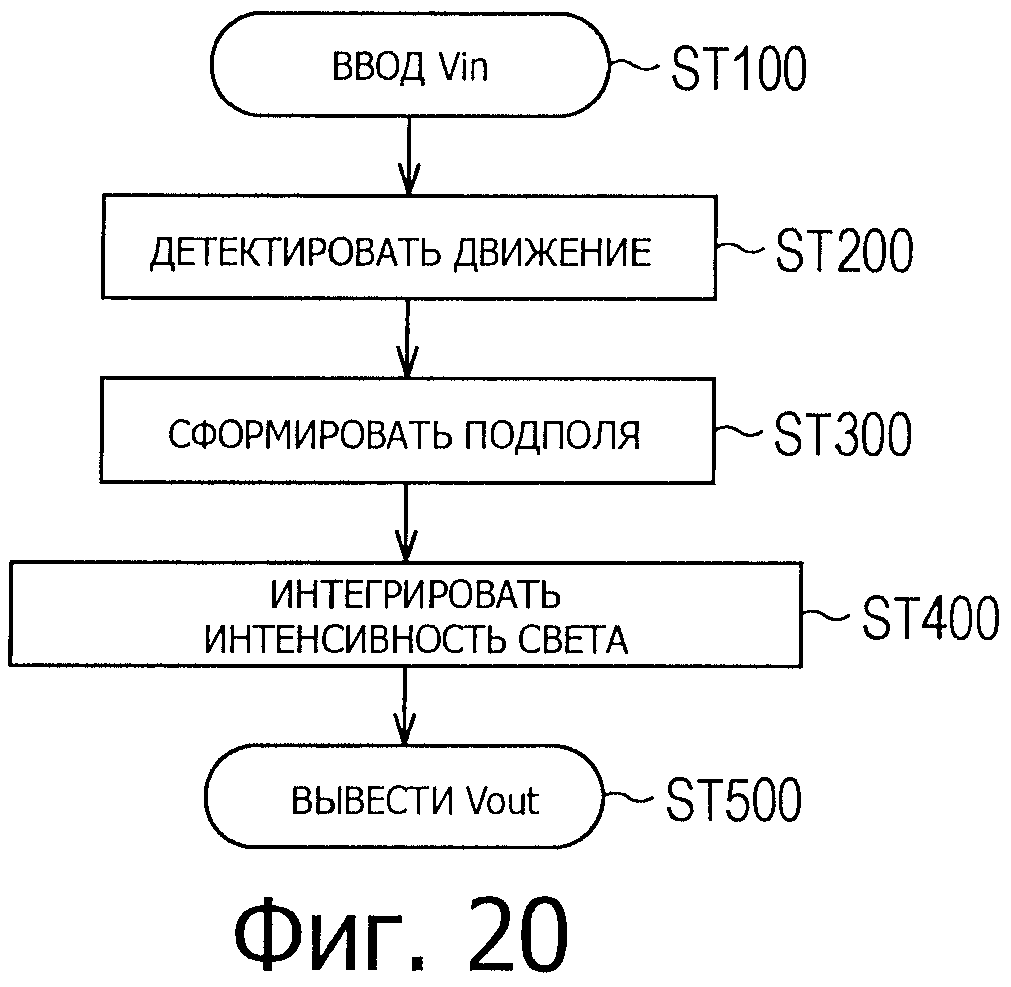

На фиг.20 показана блок-схема последовательности операций, иллюстрирующая работу первого варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

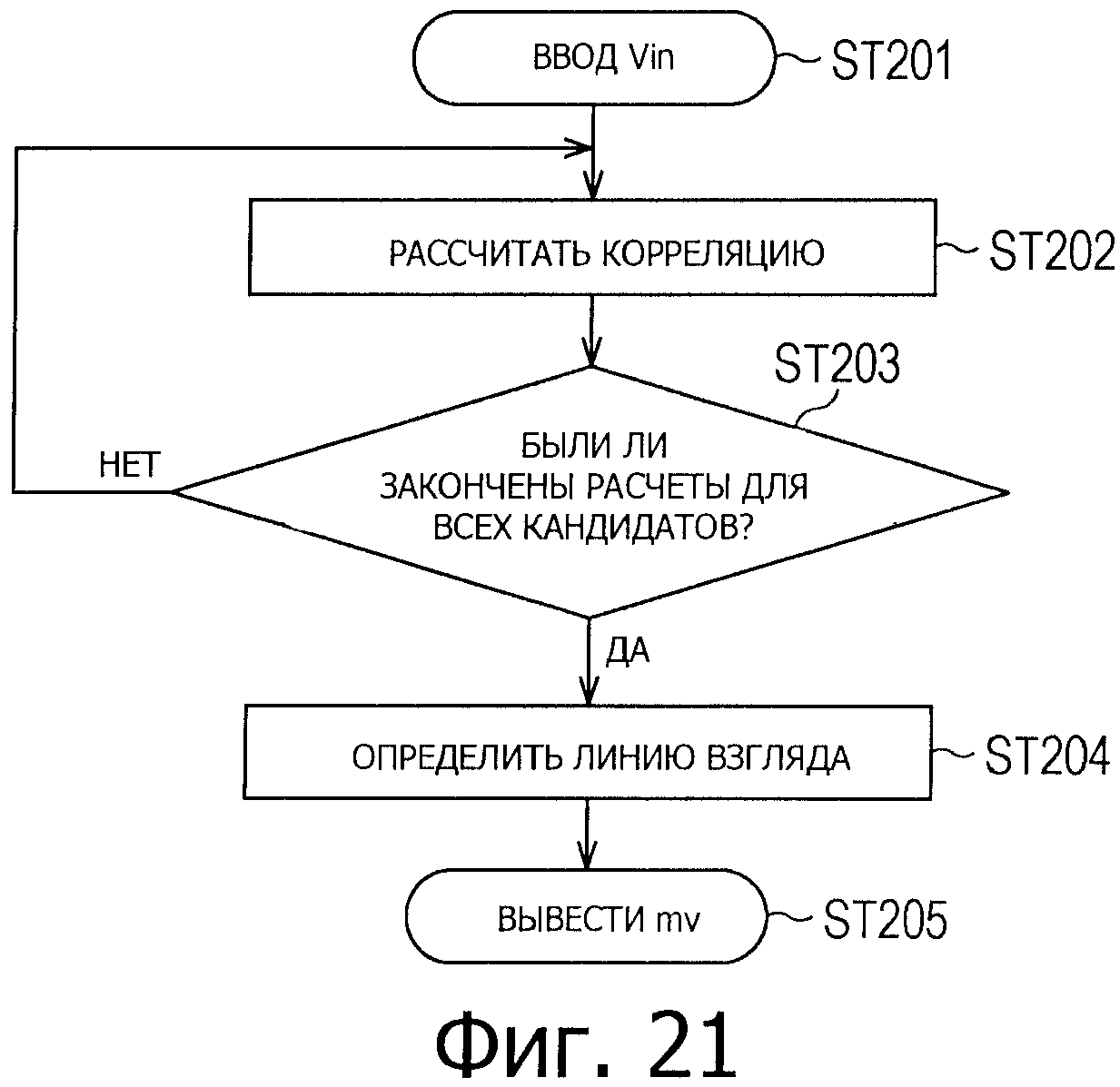

На фиг.21 показана блок-схема последовательности операций, описывающая обработку детектирования движения.

На фиг.22 показана блок-схема последовательности операций, описывающая обработку формирования изображения по подполям.

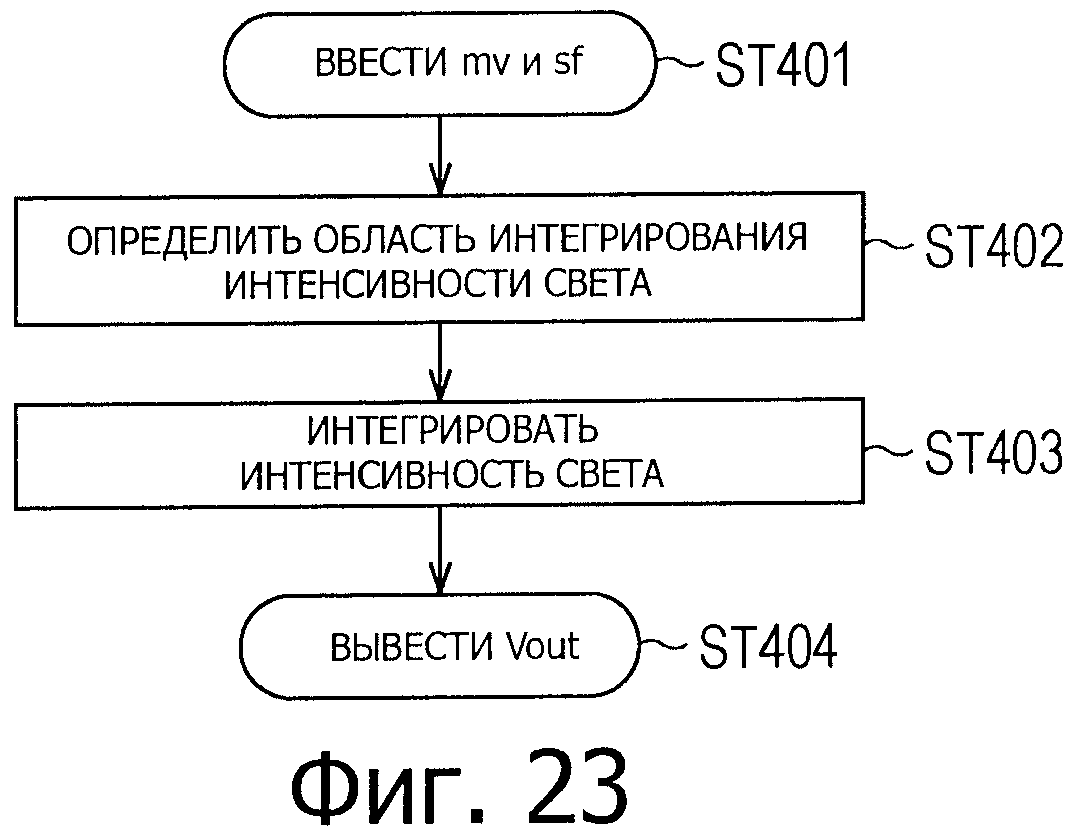

На фиг.23 показана блок-схема последовательности операций, описывающая обработку интегрирования интенсивности света.

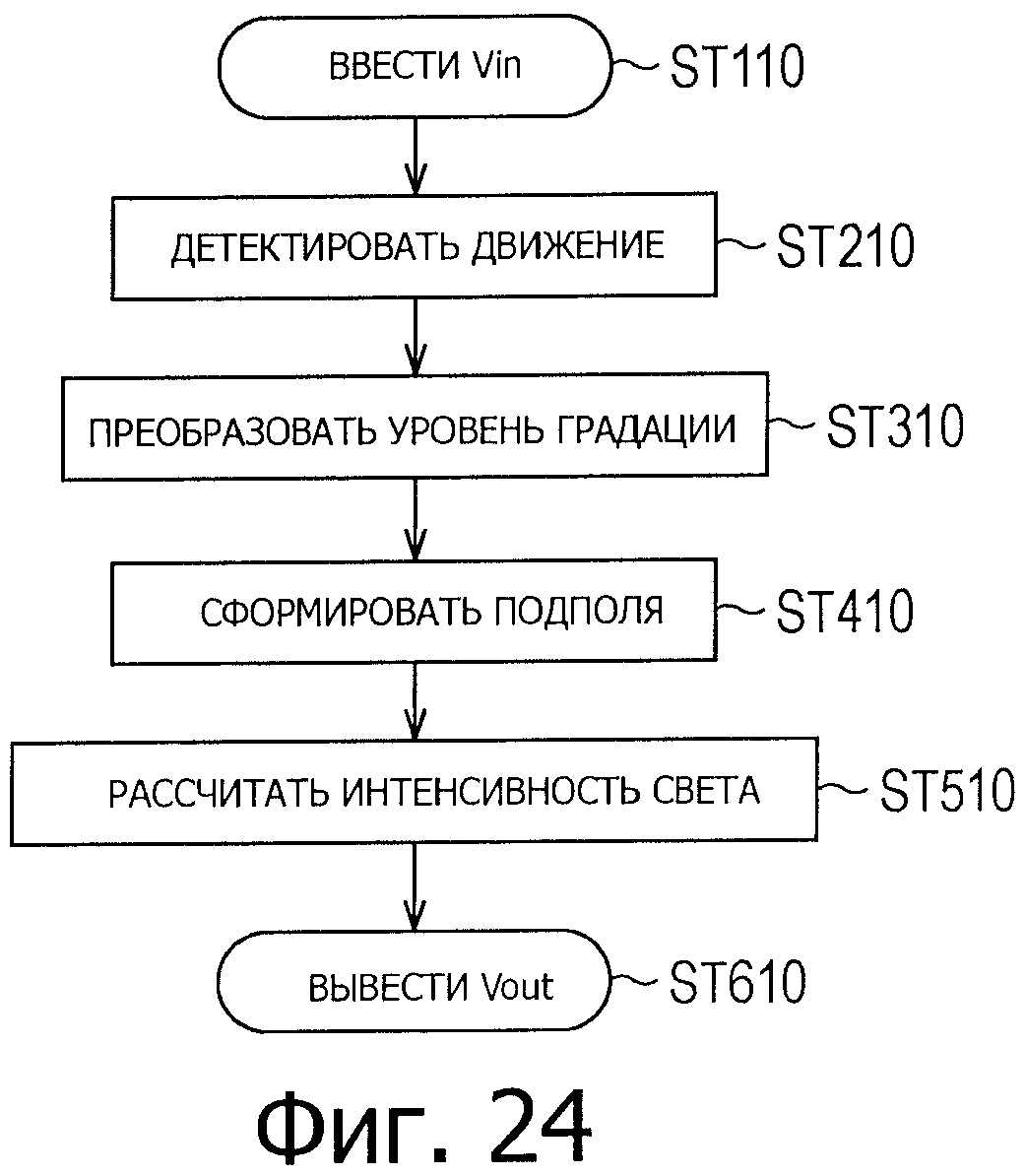

На фиг.24 показана блок-схема последовательности операций, иллюстрирующая работу второго варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

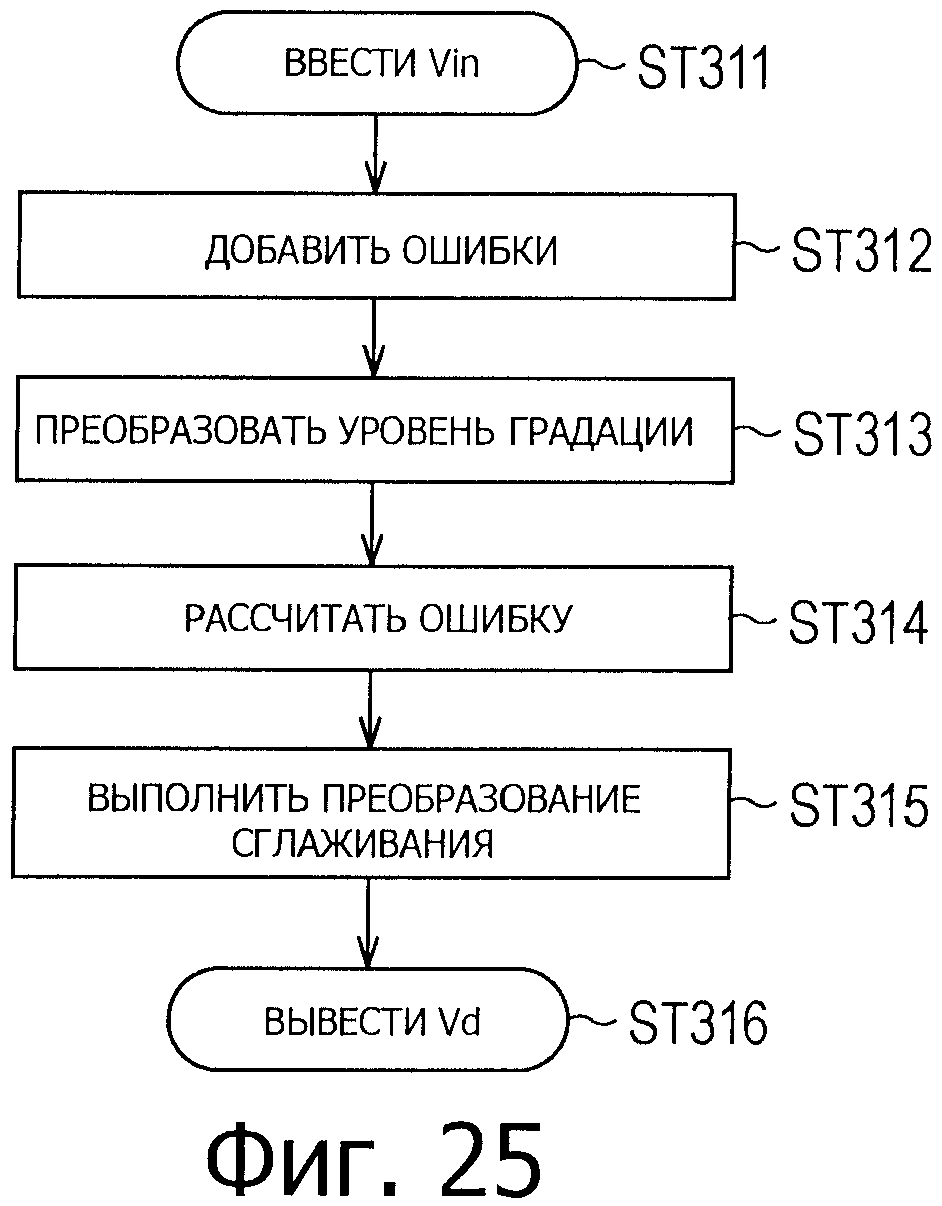

На фиг.25 показана блок-схема последовательности операций, описывающая обработку преобразования уровня градаций.

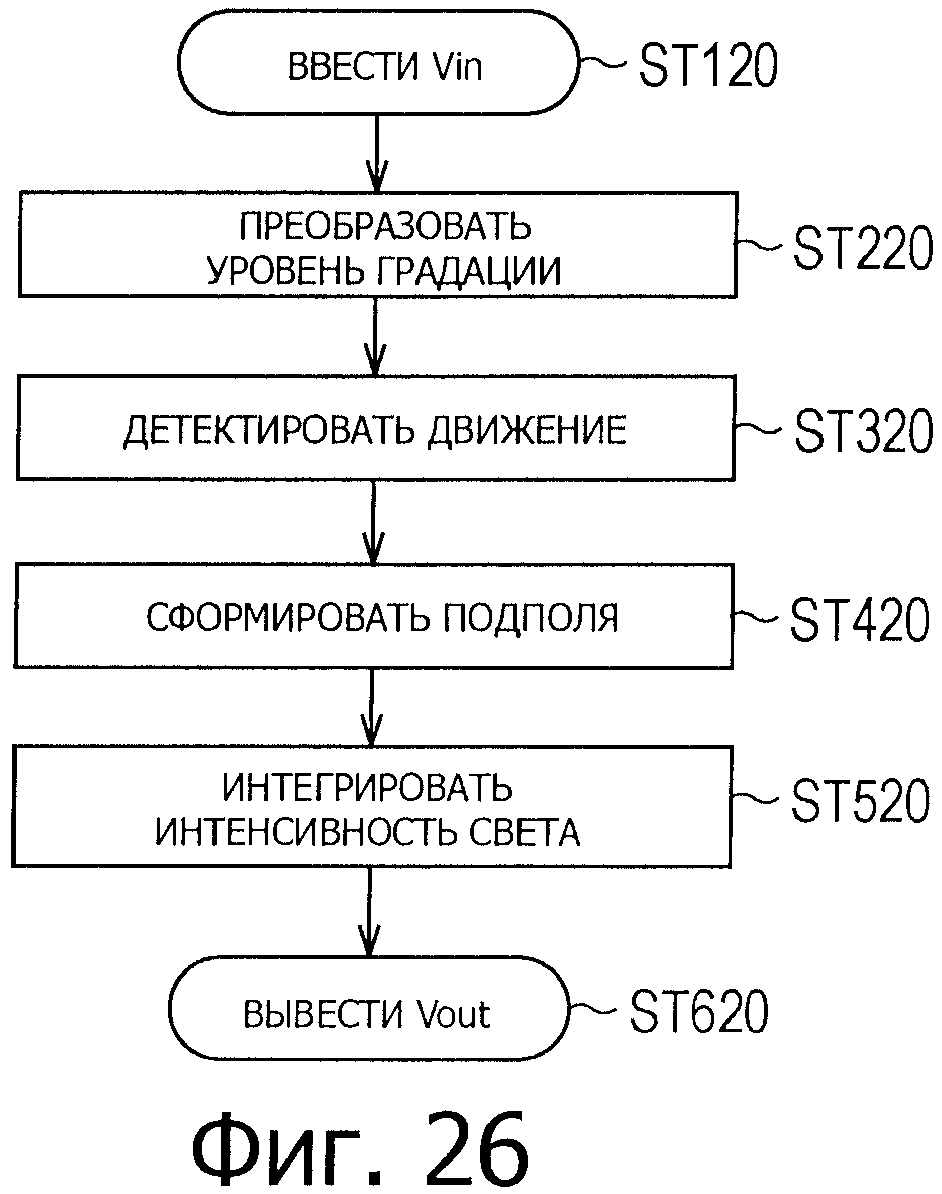

На фиг.26 показана блок-схема последовательности операций, иллюстрирующая работу третьего варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

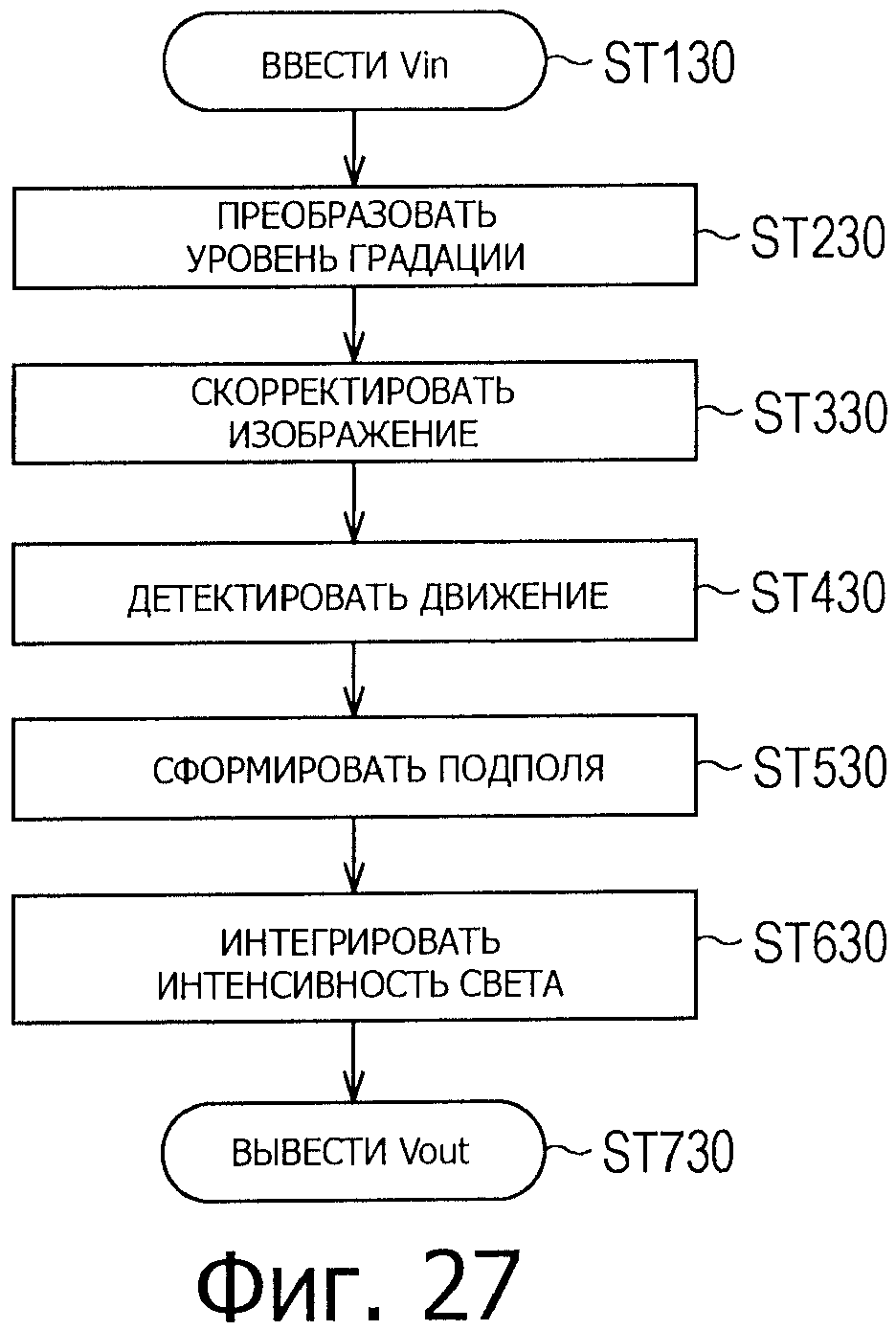

На фиг.27 показана блок-схема последовательности операций, иллюстрирующая работу четвертого варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

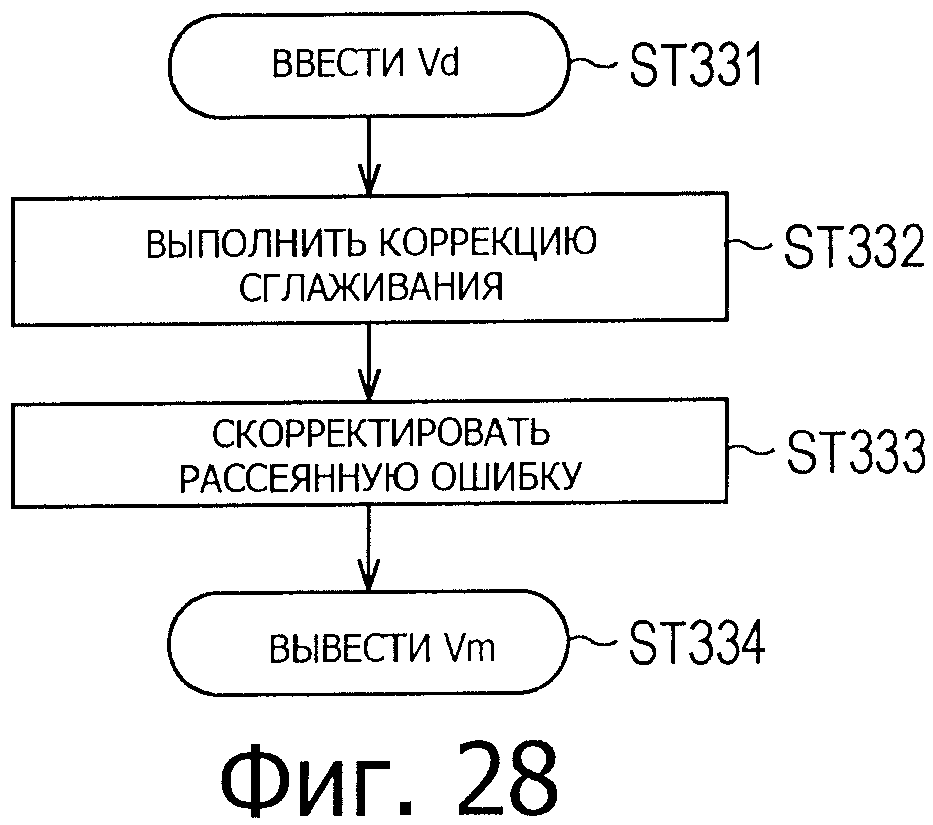

На фиг.28 показана блок-схема последовательности операций, описывающая обработку коррекции изображения.

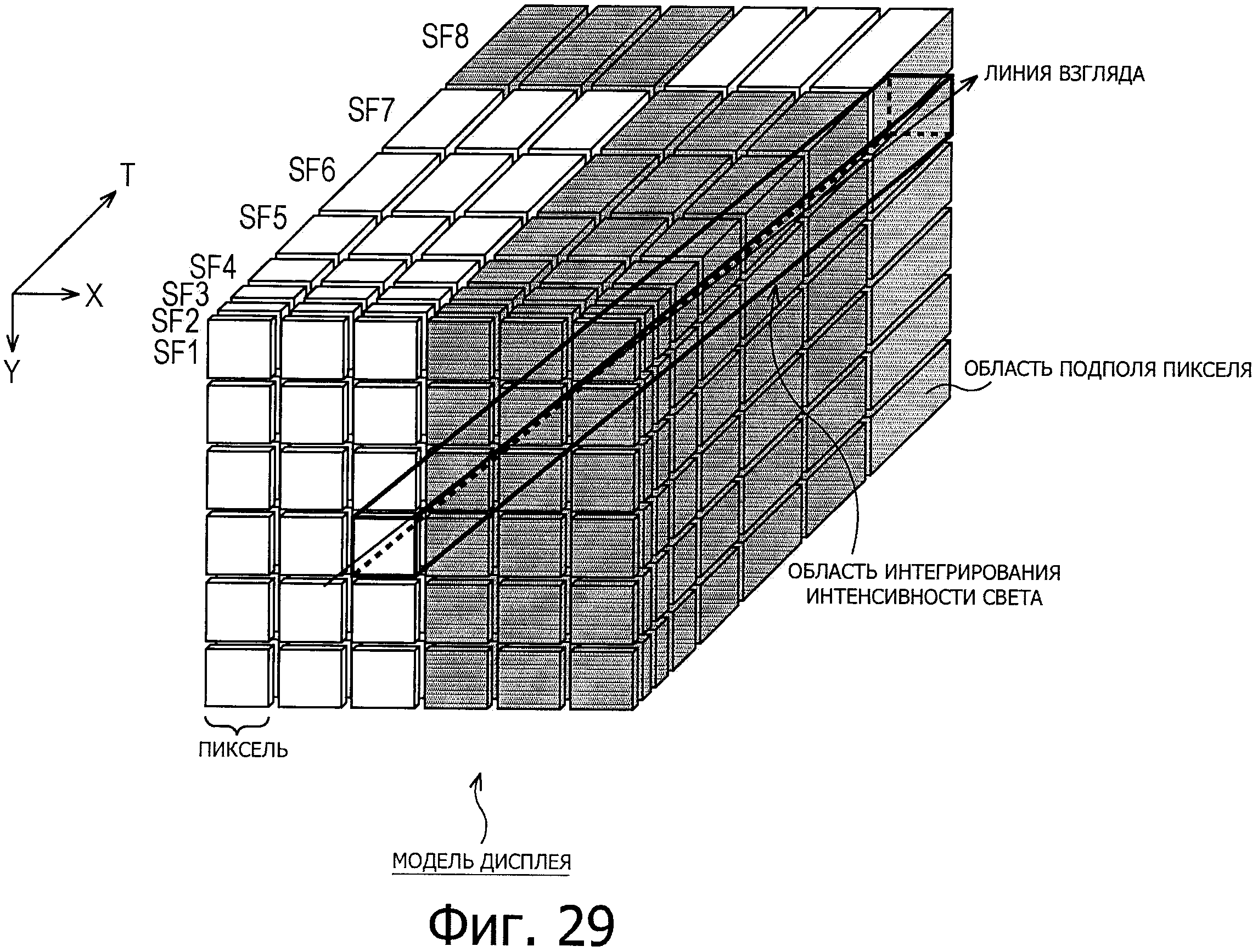

На фиг.29 показана схема, иллюстрирующая модель дисплея.

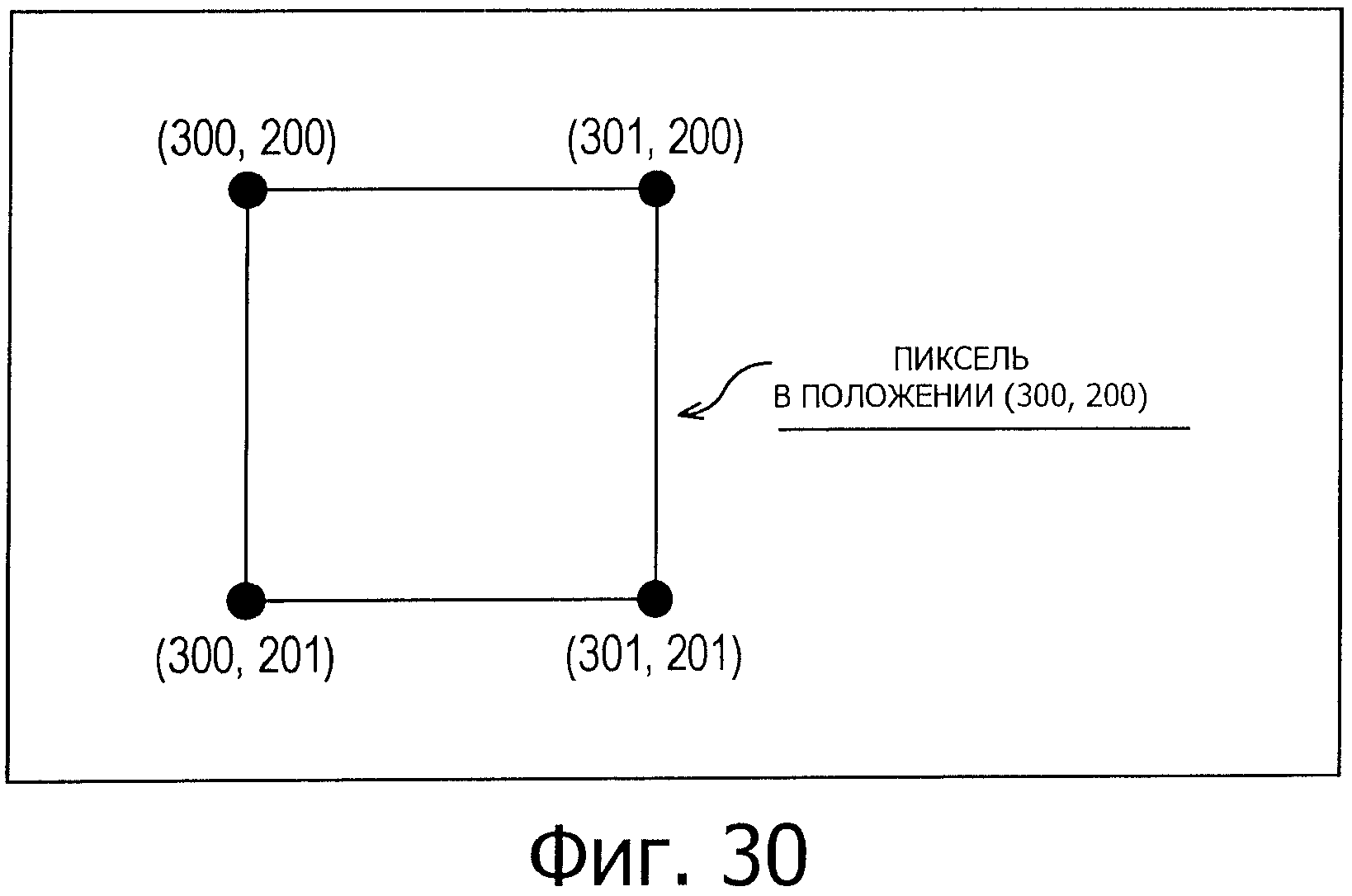

На фиг.30 показана схема, иллюстрирующая пиксель в модели дисплея.

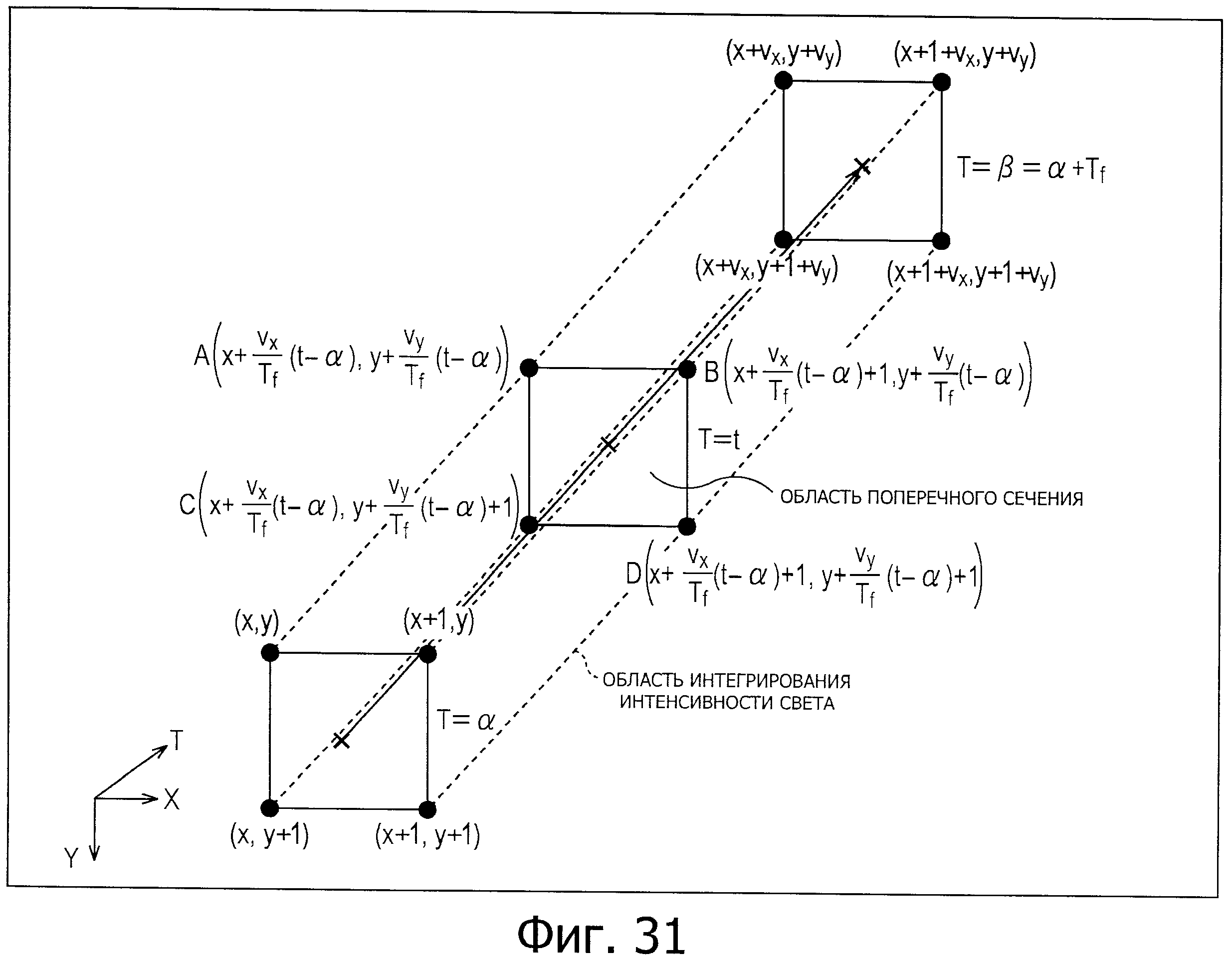

На фиг.31 показана схема, иллюстрирующая область интегрирования интенсивности света в модели дисплея.

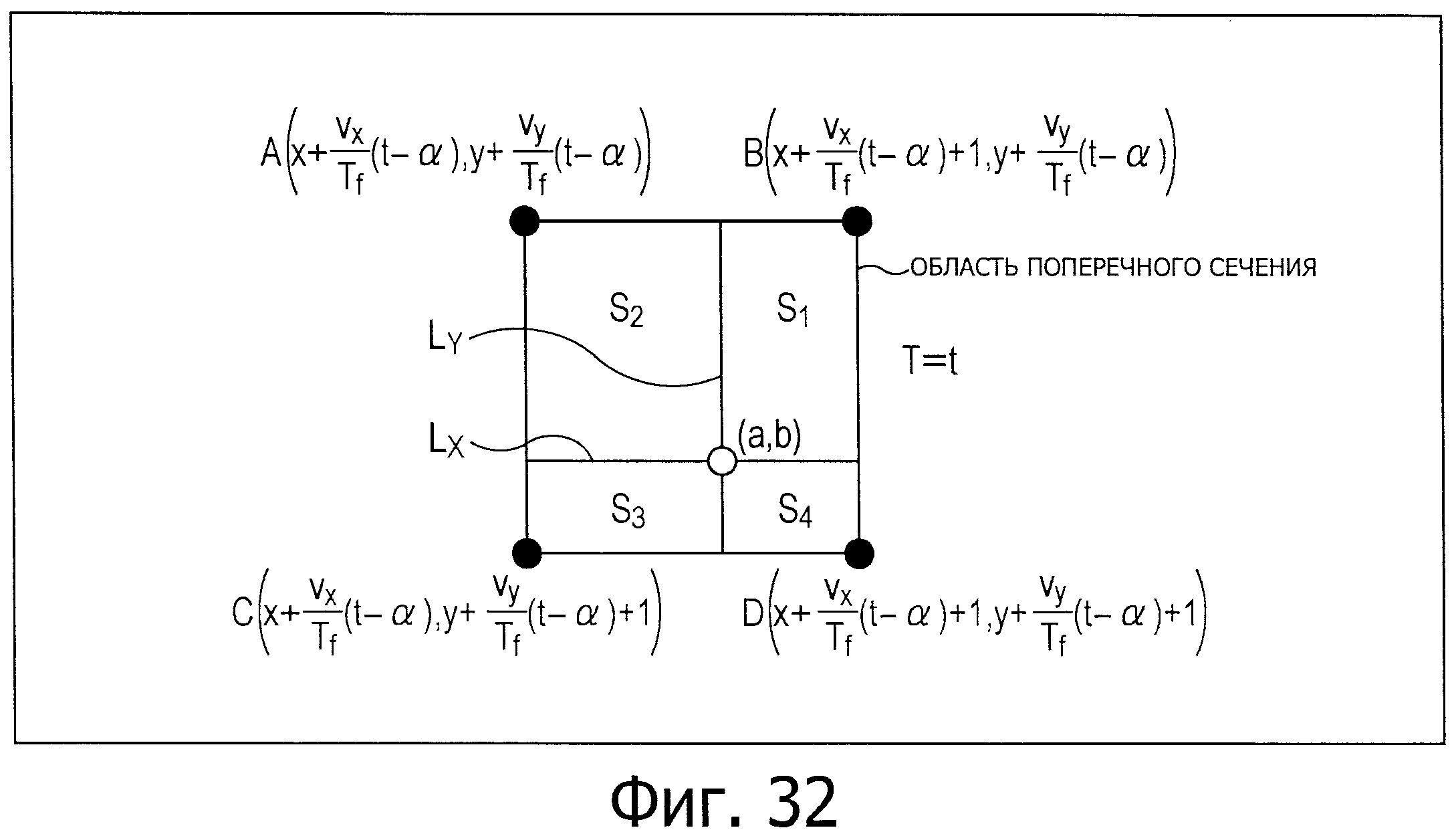

На фиг.32 показана схема, иллюстрирующая область поперечного сечения.

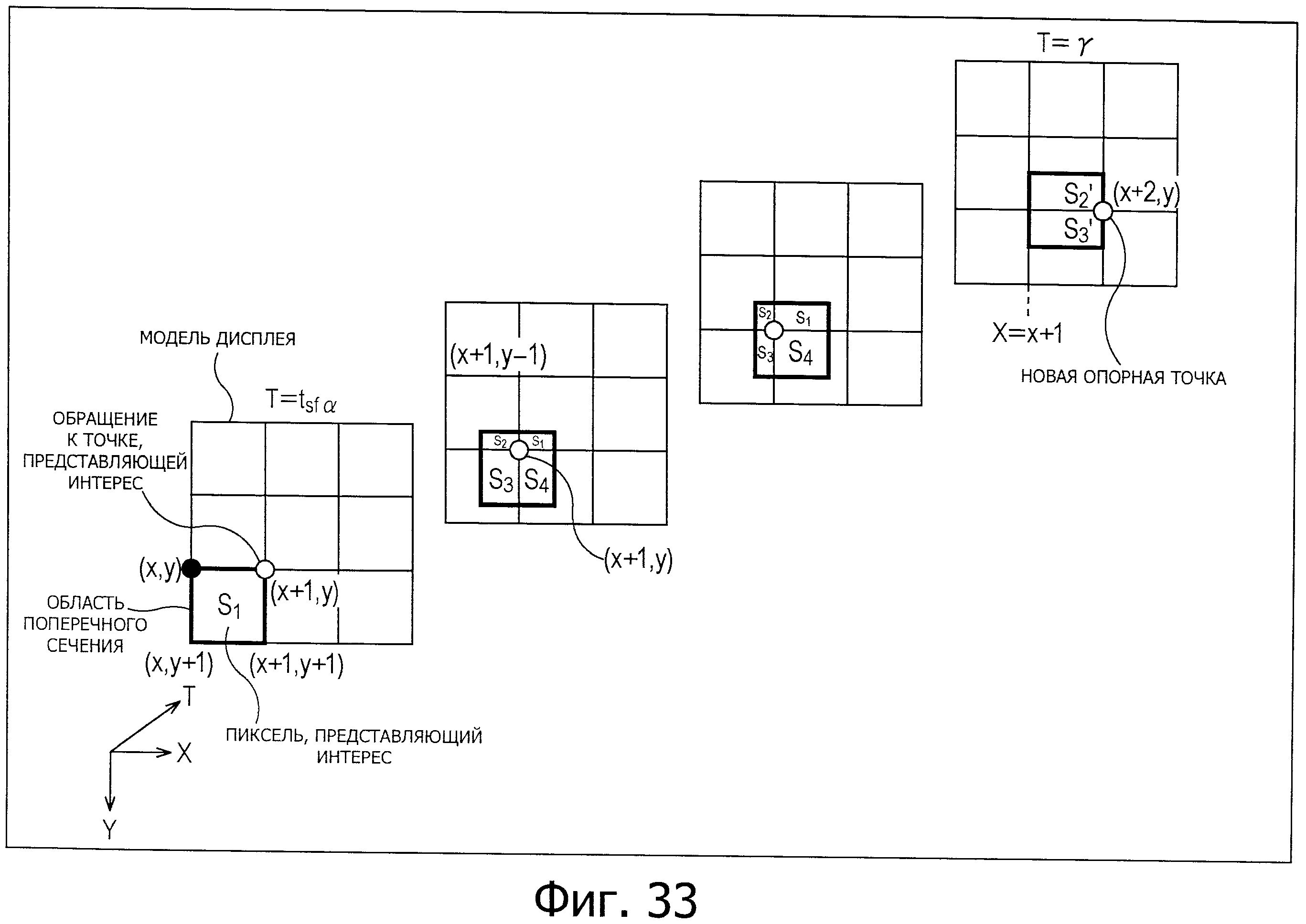

На фиг.33 показана схема, иллюстрирующая область поперечного сечения, движущуюся в модели дисплея, по мере того, как протекает время Т.

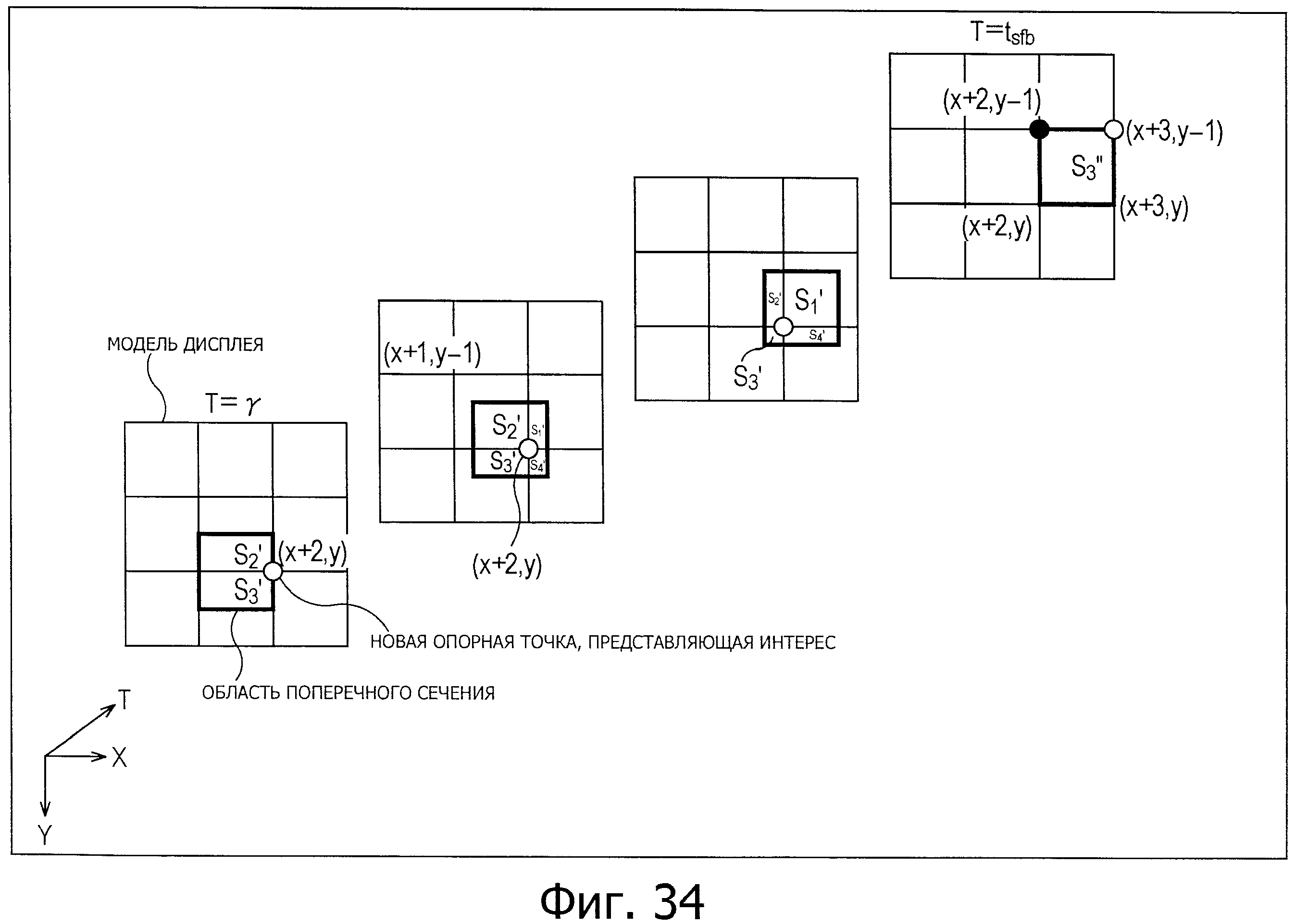

На фиг.34 показана схема, иллюстрирующая область поперечного сечения, движущуюся в модели дисплея, по мере того, как протекает время Т.

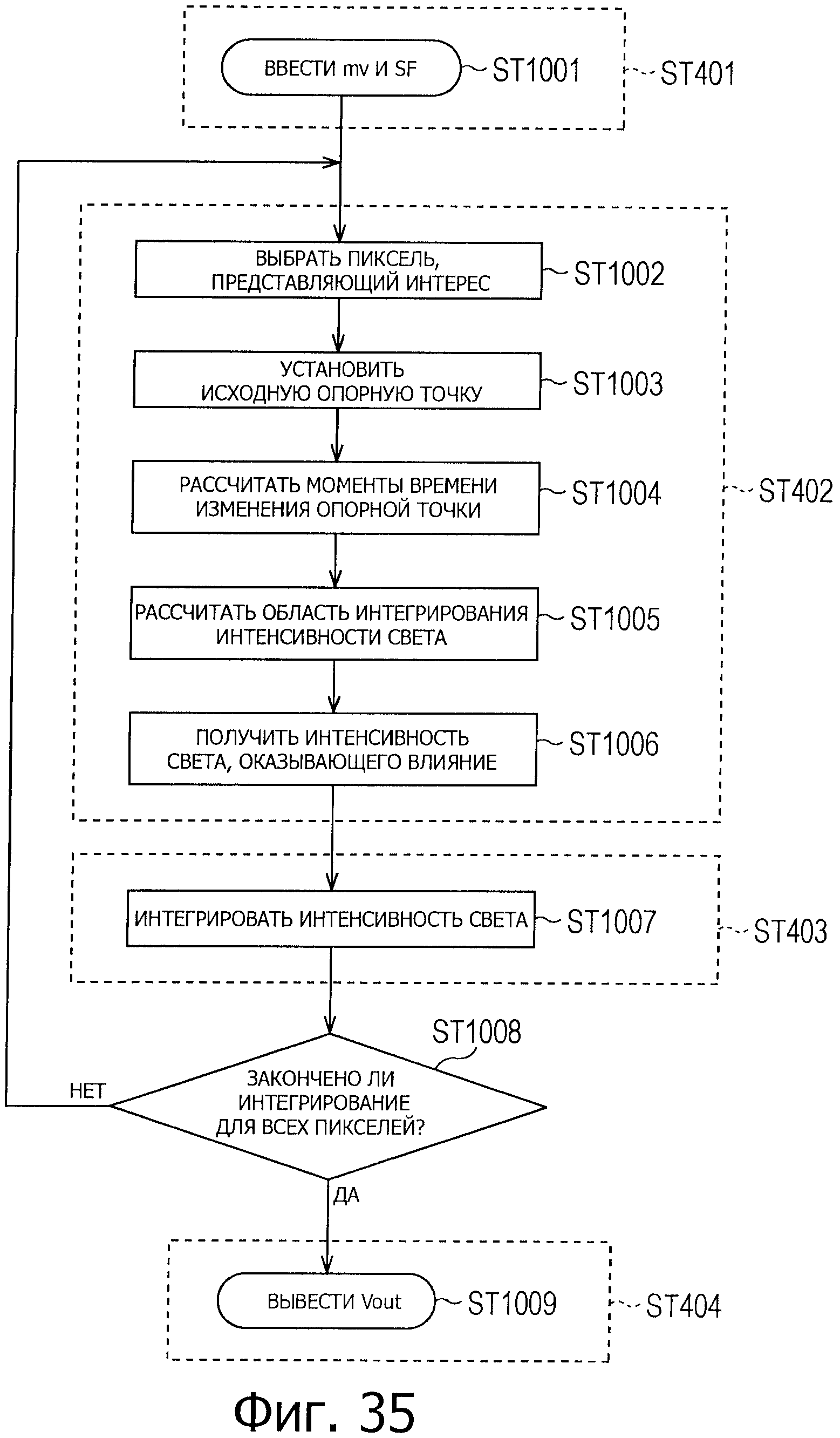

На фиг.35 показана блок-схема последовательности операций, описывающая обработку интегрирования интенсивности света.

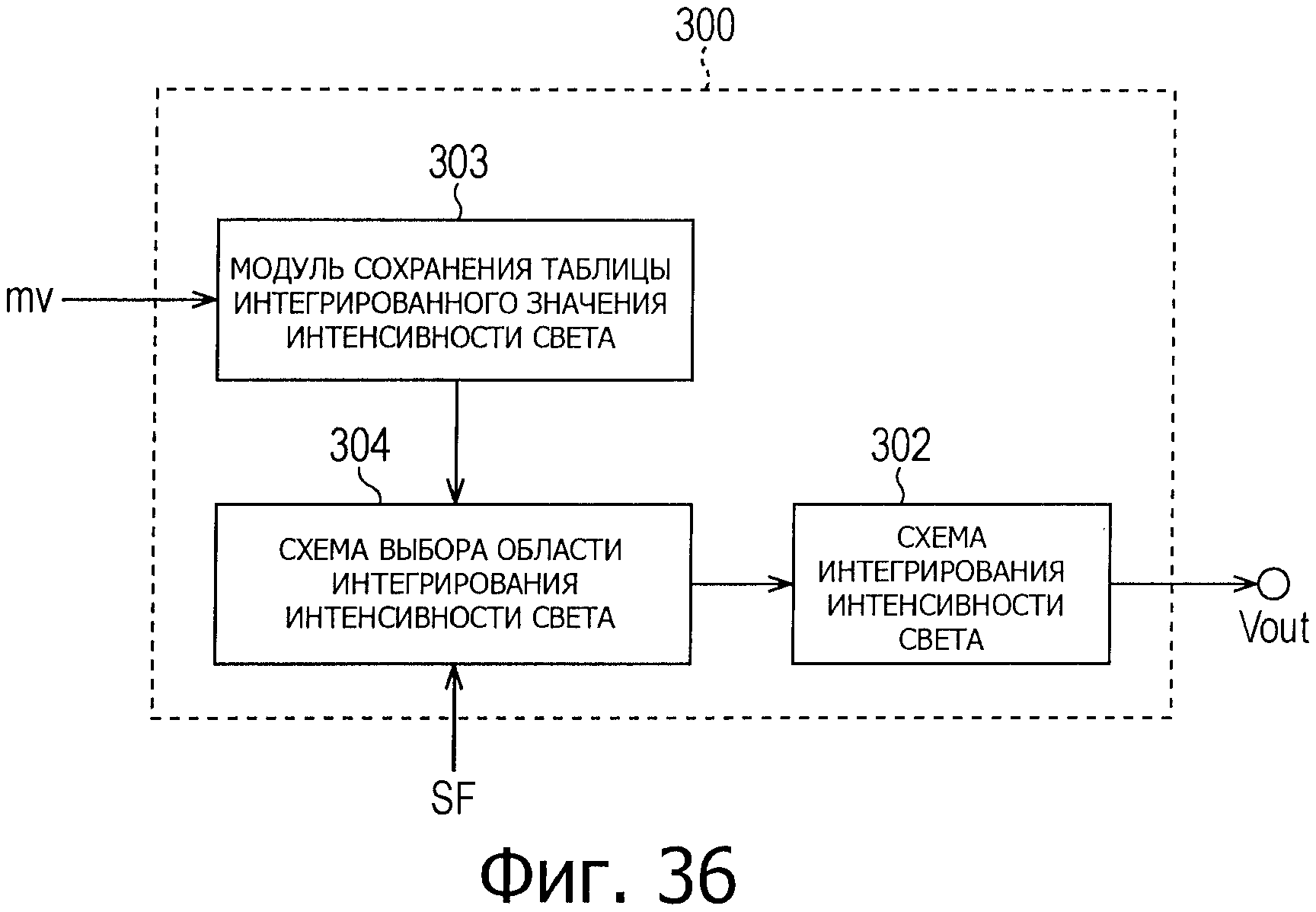

На фиг.36 показана блок-схема, иллюстрирующая другую примерную структуру модуля 300 интегрирования интенсивности света.

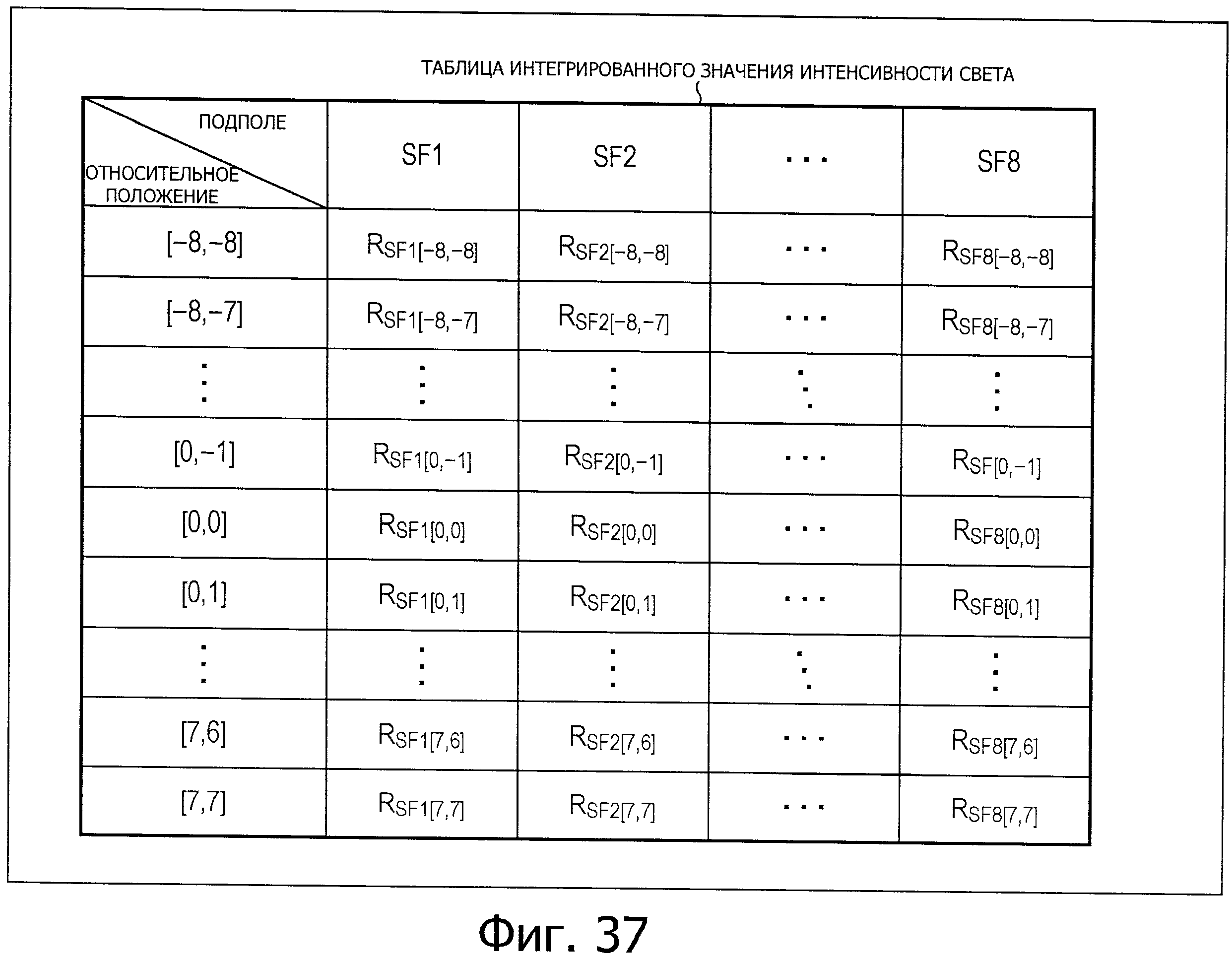

На фиг.37 показана схема, иллюстрирующая таблицу интегрированного значения интенсивности света.

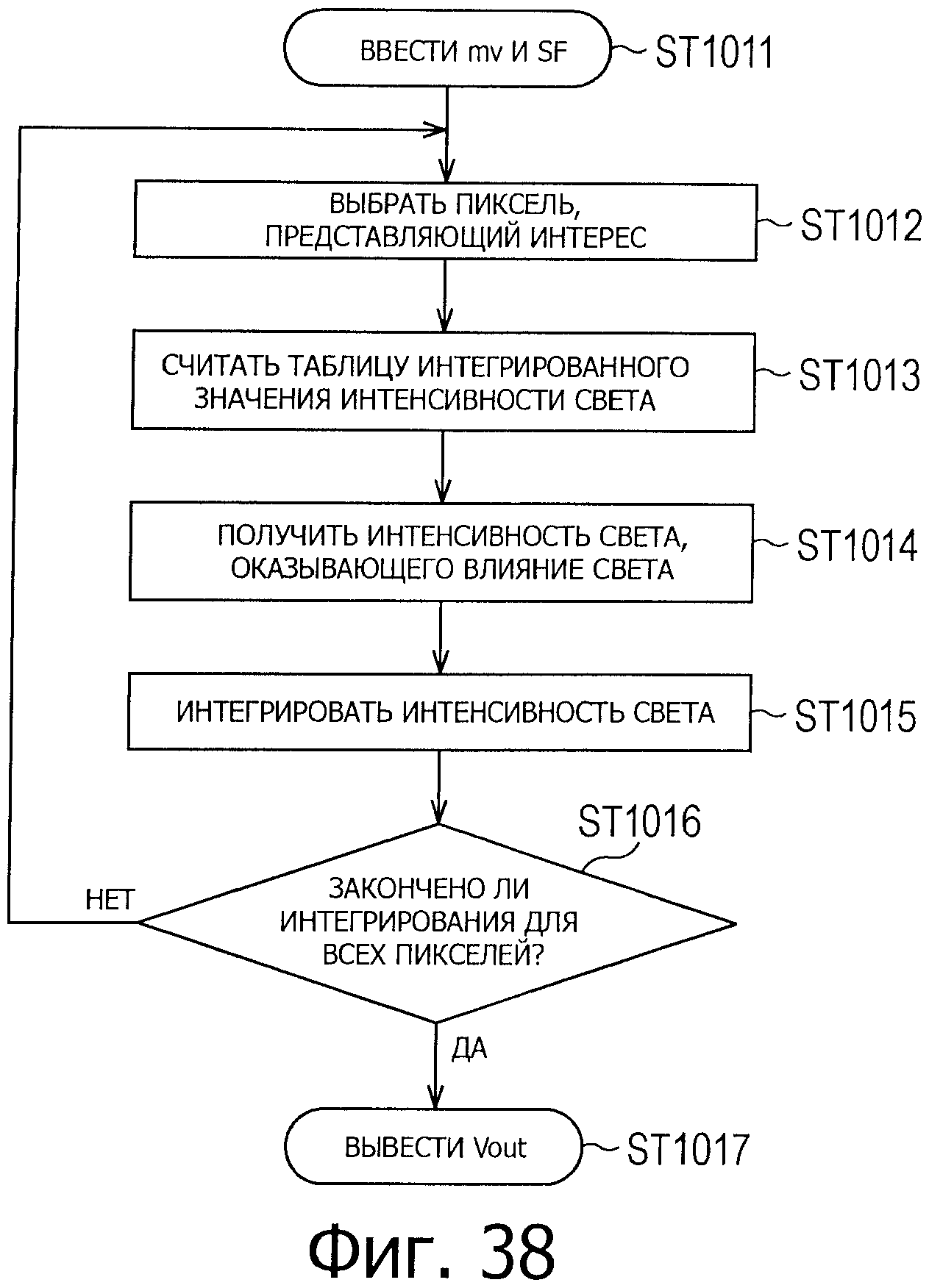

На фиг.38 показана блок-схема последовательности операций, описывающая обработку интегрирования интенсивности света.

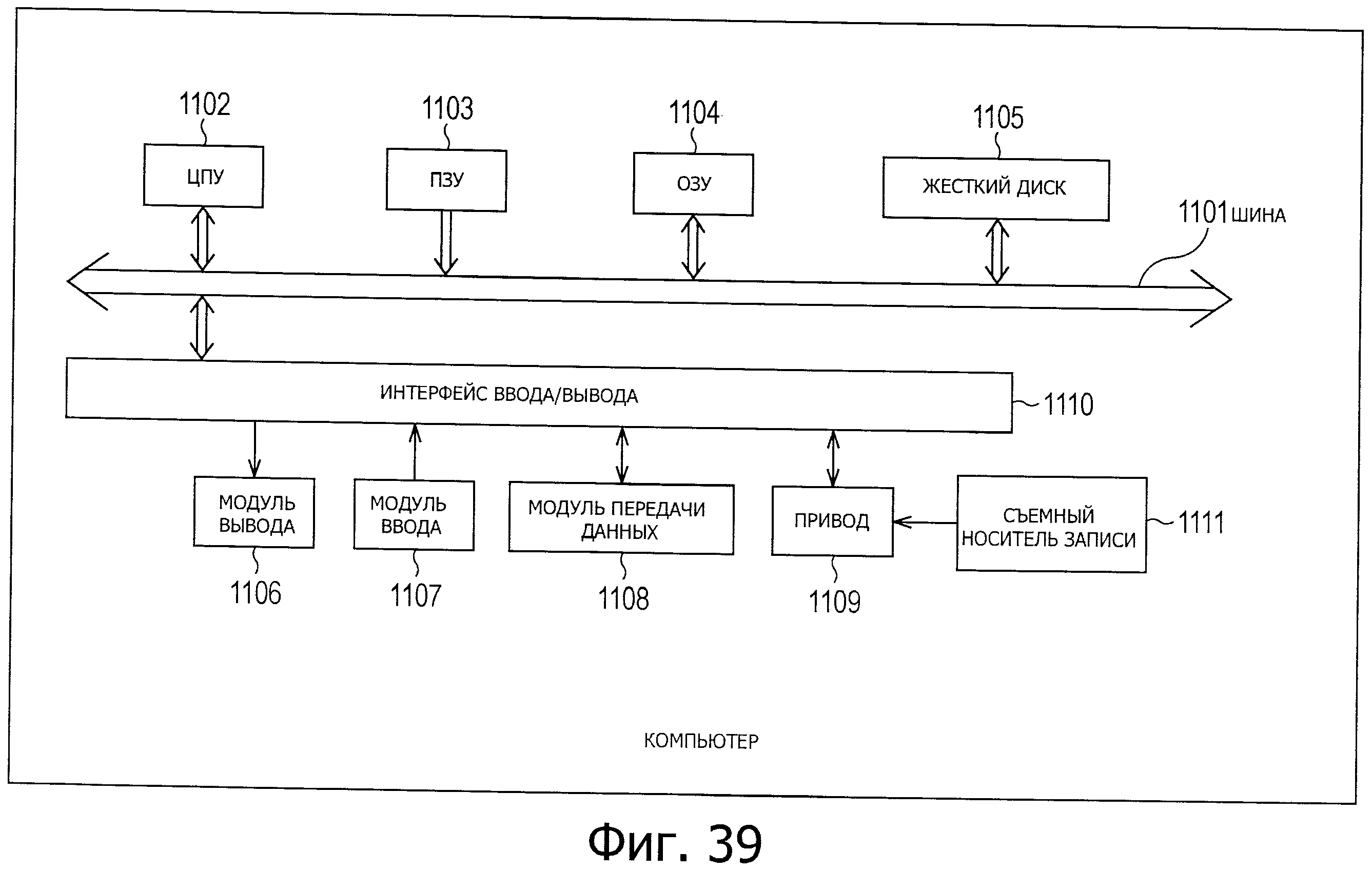

На фиг.39 показана блок-схема, иллюстрирующая пример структуры варианта воплощения компьютера, в котором применяется настоящее изобретение.

Пояснение номеров ссылочных позиций

100 модуль детектирования движения, 101 схема расчета корреляции, 102 схема задержки, 103 схема определения линии взгляда, 200 модуль формирования подполя, 201 схема назначения подполя, 202 схема определения излучения света, 300 модуль интегрирования интенсивности света, 301 схема определения области интегрирования интенсивности света, 302 схема интегрирования интенсивности света, 303 модуль сохранения таблицы интегрированного значения интенсивности света, 304 схема выбора области интегрирования интенсивности света, 400 модуль преобразования уровня градации, 401 схема задержки, 402 схема преобразования уровня градации, 403 таблица преобразования уровня градации, 404 схема преобразования сглаживания, 405, 406 модули расчета, 500 модуль коррекции изображения, 501 схема коррекции сглаживания, 502 схема коррекции диффузионной ошибки, 1101 шина, 1102 ЦПУ, 1103 ПЗУ, 1104 ОЗУ, 1105 жесткий диск, 1106 модуль вывода, 1107 модуль ввода, 1108 модуль передачи данных, 1109 привод, 1110 интерфейс ввода/вывода, 1111 съемный носитель записи.

Подробное описание изобретения

Варианты воплощения настоящего изобретения будут описаны ниже со ссылкой на чертежи.

На фиг.1 иллюстрируется пример структуры первого варианта воплощения устройства обработки изображения, в котором применяют настоящее изобретение.

Входной сигнал Vin изображения передают в модуль 100 детектирования движения, и в модуль 200 формирования подполя.

На фиг.2 иллюстрируется структура модуля 100 детектирования движения по фиг.1. Модуль 100 детектирования движения детектирует, из входного сигнала Vin изображения, вектор движения каждого пикселя, как линию взгляда человека, на основе от пикселя к пикселю, в момент времени, когда человек просматривает входной сигнал Vin изображения.

Входной сигнал Vin изображения передают в схему 101 расчета корреляции и в схему 102 задержки. Схема 101 расчета корреляции выполняет расчет корреляции между входным сигналом Vin изображения текущего поля и входным сигналом изображения предыдущего поля, который был получен путем задержки текущего поля на одно поле, используя схему 102 задержки.

Операция расчета корреляции иллюстрируется на фиг.3.

Схема 101 расчета корреляции устанавливает для пикселя, представляющего интерес в текущем поле, блок BL, имеющий пиксель, представляющий интерес, расположенный в центре. Блок BL представляет собой, например, блок размером 5×5 пикселей. Схема 101 расчета корреляции устанавливает в предыдущем поле, полученном путем задержки текущего поля, используя схему 102 задержки, диапазон поиска, имеющий то же положение, что и блок BL в текущем поле, расположенный в центре. Диапазон поиска составляет, например, область, имеющую от -8 до +7 пикселей в горизонтальном и вертикальном направлениях, относительно того же положения, что и положение блока BL в текущем поле. Схема 101 расчета корреляции выполняет, в качестве расчета корреляции, расчет получения значения оценки для оценки корреляции между блоком BL и каждым блоком-кандидатом, который имеет такой же размер, как и блок BL, и в пределах диапазона поиска, общую сумму, например, абсолютных значений различий между значениями пикселей текущего блока BL и каждым блоком-кандидатом, и передает результат расчета, полученный каждым блоком-кандидатом, в схему 103 определения линии взгляда.

Рассмотрим снова фиг.2, схема 103 определения линии взгляда детектирует положение блока-кандидата, при использовании которого был получен результат расчета, имеющий минимальное значение, среди результатов расчета, переданных из схемы 101 расчета корреляции, в качестве вектора движения пикселя, представляющего интерес. Здесь положение блока-кандидата такого, как показан на фиг.4, представляет собой относительное положение от блока BL. Схема 103 определения линии взгляда определяет направление вектора движения для пикселя, представляющего интерес, как направление линии взгляда в то время, когда человек рассматривает пиксель, представляющий интерес, то есть направление, в котором линия взгляда человека, который рассматривает текущее поле, следует цели (направлению линии взгляда) mv.

Схема 101 расчета корреляции устанавливает блок BL для каждого пикселя, представляющего интерес. В качестве альтернативы, схема 101 расчета корреляции может разделять текущее поле на блоки, имеющие размеры 5x5 пикселей, получать направление линии взгляда (вектора движения) для каждого блока, и применять одинаковое направление линии взгляда ко всем пикселям в блоке.

При расчете корреляции каждым блоком-кандидатом в пределах диапазона поиска может быть получено значение оценки путем добавления определенного весового значения к абсолютному значению разности пикселя рядом с пикселем, представляющим интерес. В этом случае, корреляция пикселя, находящегося рядом с пикселем, представляющим интерес, будет сильно взвешенной.

На фиг.5 иллюстрируется примерная структура модуля 200 формирования подполя по фиг.1.

Модуль 200 формирования подполя генерирует структуру излучения света отдельных подполей во время отображения входного сигнала Vin изображения в ППД.

Прежде чем будет описана работа модуля 200 формирования подполя, будет описан способ отображения уровня с множеством градаций в ППД. ППД разделяет одно поле на множество подполей и изменяет только весовое значение яркости света, излучаемого в каждом из подполей, выполняя, таким образом, отображение уровня с множеством градаций.

Примерная структура подполей в ППД показана на фиг.6. На фиг.6 одно поле разделено на восемь подполей SF1, SF2, SF3, SF4, SF5, SF6, SF7 и SF8, и отдельные подполя у SF1-SF8 имеют разные весовые значения яркости (интенсивности света).

Каждое из подполей SF1-SF8 включает в себя период адреса, в течение которого пиксели в нем устанавливают, как излучающие свет или не излучающие свет, и период излучения света, в течение которого пиксели, установленные в период адреса, как излучающие свет, излучают свет.

Когда весовые значения яркости отдельных подполей, SF1-SF8, составляют, например, 1, 2, 4, 8, 16, 32, 64 и 128, 256 уровней градации от 0 до 256 могут быть реализованы в результате комбинирования этих подполей SF1-SF8.

Поскольку фактический ППД выполнен в двумерной плоскости, изображение, отображаемое в ППД, представлено, как показано на фиг.7, в виде трехмерной схемы модели, включающей в себя подполя, имеющие положения X, Y пикселя, в ППД и в направлении Т времени.

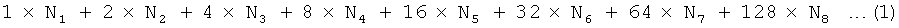

Рассмотрим снова фиг.5, входной сигнал Vin изображения подают в схему 201 назначения подполя. Схема 201 назначения подполя выражает значение пикселя в одном поле входного сигнала Vin изображения, используя следующее уравнение (1). Следует отметить, что Ni представляет собой информацию излучения света, обозначающую отсутствие излучения света или излучения света в подполе SF №i, и имеет значение 0 или 1.

Следует отметить, что, здесь, как и в случае структуры подполя ППД, предназначенной для отображения, которая показана на фиг.6, одно поле состоит из восьми подполей SF1-SF8, и весовые значения яркости отдельных подполей, SF1-SF8, составляют 1, 2, 4, 8, 16, 32, 64 и 128 соответственно. Следующее описание также основано на этой структуре.

Схема 201 назначения подполя передает значение информации Ni излучения света каждого пикселя в схему 202 определения излучения света. Схема 202 определения излучения света генерирует на основе значения Ni, которое обозначает излучение света, когда Ni равно 1, и отсутствие излучение света, когда Ni равно 0, информацию SF управления излучением света, обозначающую структуру излучения света подполей.

Например, когда определенное значение пикселя во входном сигнале Vin изображения равно "7", генерируют информацию SF управления излучением, которая назначает излучение света для подполей SF1, SF2 и SF3 и отсутствие излучение света для других подполей. Кроме того, пример, в котором определенное значение пикселя во входном сигнале Vin изображения равно "22", генерируют информацию SF управления излучением света, которая назначает излучение света для подполей SF2, SF3 и SF5 и отсутствие излучения света для других подполей.

На фиг.8 иллюстрируется структура модуля 300 интегрирования интенсивности света по фиг.1. Модуль 300 интегрирования интенсивности света генерирует изображение, имеющее в качестве значения пикселя интенсивность света, интегрированную на сетчатке глаза человека во время, когда входной сигнал Vin изображения отображают в ППД, в виде, так называемого, смоделированного изображения, видимого глазами человека, когда входной сигнал изображения отображают в ППД.

Прежде чем будет описана работа модуля 300 интегрирования интенсивности света, будет описано, как могло бы выглядеть изображение, в зависимости от направления линии взгляда и структуры излучения света, которые являются уникальными для ППД.

На фиг.9 иллюстрируется граница между значениями 127 и 128 пикселя в подполях, в которых положение X (Y) пикселя отмечено по оси абсцисс, и время Т отмечено по оси ординат. Затененные подполя представляют подполя, которые излучают свет.

Когда изображение не движется, направление линии взгляда человека становится направлением A-A', которое параллельно направлению Т времени по оси ординат, и излучение света в подполях правильно интегрируется на сетчатке глаза человека. Таким образом, пиксели 127 и 128 будут правильно распознаны.

Однако, когда изображение сдвигается на один пиксель влево для каждого поля, глаза человека (линия взгляда) следуют движению. Таким образом, направление линии взгляда становится направлением B-B', которое не параллельно направлению Т времени по оси ординат. В результате этого, излучение света в подполях не будет интегрировано на сетчатке глаз человека и оставит черную линию между значениями 127 и 128 пикселя. В отличие от этого, когда изображение сдвигается на один пиксель вправо для каждого поля, глаза человека (линия взгляд) следуют движению. Таким образом, направление линии взгляда становится направлением C-C, которое не параллельно направлению Т времени по оси ординат. В результате этого, происходит чрезмерное интегрирование излучения света в подполях на сетчатке глаз человека и оставляет белую линию между значениями 127 и 128 пикселя.

Как описано выше, поскольку в ППД используется схема управления, в которой используются подполя, явление, в котором отображаемое изображение и изображение, видимое глазами человека, отличаются в зависимости от направления линии взгляда и структуры излучения света, обычно известно как ложный контур движущегося изображения.

Рассмотрим снова фиг.8, направление mv линии взгляда в каждом пикселе, который детектируют с помощью модуля 100 детектирования движения, и информацию SF управления излучением света, генерируемую модулем 200 формирования подполя, передают в схему 301 определения области интегрирования интенсивности света.

Схема 301 определения области интегрирования интенсивности света определяет для каждого пикселя области интегрирования интенсивности света для воспроизведения на основе моделирования интенсивности света, интегрируемой на сетчатке глаза человека во время отображения входного сигнала Vin изображения в ППД, от направления mv линии взгляда, детектируемого модулем 100 детектирования движения, и информации SF управления излучения света, которую генерируют модулем 200 формирования подполя, и которая обозначает структуру излучения света в подполях. Таким образом, как показано на фиг.10, для пикселя, представляющего интерес, устанавливают область интегрирования интенсивности света, имеющую площадь поперечного сечения, эквивалентную одному пикселю в детектируемом направлении линии взгляда.

Кроме того, схема 301 определения области интегрирования интенсивности света интегрирует интенсивность света в каждом подполе SF №i в соответствии с отношением областей, излучающих свет, к областям, не излучающим свет, в каждом подполе, в пределах области интегрирования интенсивности света. Например, в случае по фиг.10, когда отношение областей, излучающих свет, к областям, не излучающим свет, в подполе SF8 составляет 7:1, интенсивность света, интегрированная в подполе SF8, составляет 128×1/(7+1)=16. Схема 301 определения области интегрирования интенсивности света, аналогично, рассчитывает значения интенсивности света, интегрированные во всех подполях SF1-SF8, и передает значения интенсивности света в схему 302 интегрирования интенсивности света.

Схема 302 интегрирования интенсивности света получает общую сумму интенсивностей света в сформированных подполях SF1-SF8 из схемы 301 определения области интегрирования интенсивности света, и рассматривает общую сумму как значение пикселя для пикселя, представляющего интерес. Схема 302 интегрирования интенсивности света выполняет аналогичную обработку для всех пикселей, генерируя, таким образом, выходное изображение Vout.

Кроме того, обработка, выполняемая схемой 301 определения области интегрирования интенсивности света и схемой 302 интегрирования интенсивности света может быть упрощена следующим образом.

Таким образом, на фиг.10, среди отношений областей, излучающих свет, к областям, не излучающим свет в каждом подполе, выбирают большее количество. В этом случае, подполе SF8 не излучает свет, и интенсивность света равна нулю. Подполе SF7 излучает свет, и интенсивность света равна 64. Общая сумма результатов во всех подполях, которые были получены аналогично, становится значением пикселя для пикселя, представляющего интерес.

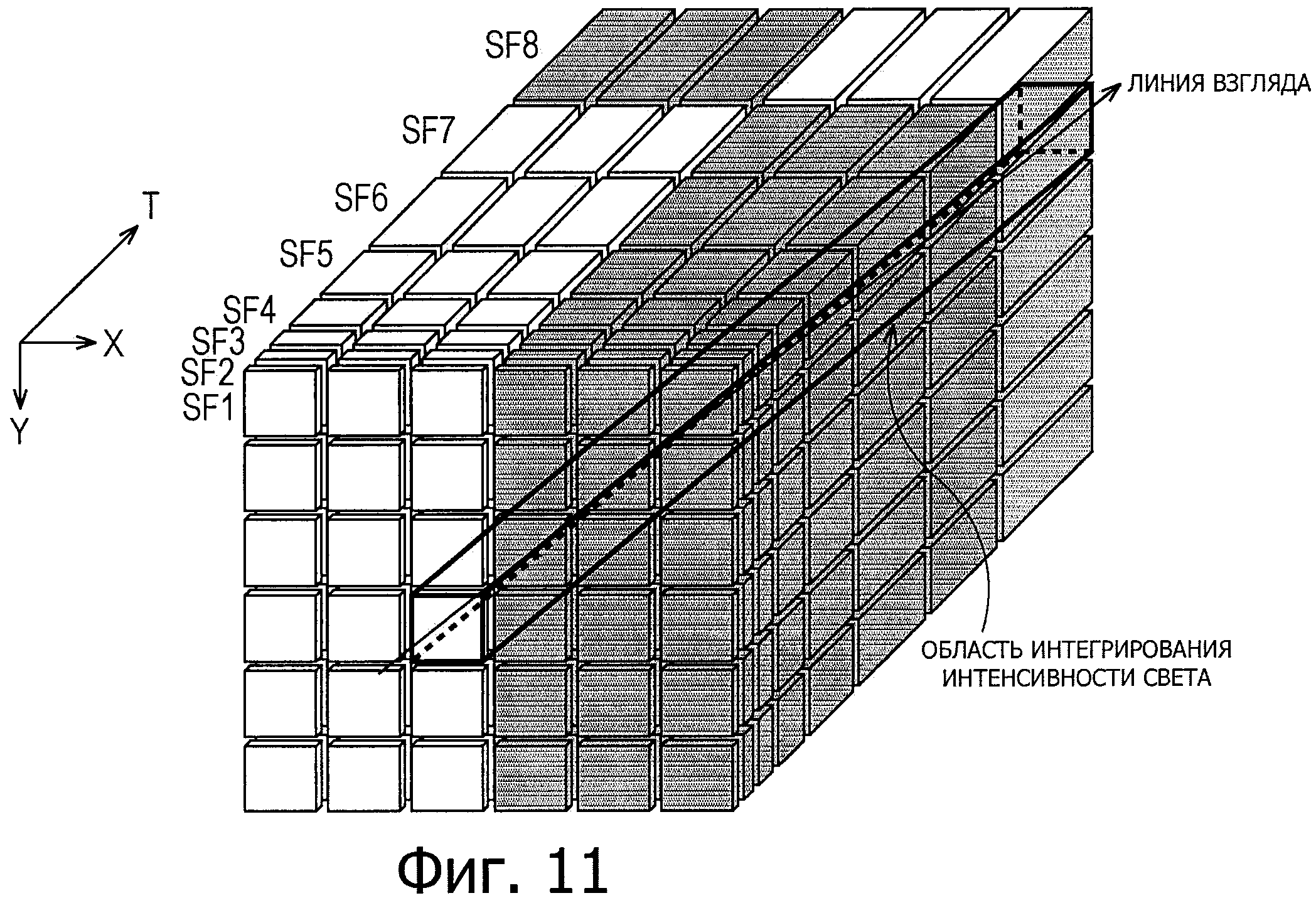

Поскольку фактический ППД выполнен в двумерной плоскости, изображение, отображаемое в ППД, представлено, как показано на фиг.11, в виде схемы трехмерной модели, включающей в себя подполя, имеющие положения X, Y пикселя в ППД, и находящиеся в направлении Т времени.

Как отмечено выше, устройство обработки изображения, представленное на фиг.1, генерирует из входного сигнала Vin изображения на основе направления линии взгляда для каждого пикселя и структуры излучения света подполей во время отображения в ППД изображение, имеющее в качестве значений пикселя интенсивность света, интегрированную на сетчатке глаза человека, который видит изображение, отображаемое в ППД, как изображение, видимое глазами человека, который рассматривает изображение, отображаемое в ППД. Поэтому изображение, которое представлено входным сигналом Vin изображения, отображаемое в ППД, и которое видит человек, может быть воспроизведено на основе модели.

На фиг.12 иллюстрируется примерная структура второго варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

Обычно, для подавления ложного контура движущегося изображения в ППД, ограничивают используемые уровни градации. Кроме того, для реализации видимых уровней градации, выполняют обработку рассеяния ошибки, состоящую в назначении различия в значении пикселя между входным изображением и изображением, предназначенным для отображения, для периферийных пикселей в области времени и пространства, обработку сглаживания, состоящую в представлении видимых уровней градации, используя структуру время-пространство множества значений пикселя, и т.п. Устройство обработки изображения, показанное на фиг.12, воспроизводит аналогичным образом изображение, видимое глазами человека, в случае, когда описанную выше обработку рассеивания ошибки и обработку сглаживания выполняют в ППД, который отображает входной сигнал Vin изображения.

На фиг.12, входной сигнал Vin изображения передают в модуль 100 детектирования движения и модуль 400 преобразования уровня градации. Поскольку структура модуля 100 детектирования движения аналогична представленной на фиг.1, ее описание здесь не приведено.

На фиг.13 иллюстрируется примерная структура модуля 400 преобразования уровня градации по фиг.12.

Входной сигнал Vin изображения суммируют в модуле 405 расчета с ошибкой Vpd отображения уровня градации, описанной ниже, для получения значения Vp пикселя (уровня градации), которое передают в схему 402 преобразования уровня градации.

Схема 402 преобразования уровня градации преобразует уровень Vp градации (значение пикселя) для входного пикселя в другой уровень Vpo градации в соответствии с таблицей 403 преобразования уровня градации. Таким образом, когда значения 0, 1, 3, 7, 15, 31, 63, 127 и 255 требуется использовать как уровни градации, при которых ложный контур движущегося изображения генерируется менее вероятно, указанные выше уровни градации, предназначенные для использования, и видимые уровни градации (уровни градации сглаживания), которые представляют с использованием распределения время-пространство в предыдущих уровнях градации, предназначенных для использования, установлены в таблице 403 преобразования уровня градации.

Схема 402 преобразования уровня градации выполнена с возможностью использования только уровней градации, которые установлены в таблице 403 преобразования уровня градации. Схема 402 преобразования уровня градации заменяет входной уровень Vp градации на уровень градации Vpo из уровней градации в таблице 403 преобразования уровня градации, имеющий наименьшее различие с уровнем Vp градации, и выводит этот уровень Vpo градации. Уровень Vpo градации, который выводят в схеме 402 преобразования уровня градации, подают в схему 404 преобразования сглаживания. Кроме того, модуль 406 расчета получает различие между уровнем Vpo градации и уровнем Vp градации, которое представляет собой вход для схемы 402 преобразования уровня градации, для получения ошибки Vpd уровня градации отображения. Схема 401 задержки задерживает ошибку Vpd уровня градации отображения на один пиксель в горизонтальном направлении, и модуль 405 расчета добавляет эту задержанную ошибку Vpd уровня градации отображения к значению пикселя следующего входного сигнала Vin изображения. Как описано выше, представление различий уровней градации, преобразованных описанным выше образом с использованием уровней градации периферийных пикселей, называется обработкой рассеяния ошибки.

Схема 404 преобразования сглаживания выполняет обработку сглаживания (преобразование сглаживания), которая представляет видимые уровни градации, с использованием распределения время-пространство предназначенных для использования уровней градации. Пример работы схемы 404 преобразования сглаживания представлен на фиг.14. Например, когда существует область, в которой уровень градации, предназначенный для отображения, равен 4, схема 404 преобразования сглаживания обеспечивает распределение уровня градации, как показано на фиг.14, используя, например, значения 3 и 7, которые представляют собой уровни градации, предназначенные для использования. Таким образом, значения уровней градации усредняют, и глаз человека видит уровни градации с видимым значением 4.

Рассмотрим снова фиг.12, как и выше, на которой модуль 400 преобразования уровня градации преобразует входной сигнал Vin изображения в сигнал Vd изображения, который фактически используют для отображения, и передает сигнал Vd изображения в модуль 200 формирования подполя. Поскольку структуры модуля 200 формирования подполя и модуля 300 интегрирования интенсивности света аналогичны тем, которые представлены на фиг.1, их описание здесь не приведено.

Таким образом, в устройстве обработки изображения по фиг.12, модуль 400 преобразования уровня градации выводит изображение, видимое глазами человека, как моделируемое изображение на основе фактически отображаемых уровней градации. В этом случае, модуль 100 детектирования движения детектирует (определяет) линию взгляда по входному сигналу Vin изображения. Когда видимый уровень градации, получаемый путем преобразования, выполняемого модулем 400 преобразования уровня градации, не существенно отличается от входного сигнала Vin изображения, направление линии взгляда также не значительно отличается. Таким образом, описанная выше структура не будет создавать проблем. Кроме того, модуль 400 преобразования уровня градации может представлять собой любой модуль, если только он преобразует входной сигнал Vin изображения в сигнал Vd изображения, используемый для отображения. Например, можно использовать способ, описанный в Публикации № 2004-138783 находящейся на экспертизе заявки на японский патент или тому подобное.

На фиг.15 иллюстрируется примерная структура третьего варианта воплощения устройства обработки изображения, в котором применяется настоящее изобретение.

В таком устройстве обработки изображения пиксель (сигнала изображения) Vd, который выводят из модуля 400 преобразования уровня градации, подают в модуль 100 детектирования движения. В этом случае модуль 100 детектирования движения выполнен с возможностью детектировать линию взгляда (направление линии взгляда) на основе сигнала изображения, который должен быть фактически представлен. Поэтому линию взгляда детектируют в случае, когда ограниченные уровни градации рассеянной ошибки и сглаживания в том виде, как они есть, визуально заметны. Кроме того, модуль 400 преобразования уровня градации может выводить изображение, видимое глазами человека, как моделируемое изображение на основе фактически отображаемых уровней градации.

Следует отметить, что на фиг.15, поскольку структуры модуля 100 детектирования движения, модуля 200 формирования подполя, модуля 300 интегрирования интенсивности света и модуля 400 преобразования уровня градации, аналогичны представленным на фиг.12, их описание здесь не приведено.

На фиг.16 иллюстрируется пример структуры четвертого варианта воплощения устройства обработки изображения, в котором применяют настоящее изобретение.

Входной сигнал Vin изображения передают в модуль 400 преобразования уровня градации и преобразуют в сигнал Vd изображения, используемый для отображения. Сигнал Vd изображения, используемый для отображения, передают в модуль 500 коррекции изображения.

На фиг.17 иллюстрируется примерная структура модуля 500 коррекции изображения. Модуль 500 коррекции изображения корректирует сигнал Vd изображения, используемый для отображения видимого изображения (сигнал изображения), видимого человеком на основе моделирования. Сигнал Vd изображения, используемый для отображения, передают в схему 501 коррекции сглаживания. Схема 501 коррекции сглаживания корректирует отображаемые уровни градации, как сглаженные до видимых уровней градации, на основе моделирования. Таким образом, как показано на фиг.14, когда используют уровни градации сглаживания, поскольку значения уровней градации усреднены в соответствии с глазами человека, эти уровни градации корректируют, как показано на фиг.18. Изображение Vmb со скорректированным сглаживанием передают в схему 502 коррекции рассеянной ошибки.

Схема 502 коррекции рассеянной ошибки корректирует ошибку, рассеянную среди периферийных пикселей для пикселя, представляющего интерес, до видимого уровня градации на основе модели. Таким образом, схема 502 коррекции рассеянной ошибки рассматривает, что различие (ошибка) с входным сигналом Vin изображения было рассеяно с получением сигнала Vmb изображения со скорректированным сглаживанием, и корректирует рассеянную ошибку. Например, как показано на фиг.19, ошибка пикселя, сигнал Vmb изображения которого равен 90, представляет собой разницу с входным сигналом Vin изображения в правом соседнем пикселе, сигнал Vmb изображения которого равен 110, и величину 110-105=5 добавляют как рассеянную ошибку к сигналу Vmb изображения, в результате чего выводят сигнал Vm изображения со скорректированным изображением. Аналогично, ту же обработку выполняют для всех пикселей.

Как отмечено выше, модуль 500 коррекции изображения корректирует уровни градации, получаемые в результате преобразования, выполняемого модулем 400 преобразования уровня градации, до видимых уровней градации, которые видны для глаз человека, на основе модели, и передает этот скорректированный сигнал изображения в модуль 100 детектирования движения. Поэтому линию взгляда детектируют на основе смоделированного изображения по уровням градации, ограниченным по времени, рассеянным ошибкам и сглаживанию, которые видны для глаза человека. Кроме того, модуль 400 преобразования уровня градации может аналогичным образом получать изображение, видимое глазами человека, на основе фактически отображаемых уровней градации. Следует отметить, что, поскольку структуры модуля 100 детектирования движения, модуля 200 формирования подполя, модуля 300 интегрирования интенсивности света и модуля 400 преобразования уровня градации по фиг.16 аналогичны представленным на фиг.12, их описание здесь не приведено.

Как описано выше, устройства обработки изображения по фиг.1, 12, 15 и 16 могут получать изображение, видимое глазами человека, в виде модели по структуре излучения света подполем и направлению линии взгляда в момент времени, когда изображение отображают в ППД. Поэтому изображение, видимое глазами человека, в момент времени, когда произвольный сигнал изображения отображают в ППД, можно отображать в виде модели в устройстве дисплея, отличающемся от ППД. Таким образом, можно воспроизводить, например, состояние, в котором, используя первое устройство дисплея, такое как ЖКД, ЭЛТ, органическую ЭЛ или проектор, изображение отображают во втором устройстве дисплея, имеющем характеристики, отличающиеся от характеристик первого устройства дисплея, таком как ППД. Эмуляция дисплея второго устройства дисплея может быть выполнена с использованием первого устройства дисплея, имеющего характеристики, отличающиеся от характеристик второго устройства дисплея.

Следует отметить, что, хотя фиг.6 используется, как пример структуры подполей в ППД, количество подполей и весовые значения яркости каждого из подполей могут быть произвольными.

На фиг.20 иллюстрируется блок-схема последовательности операций, описывающая обработку, выполняемую устройством обработки изображения по фиг.1.

На этапе ST100 входной сигнал Vin изображения вводят в устройство обработки изображения. Затем на этапе ST200 модуль 100 детектирования движения последовательно рассматривает поле (или кадр) входного сигнала Vin изображения как поле, представляющее интерес, детектирует вектор движения для каждого пикселя поля, представляющего интерес, и определяет направление вектора движения как направление линии взгляда.

На фиг.21 показана блок-схема последовательности операций, описывающая обработку детектирования движения (вектор) на этапе ST200.

На этапе ST201 входной сигнал Vin изображения поля, представляющего интерес, вводят в модуль 100 детектирования движения. Затем, на этапе ST202 модуль 100 детектирования движения последовательно выбирает пиксели, составляющие поле, представляющее интерес, как пиксели, представляющие интерес, и рассматривает блок, который окружает каждый пиксель, представляющий интерес, и имеет заданный размер, как блок, представляющий интерес. Модуль 100 детектирования движения выполняет расчет корреляции между блоком, представляющим интерес, в поле, представляющем интерес, и каждым из блоков-кандидатов в пределах заданного диапазона поиска в поле перед полем, представляющим интерес.

Затем на этапе ST203 модуль 100 детектирования движения определяет, были ли закончены расчеты со всеми блоками - кандидатами. Когда расчеты закончены, обработка переходит на этап ST204. Если расчеты еще не закончены, обработка возвращается на этап ST202, и обработка продолжается. На этапе ST204, модуль 100 детектирования движения детектирует среди блоков-кандидатов положение блока-кандидата, имеющего наибольшую корреляцию (блок-кандидат, имеющий наименьшую общую сумму абсолютных значений разностей), как вектор движения, и определяет вектор движения, как направление mv линии взгляда в пикселе, представляющем интерес. На этапе ST205 модуль 100 детектирования движения выводит направление mv линии взгляда.

Рассмотрим снова фиг.20, на следующем этапе ST300, модуль 200 формирования подполя генерирует информацию SF управления излучением света, обозначающую структуру излучения света подполя в момент времени, когда поле, представляющее интерес входного сигнала Vin изображения отображают в ППД.

На фиг.22 показана блок-схема последовательности операций, предназначенная для генерирования информации SF управления излучением света, обозначающей структуру излучения света подполем на этапе ST300.

На этапе ST301 поле, представляющее интерес, входного сигнала Vin изображения вводят в модуль 200 формирования подполя. Затем на этапе ST302 модуль 200 формирования подполя представляет поле, представляющее интерес, входного сигнала Vin изображения, используя общую сумму весовых значений яркости отдельных подполей в уравнении (1), и получает информацию Ni излучения света. Затем на этапе ST303 модуль 200 формирования подполя генерирует на основе информации Ni излучения света информацию SF управления излучением света, обозначающую структуру излучения света, представляющую излучение света и отсутствие излучения света в отдельных подполях поля, представляющего интерес. На этапе ST304, модуль 200 формирования подполя выводит информацию SF управления излучением света, обозначающую структуру излучения света подполя.

Рассмотрим снова фиг.20, на следующем этапе ST400, модуль 300 интегрирования интенсивности света генерирует на основе моделирования сигнал Vout изображения, соответствующий интенсивности света, интегрированный на сетчатке глаза человека (изображение, видимое глазами человека), в момент времени, когда поле, представляющее интерес, входного сигнала Vin изображения отображают в ППД.

На фиг.23 показана блок-схема последовательности операций, иллюстрирующая интегрирование интенсивности света на этапе ST400.

На этапе ST401 направление mv линии взгляда в каждом пикселе, в поле, представляющем интерес, которое детектируют на этапе ST200, и информацию SF управления излучением света подполей, в поле, представляющем интерес, которую генерируют на этапе ST300, вводят в модуль 300 интегрирования интенсивности света. Затем на этапе ST402 модуль 300 интегрирования интенсивности света последовательно выбирает отдельные пиксели полей, представляющих интерес, как пиксели, представляющие интерес, и определяет на основе направления mv линии взгляда в каждом пикселе, представляющем интерес, область интегрирования интенсивности света, в которой интегрируют интенсивность света.

На этапе ST403 модуль 300 интегрирования интенсивности света интегрирует интенсивность света, излучаемую подполями, в пределах области интегрирования интенсивности света, определенной на этапе ST402, на основе структуры излучения света, обозначенной информацией SF управления излучением света, получая, таким образом, значение пикселя для пикселя, представляющего интерес. Модуль 300 интегрирования интенсивности света генерирует выходное изображение (сигнал) Vout, составленное по значению пикселя. На этапе ST404 модуль 300 интегрирования интенсивности света выводит выходное изображение Vout.

Рассмотрим снова фиг.20, на следующем этапе ST500, например, ЖКД, используемый как второе устройство дисплея (не показано), отображает генерируемое выходное изображение Vout.

На фиг.24 иллюстрируется блок-схема последовательности операций, описывающая обработку, выполняемую модулем обработки изображения по фиг.12.

На этапе ST110, как и на этапе ST100 по фиг.20, вводят входной сигнал Vin изображения. Затем на этапе ST210 вектор движения детектируют для каждого пикселя, и, кроме того, направление mv линии взгляда детектируют для каждого пикселя. Операция, выполняемая на этапе ST210, аналогична выполняемой на этапе ST200, показанном на фиг.20. Затем на этапе ST310 модуль 400 преобразования уровня градации выполняет преобразование уровня градации, выполняемое во время отображения с использованием ППД.

На фиг.25 показана блок-схема последовательности операций, иллюстрирующая операцию преобразования уровня градации на этапе ST310.

На этапе ST311 входной сигнал Vin изображения вводят в модуль 400 преобразования уровня градации. Затем на этапе ST312 модуль 400 преобразования уровня градации преобразует входной сигнал Vin изображения в сигнал Vp изображения путем добавления ошибок, рассеянных из периферийных изображений. Затем на этапе ST313 модуль 400 преобразования уровня градации преобразует уровень градации сигнала Vp изображения в соответствии с таблицей 403 преобразования уровня градации (фиг.13). После этого, на этапе ST314, модуль 400 преобразования уровня градации рассчитывает ошибку (ошибку отображения уровня градации) Vpd между сигналом Vp изображения перед преобразованием уровня градации и сигналом Vpo изображения после преобразования уровня градации.

Затем на этапе ST315 модуль 400 преобразования уровня градации выполняет преобразование сглаживания сигнала Vpo изображения. На этапе ST316 модуль 400 преобразования уровня градации выводит сигнал изображения, получаемый путем выполнения преобразования сглаживания, как сигнал Vd изображения с преобразованным уровнем градации.

Рассмотрим снова фиг.24, на следующем этапе ST410 выполняют обработку, аналогичную выполняемой на этапе ST300 по фиг.20 для сигнала Vd изображения, полученного путем преобразования на этапе ST310. Кроме того, поскольку этапы ST510 и ST610, следующие дальше, соответственно, аналогичны этапам ST400 и ST500, показанным на фиг.20, их описание здесь не приведено.

На фиг.26 иллюстрируется блок-схема последовательности операций, описывающая обработку, выполняемую модулем обработки изображения по фиг.15.

Следует отметить, что на фиг.26, помимо того факта, что из сигнала Vd изображения, полученного путем преобразования на этапе ST220, детектируют направление линии взгляда (вектор движения), на следующем этапе ST320, выполняют обработку, аналогичную этапам ST110, ST310, ST210, ST410, ST510 и ST610, показанным на фиг.24, соответственно, на этапах ST120, ST220, ST320, ST420, ST520 и ST620.

На фиг.27 иллюстрируется блок-схема последовательности операций, описывающая обработку, выполняемую в устройстве обработки изображения, показанном на фиг.16.

На этапе ST130, как и на этапе ST120 по фиг.26, вводят входной сигнал Vin изображения. Затем на этапе ST230, как и в случае, показанном на фиг.26, генерируют сигнал Vd изображения с преобразованным уровнем градации. Затем на этапе ST330 выполняют коррекцию изображения для сигнала Vd изображения, полученного в результате преобразования на этапе ST320. После этого выполняют обработку, аналогичную этапам ST320, ST420, ST520 и ST620, показанную на фиг.26, соответственно, на этапах ST430, ST530, ST630 и ST730.

На фиг.28 показана блок-схема последовательности операций, иллюстрирующая операцию коррекции изображения на этапе ST330. На этапе ST331 сигнал Vd изображения вводят в модуль 500 коррекции изображения. Затем на этапе ST332, модуль 500 коррекции изображения корректирует сигнал Vd изображения в соответствии с визуальными эффектами сглаживания. Затем на этапе ST333 модуль 500 коррекции изображения выполняет коррекцию влияния ошибок, рассеянных среди периферийных пикселей, на основе моделирования, и генерирует сигнал Vm изображения. На этапе ST334 модуль 500 коррекции изображения выводит сигнал Vm изображения.

Как отмечено выше, устройства обработки изображения по фиг.1, 12, 15 и 16 генерируют изображение, видимое глазами человека, на основе моделирования, из структуры излучения света подполями и направления линии взгляда в момент времени, когда изображение отображают в ППД. Поэтому изображение, видимое глазами человека в момент времени, когда произвольный сигнал изображения отображают в ППД, можно отображать в виде модели в устройстве дисплея, отличающемся от ППД.

Далее будут описаны детали обработки, выполняемой модулем 300 интегрирования интенсивности света по фиг.1. Перед этим снова будет описано отображение изображения в ППД.

Отображение изображения в ППД представлено как трехмерная схема модели, включающая в себя подполя, имеющие положения X, Y пикселя в ППД, и расположенные в направлении Т времени, как показано на фиг.7 и 11.

На фиг.29 иллюстрируется модель, получаемая в результате отображения модели изображения в ППД (ниже называется моделью дисплея, в соответствии с необходимостью).

Здесь, на фиг.29 показана схема, аналогичная представленной на фиг.7 или 11, описанных выше.

В модели дисплея восемь подполей SF1-SF8 расположены в направлении времени Т, которое представляет собой направление, перпендикулярное плоскости xy, используемой как сторона отображения, на которой отображают входной сигнал Vin изображения в ППД.

Следует отметить, что плоскость xy, используемая как сторона отображения, имеет, например, верхнюю левую точку стороны отображения, используемую как начало координат, горизонтальное направление, используемое как направление X, и вертикальное направление, используемое как направление Y.

Модуль 300 интегрирования интенсивности света (фиг.1) последовательно выбирает пиксели входного сигнала Vin изображения, отображаемые в ППД (пиксели изображения, соответствующего входному сигналу изображения, которое отображают в ППД, в соответствии с входным сигналом Vin изображения) как пиксели, представляющие интерес. В модели дисплея область, которая имеет область каждого пикселя, представляющего интерес, представленная как поперечное сечение, и продолжается в направлении mv линии взгляда в пикселе, представляющем интерес (направление вектора движения, детектируемого для пикселя, представляющего интерес), используется как область интегрирования интенсивности света, в которой интегрируют интенсивность света. Интенсивность света в пределах области интегрирования интенсивности света интегрируют в соответствии со структурой излучения света подполя, обозначенной информацией SF управления излучением света, в результате чего выполняют расчет значения пикселя для пикселя, представляющего интерес.

Таким образом, модуль 300 интегрирования интенсивности света рассматривает, как показано на фиг.29, область (пространство) в виде прямоугольной призмы, которая имеет область пикселя на стороне отображения модели дисплея, как поперечное сечение, и которая продолжается в направлении времени Т на длину, соответствующую интенсивности света, излучаемого в подполе SF №I, как область подполя пикселя. Путем умножения пропорции заполнения, которая представляет собой пропорцию, в которой область интегрирования интенсивности света занимает область подполя пикселя, на интенсивность L света для света, излучаемого в соответствии со структурой излучения света подполя SF №i, соответствующей области подполя пикселя (излучает ли пиксель в области подполя в подполе SF №i свет или не излучает свет), получают интенсивность света, оказывающую влияние, соответствующую влиянию области подполя пикселя на значение пикселя для пикселя, представляющего интерес, для всех областей подполя пикселя, через которые проходит область интегрирования интенсивности света.

Модуль 300 интегрирования интенсивности света интегрирует значения интенсивности света, оказывающей влияние, которые получают для всех областей подполя пикселя, через которые проходит область интегрирования интенсивности света, и рассчитывает интегрированное значение как значение пикселя для пикселя, представляющего интерес.

Далее будет подробно описан способ расчета значения пикселя для пикселя, представляющего интерес, используя модель дисплея, который выполняет модуль 300 интегрирования интенсивности света.

На фиг.30 иллюстрируется пример пикселя в модели дисплея.

В модели дисплея пиксель представлен как квадратная область, горизонтальная и вертикальная длина которой равна, например, 1. В этом случае, площадь поверхности области пикселя равна 1(=1×1).

Кроме того, в модели дисплея положение для пикселя (положение пикселя) представлено, с использованием координат верхнего левого угла пикселя. В этом случае, например, в случае пикселя (квадратная область, используемая как пиксель), положение (X, Y) пикселя которого представляет собой (300, 200), как показано на фиг.30, координаты левой верхней точки равны (300, 200), и координаты верхней правой точки равны (301, 200). Кроме того, координаты нижней левой точки равны (300, 201), и координаты нижней правой точки равны (301, 201).

Следует отметить, что ниже, например, верхняя левая точка пикселя в модели дисплея называется опорной точкой в соответствии с необходимостью.

На фиг.31 иллюстрируется область интегрирования интенсивности света в модели дисплея.

Например, теперь предполагается, что пиксель в положении (x, y) пикселя используется как пиксель, представляющий интерес. В момент времени Т=α пиксель, представляющий интерес (субъект фотографирования, отраженный на него) движется с величиной движения, выраженной как вектор движения (vx, vy) в течение времени Tf, и в момент времени Т=β(=α+Tf) перемещается в положение (x+vx, y+vy).

В этом случае траектория квадратной области, которая используется как область пикселя, представляющего интерес, и движется из положения (x, y) в положение (x+vx, y+vy) становится областью (пространством) интегрирования интенсивности света.

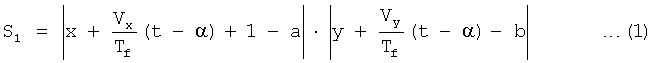

Теперь, когда предполагается, что поперечное сечение области интегрирования интенсивности света, то есть области пикселя, представляющего интерес, движущейся из положения (x, y) в положение (x+vx, y+vy), представляет собой область (плоскость) поперечного сечения, эта область поперечного сечения представляет собой область, имеющую такую же форму, что и область пикселя. Таким образом, область поперечного сечения имеет четыре вершины.

Предполагается, что среди четырех вершин области поперечного сечения в произвольный момент времени T=t(α≤t≤β) от момента времени α до момента времени β, верхняя левая, верхняя правая, нижняя левая и нижняя правая точки (вершины) обозначены как A, B, C и D соответственно. Поскольку верхняя левая точка F=A движется из положения (x, y) в положение (x+vx, y+vy) в течение времени Tf, координаты (X, Y) в точке A в момент времени t становятся (x+vx(t-α)/Tf, y+vy(t-α)/Tf).

Кроме того, поскольку верхняя правая точка B представляет собой точку на расстоянии +1 от точки A в направлении X, координаты (X, Y) точки B в момент времени t становятся (x+vx(t-α)/Tf, y+vy(t-α)/Tf+1). Аналогично, поскольку нижняя левая точка C представляет собой точку на расстоянии +1 от точки A в направлении Y, координаты (X, Y) точки C в момент времени t становятся (x+vx(t-α)/Tf, y+vy(t-α)/Tf+1). Поскольку нижняя правая точка D представляет собой точку на расстоянии +1 от точки A в направлении X, и на расстоянии +1 от точки в направлении Y координаты (X, Y) точки D в момент времени t становятся (x+vx(t-α)/Tf+1, y+vy(t-α)/Tf+1).

На фиг.32 иллюстрируется область поперечного сечения в момент времени T=t.

Поскольку область поперечного сечения, имеющая вершины, обозначенные как точки А-D, не преобразуется, эта область поперечного сечения включает в себя одну или больше опорных точек (когда их проецируют на плоскость xy) в произвольное время T=t. На фиг.32 область поперечного сечения включает в себя одну опорную точку (a, b).

Здесь область поперечного сечения может включать в себя множество опорных точек. Этот случай будет описан ниже.

Кроме того, область поперечного сечения движется по мере того, как протекает время Т. В соответствии с этим положение опорной точки в области поперечного сечения изменяется. Это можно относительно рассматривать со ссылкой на область поперечного сечения так, что опорная точка движется по мере течения времени Т. Поскольку опорная точка движется по мере течения времени Т, опорная точка в пределах области поперечного сечения может изменяться (на другую опорную точку). Этот случай будет описан ниже.

В области поперечного сечения прямая линия Lx, которая проходит через опорную точку (a, b) и расположена параллельно оси X, и прямая линия Ly, которая проходит через опорную точку (a, b) и расположена параллельно оси Y, становятся границей пикселей, составляющих модель дисплея. Таким образом, интегрирование интенсивности света необходимо выполнять в каждой области, полученной путем разделения области поперечного сечения, используя прямые линии Lx и Ly (ниже называются областями деления).

На фиг.32 опорная точка (a, b) находится внутри области поперечного сечения (другой участок, кроме границы), и, соответственно, область поперечного сечения разделена на четыре области S1, S2, S3 и S4 деления. Следует отметить, что на фиг.32, область, расположенная выше и справа от опорной точки (a, b), представляет собой область S1 деления; область, находящаяся выше и слева от опорной точки (a, b), представляет собой область S2 деления; область, находящаяся ниже и слева от опорной точки (a, b), представляет собой область S3 деления; и область, расположенная ниже и справа от опорной точки (a, b), представляет собой область S4 деления.

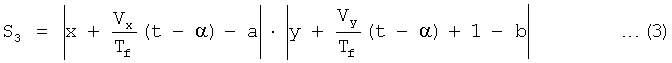

Площадь (Si) области Si(i=1, 2, 3, 4) деления в момент времени T=t выражена, с использованием следующих уравнений (1)-(4).

Уравнение 1

Уравнение 2

Уравнение 3

Уравнение 4

Теперь предположим, что среди восьми подполей SF1-SF8 в модели дисплея (фиг.29) одно подполе SF №j используется, как подполе SF №j, представляющее интерес, и область поперечного сечения проходит через подполе SF №j, представляющее интерес, с момента времени T=sfa до момента времени T=sfb.

Область интегрирования интенсивности света, используемая как траектория области поперечного сечения, проходящей через подполе SF №j, представляющее интерес, эквивалентна комбинации траекторий отдельных областей S1-S4 деления в момент времени, когда область поперечного сечения проходит через него.

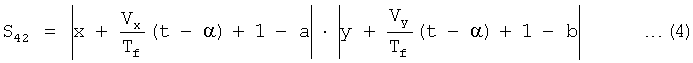

Теперь предположим, что в области интегрирования интенсивности света участок, включающий в себя область, используемую как траектория области Si, деления (сплошное тело, имеющее Si область деления как поперечное сечение), представляет собой сплошное тело Vi деления. Объем (Vi) сплошного тела Vi деления может быть получен путем интегрирования области Si деления от момента времени tsfa до момента времени tsfb в соответствии со следующими уравнениями (5)-(8).

Уравнение 5

Уравнение 6

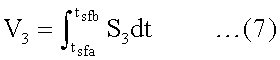

Уравнение 7

Уравнение 8

Следует отметить, что здесь предполагается, что, когда область поперечного сечения проходит через подполе, представляющее интерес SF №j, опорная точка (a, b) не меняется (когда область поперечного сечения начинает проходить через подполе, представляющее интерес SF №j, опорная точка (a, b), присутствующая в области поперечного сечения, продолжает присутствовать в области поперечного сечения, до тех пор, пока область поперечного сечения не пройдет через подполе, представляющее интерес SF №j).

В отличие от этого, в модели дисплея, когда предполагается, что в подполе SF №j, представляющем интерес, объем каждой области подполя пикселя (фиг.29), которая представляет собой сплошное тело, имеющее форму прямоугольной призмы, которая имеет область пикселя как поперечное сечение и продолжается в направлении времени Т, равняется V, объем V области поля пикселя и объем (Vi) сплошных тел V1, V2, V3 и V4 деления взаимосвязаны в соответствии с уравнением (9).

Уравнение 9

Сплошное тело Vi деления, которое представляет собой часть области интегрирования интенсивности света, занимает участок области поля центрального пикселя в подполе SF №j, представляющем интерес. Когда пропорция сплошного тела Vi деления, занимающая область поля пикселя, используется как пропорция заполнения, пропорцию заполнения выражают как Vi/V, и она может быть получена с использованием уравнения (5) - уравнения (9).

Теперь, если предположить, что область поля пикселя, участок которой занят сплошным телом Vi деления, в подполе SF №j, представляющем интерес, представляет собой занятую область поля, интенсивность света, соответствующая влиянию области поля занятого пикселя (его интенсивность света) на значение пикселя для пикселя, представляющего интерес (ниже называется интенсивностью света, оказывающей влияние, в соответствии с необходимостью), может быть получена путем умножения пропорции заполнения Vi/V на интенсивность света SFVi в области поля занятого пикселя.

Здесь интенсивность SFVi света в области поля занятого пикселя представляет собой весовое значение L яркости подполя SF №j, представляющего интерес, когда область поля занятого пикселя в подполе SF №j, представляющем интерес, излучает свет. Когда область поля занятого пикселя в подполе SF №j, представляющем интерес, не излучает свет (отсутствие излучения света), интенсивность SFVi света равна 0. Следует отметить, что излучение света/отсутствие излучения света занятой области поля пикселя в подполе, представляющем интерес SF №j, можно распознавать по структуре излучения света, обозначенной с помощью информации SF управления излучением света, передаваемой из модуля 200 формирования подполя (фиг.1) в модуль 300 интегрирования интенсивности света.

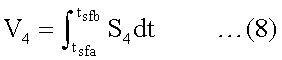

Интенсивность PSFL,j света, соответствующая степени влияния подполя SF №j, представляющего интерес (его интенсивность света), на значение пикселя для пикселя, представляющего интерес (интенсивность света в подполе SF №j, представляющем интерес), представляет собой общую сумму интенсивностей SFV1xV1/V, SFV2xV2/V, SFV3xV3/V и SFV4xV4/V света, оказывающего влияние, в области поля занятого пикселя, участки которых заняты сплошными телами V1, V2, V3 и V4 деления. Таким образом, интенсивность PSFL,j света может быть получена из уравнения (10).

Уравнение 10

Модуль 300 интегрирования интенсивности света (фиг.1) получает PSFL,1-PSFL,8 в восьми подполях SF1-SF8 для пикселя, представляющего интерес, в соответствии с уравнением (10). Модуль 300 интегрирования интенсивности света интегрирует PSFL,1 в PSFL,8 в восьми подполях SF1-SF8 и рассматривает интегрированное значение PSFL,1+PSFL,2+…+PSFL,8, как значение пикселя для пикселя, представляющего интерес. Следует отметить, что получение интегрированного значения PSFL,1+PSFL,2+…+PSFL,8 эквивалентно получению интенсивности света, оказывающего влияние, во всех областях подполей пикселей, через которые проходит область интегрирования интенсивности света, и интегрированию этих значений интенсивности света, оказывающих влияние.

Теперь, что касается области поперечного сечения, которая перемещается по мере того, как протекает время Т, как было описано выше, множество опорных точек могут присутствовать в области поперечного сечения, или опорная точка в области поперечного сечения может изменяться (на другую опорную точку). Эти случаи будут описаны со ссылкой на фиг.33 и 34.

На фиг.33 и 34 иллюстрируется область поперечного сечения, которая движется в пределах модели дисплея, по мере того, как протекает время Т, с пикселем в положении (х, у) в модели дисплея, используемым как пиксель, представляющий интерес.

Следует отметить, что на фиг.34 показана схема, продолжающаяся с фиг.34.

На фиг.33 и 34, с пикселем в положении (x, y) пикселя, используемым как пиксель, представляющий интерес, такой пиксель, представляющий интерес (субъект фотографирования, отраженный на него), движется с момента времени T=tsfa до момента времени T=Tsfb, перемещаясь на величину движения, выраженную как вектор движения (+2, -1), в положение (x+2, y-1).

Как отмечено выше, в области поперечного сечения, которая представляет собой область пикселя, представляющего интерес, который перемещается из положения (x, y) в положение (x+2, y-1), когда положение области поперечного сечения идеально соответствует положению области пикселя в модели дисплея (когда его рассматривают в плоскости xy), четыре вершины области пикселя присутствуют как опорные точки в области поперечного сечения.

Таким образом, например, в области поперечного сечения в положении (x, y), в котором начинается движение (область поперечного сечения, в которой положение верхней левой вершины представляет собой положение (x, y)), присутствуют четыре опорные точки, а именно, точки (x, y), точка (x+1, y), точка (x, y+1) и точка (x+1, y+1).

Как отмечено выше, когда существует множество опорных точек в области поперечного сечения, например, одну опорную точку в направлении mv линии взгляда в пикселе, представляющем интерес (направление вектора движения, детектированного для пикселя, представляющего интерес), выбирают как опорную точку, используемую для получения значения пикселя для пикселя, представляющего интерес (ниже называется опорной точкой, представляющей интерес, в соответствии с необходимостью).

Таким образом, например, когда компонент X вектора движения, представляющего направление mv линии взгляда в пикселе, представляющем интерес, больше, чем нуль (положительный знак), и его компонент Y меньше, чем или равен нулю (компонент Y равен нулю, или его знак отрицательный), из четырех вершин (x, y), (x+1, y), (x, y+1) и (x+1, y+1), верхнюю правую опорную точку (x+1, y) выбирают как опорную точку, представляющую интерес.

В качестве альтернативы, например, когда компонент X вектора движения, представляющего направление mv линии взгляда в пикселе, представляющем интерес, меньше или равен нулю, и его компонент Y меньше или равен нулю, из четырех вершин (x, y), (x+1, y), (x, y+1) и (x+1, y+1), верхнюю левую опорную точку (x, y) выбирают как опорную точку, представляющую интерес.

Кроме того, например, когда компонент X вектора движения, представляющего направление mv линии взгляда в пикселе, представляющем интерес, меньше или равен нулю, и его компонент Y больше, чем ноль, из четырех вершин (x, y), (x+1, y), (x, y+1) и (x+1, y+1) выбирают нижнюю левую опорную точку (x, y+1) как опорную точку, представляющую интерес.

В качестве альтернативы, например, когда оба из компонента X и компонента Y вектора движения, представляющего направление mv линии взгляда в пикселе, представляющем интерес, больше нуля, из четырех вершин (x, y), (x+1, y), (x, y+1) и (x+1, y+1), выбирают нижнюю правую опорную точку (x+1, y+1) как опорную точку, представляющую интерес.

На фиг.33, поскольку вектор движения, представляющий направление mv линии взгляда в пикселе, представляющем интерес, представляет собой вектор (+2, -1), верхнюю правую опорную точку (x+1, y) выбирают как опорную точку, представляющую интерес.

Как отмечено выше, после того, как будет выбрана опорная точка (x+1, y), представляющая интерес, область поперечного сечения может быть разделена на основе опорной точки (x+1, y), представляющей интерес, на четыре области S1, S2, S3 и S4 деления, как представлено на фиг.32. Поэтому значение пикселя для пикселя, представляющего интерес, может быть получено в соответствии с уравнением (1)-уравнением (10), если только область поперечного сечения не движется в направлении mv линии взгляда, и новая опорная точка не содержится в области поперечного сечения.

В отличие от этого, когда область поперечного сечения движется в направлении mv линии взгляда, и новая опорная точка включена в область поперечного сечения для новой опорной точки, новую опорную точку, представляющую интерес, повторно выбирают аналогично представленному выше, и в соответствии с этим, опорная точка, представляющая интерес, изменяется.

Таким образом, например, на фиг.33, в момент времени Т=γ, координата X положения x+1 области поперечного сечения соответствует координате X положения x+1 пикселя в модели дисплея, и, в соответствии с этим, новая опорная точка (x+2, y) содержится в области поперечного сечения.

В этом случае, для новой опорной точки (x+2, y), повторно выбирают новую опорную точку, представляющую интерес. В данном случае, поскольку опорная точка (x+2, y) представляет собой единственную новую опорную точку, эту опорную точку (x+2, y) выбирают как новую опорную точку, представляющую интерес, и, соответственно, опорная точка, представляющая интерес, меняется с опорной точки (x+1, y) на опорную точку (x+2, y).

Следует отметить, что, когда координата Y положения области поперечного сечения соответствует координате Y положения пикселя в модели дисплея, и в соответствии с этим, новая опорная точка включена в область поперечного сечения, как было описано выше, опорная точка, представляющая интерес, меняется.

На фиг.34 иллюстрируется область поперечного сечения после изменения опорной точки, представляющей интерес, то есть после того, как будет выбрана новая опорная точка, представляющая интерес (x+2, y).

После того, как будет выбрана новая опорная точка, представляющая интерес, область поперечного сечения может быть разделена на основе новой опорной точки, представляющей интерес, на четыре области деления, как и в случае, описанном со ссылкой на фиг.32. На фиг.34 область поперечного сечения разделена на четыре области

После выбора новой опорной точки, представляющей интерес, когда область поперечного сечения движется в направлении mv линии взгляда, и новая опорная точка включена в область поперечного сечения, для новой опорной точки, новую опорную точку, представляющую интерес, повторно выбирают аналогично описанному выше, и в соответствии с этим, опорная точка, представляющая интерес, изменяется.

На фиг.34, в момент времени T=tsfb, координата X положения x+2 области поперечного сечения, соответствует координате X положения x+2 в (x+2, y-1) пикселя в модели дисплея, и, кроме того, координата у положения y-1 в области поперечного сечения, соответствует координате Y положения y-1 в (x+2, y-1) для пикселя модели дисплея. В соответствии с этим три новые опорные точки (x+2, y-1), (x+3, y-1) и (x+3, y) включены в область поперечного сечения.

Когда область поперечного сечения движется после этого среди трех новых опорных точек (x+2, y-1), (x+3, y-1) и (x+3, y), повторно выбирают новую опорную точку, представляющую интерес, как описано выше.

Как описано выше, путем повторного выбора (изменения) опорной точки, представляющей интерес, может быть получена пропорция заполнения, при которой область интегрирования интенсивности света занимает область поля занятого пикселя (фиг.29), то есть отношение Vε/V объема (Vε) участка Vε области поля занятого пикселя, которая занята областью интегрирования интенсивности света (поскольку этот участок соответствует описанному выше сплошному телу деления, этот участок называется участком сплошного тела деления в соответствии с необходимостью), к объему (V) области V занятого пикселя.

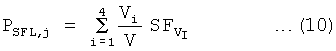

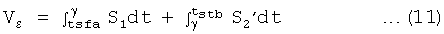

Таким образом, например, как показано на фиг.33 и 34, когда область поперечного сечения движется из положения (x, y) в положение (x+2, y-1) с момента времени T=tsfa до момента времени Т=tsfb и проходит через подполе SF №j, представляющее интерес, если опорная точка, представляющая интерес, изменяется только один раз в момент времени T=γ, может быть получен объем (Vε) участка Vε сплошного тела деления, который занят областью интегрирования интенсивности света области поля занятого пикселя, имеющего, например, область пикселя в положении (x+1, y-1) в подполе SF №j, представляющем интерес, как поперечное сечение, используя уравнение (11).

Уравнение 11

Здесь, в уравнении (11) S1 обозначает площадь области деления в области пикселя, в положении (x+1, y-1), которая представляет собой поперечное сечение области поля занятого пикселя, с момента времени T=tsfa, при котором опорная точка (x+1, y) представляет собой опорную точку, представляющую интерес, до момента времени Т=γ, как представлено на фиг.33. Кроме того,

Как обозначено в уравнении (11), объем (Vε) участка Vε сплошного тела деления, который занят областью интегрирования интенсивности света области поля занятого пикселя, имеющего область пикселя в определенном положении (X, Y) в подполе SF №j, представляющем интерес, как поперечное сечение, может быть получен путем интегрирования площади (областей S1 и S2' в уравнении (11)) области деления в области пикселя, которая представляет собой поперечное сечение области поля занятого пикселя, так, что при этом сечение интегрирования разделяется в точке, в которой изменяется опорная точка, представляющая интерес (в Уравнении (11), в сечении от момента времени Т=tsfa до момента времени Т=γ и в сечении от момента времени Т=γ до момента времени Т=tsfb).

Пропорция заполнения Vε/V, при которой область интегрирования интенсивности света занимает область поля занятого пикселя может быть получена путем деления объема (Vε) участка Vε сплошного тела деления, который занят областью интегрирования интенсивности света, области поля занятого пикселя, на объем (V) области V поля занятого пикселя.

После того, как будет получена пропорция заполнения Vε/V, со ссылкой на фиг.31 и фиг.32, пропорцию заполнения Vi/V умножают на интенсивность света в области поля занятого пикселя, получая, таким образом, интенсивность света (интенсивность света, оказывающего влияние), соответствующую степени оказываемого влияния области поля занятого пикселя (интенсивности света в ней) на значение пикселя для пикселя, представляющего интерес. Значение интенсивности света, оказывающего влияние, во всех областях подполей пикселя, через которые проходит область интегрирования интенсивности света, получают, и значение интенсивности света, оказывающей влияние, интегрируют, получая, таким образом, значение пикселя для пикселя, представляющего интерес.

Затем, как показано в уравнении (11), для того, чтобы получить объем (Vε) участка Vε сплошного тела деления, который занят областью интегрирования интенсивности света, в области поля занятого пикселя, необходимо время, в которое изменяется опорная точка, представляющая интерес (время γ в уравнении (11)) (ниже называется временем изменения, в соответствии с необходимостью).

Изменение опорной точки, представляющей интерес, происходит, когда координата X положения области поперечного сечения соответствуют координате X положения пикселя в модели дисплея или когда координата Y в положении области поперечного сечения соответствует координате Y положения y-1 пикселя в модели дисплея. Поэтому время изменения может быть получено следующим образом.

Таким образом, например, теперь, как представлено выше со ссылкой на фиг.31, предполагается, что пиксель в положении (x, y) пикселя используется как пиксель, представляющий интерес. В момент времени Т=α область поперечного сечения в положении (x, y) движется на величину движения, выраженную как вектор (vx, vy) движения в течение времени Tf, и в момент времени Т=β(=α+Tf), перемещается в положение (x+vx, y+vy).

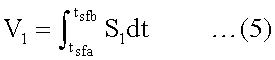

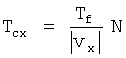

В этом случае, время Тсх изменения, в которое координата X положения области поперечного сечения соответствует координате X положения пикселя в модели дисплея, выражается уравнением (12).

Уравнение 12

Здесь предполагается, что компонент X значения vx вектора движения принимает целочисленное значение.

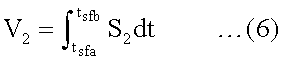

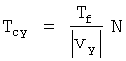

Кроме того, время Тсу изменения, в которое координата Y положения области поперечного сечения соответствует координате Y положения пикселя в модели дисплея, выражено с помощью уравнения (13).

Уравнение 13

Здесь предполагается, что компонент Y значения vy вектора движения принимает целочисленное значение.

Следует отметить, что, когда компонент X значения vx вектора движения имеет другое значение, кроме нуля, каждый раз, когда время Т становится временем Тсхизменения, которое получают в соответствии с уравнением (12), точка, полученная путем добавления +1 или -1 к координате X опорной точки, которая была непосредственно предшествующей опорной точке, представляющей интерес, становится новой опорной точкой, представляющей интерес (измененной опорной точкой). Таким образом, когда компонент X значения vx вектора движения положительный, точка, получаемая путем добавления +1 к координате X опорной точки, которая была непосредственно предшествующей опорной точкой, представляющей интерес, становится новой опорной точкой, представляющей интерес. Когда компонент X значения vx вектора движения отрицательный, точка, полученная путем добавления -1 к координате X опорной точки, которая была непосредственно предшествующей опорной точкой, представляющей интерес, становится новой опорной точкой, представляющей интерес.

Аналогично, когда компонент Y значения vy вектора движения представляет собой другое значение, кроме нуля, каждый раз, когда время Т становится временем Тсуизменения, которое получают в соответствии с уравнением (13), точка, получаемая путем добавления +1 или -1 к координате Y опорной точки, которая была непосредственно предшествующей опорной точкой, представляющей интерес, становится новой опорной точкой, представляющей интерес. Таким образом, когда компонент Y значения vy вектора движения положительный, точка, получаемая путем добавления +1 к координате Y опорной точки, которая была непосредственно предшествующей опорной точкой, представляющей интерес, становится новой опорной точкой, представляющей интерес. Когда компонент Y значения vy вектора движения отрицательный, точка, полученная путем добавления -1 к координате Y опорной точки, которая была непосредственно предшествующей опорной точкой, представляющей интерес, становится новой опорной точкой, представляющей интерес.

Следует отметить, что, когда моменты времени изменения Тсх и Тсу равны, точка, получаемая путем добавления +1 или -1 к обеим из этих координаты X и координаты Y опорной точки, которая была непосредственно предшествующей опорной точкой, представляющей интерес, становится новой опорной точкой, представляющей интерес.

Здесь, на фиг.33 и 34, в момент времени T=tsfa область поперечного сечения в положении (x, y) перемещается на величину движения, выраженную как вектор (vx, vy)=(+2, -1) движения в пределах времени Tf, и в момент времени T=tsfb (=tsfa+Tf) перемещается в положение (x+2, y-1).

На фиг.33 и 34 время Т=γ представляет собой время изменения ТСХ; когда переменная N в уравнении (12) равна 1. В уравнении (12), когда Tf=tsfb-tsfa, N=1, и vx=+2, время Тсх=γ изменения может быть получено в соответствии с уравнением (tsfb-tsfa)×1/|+2|.

Далее, со ссылкой на блок-схему последовательности операций, показанную на фиг.35, будет подробно описана обработка интегрирования интенсивности света, выполняемая на этапе ST400 по фиг.20, которая была описана со ссылкой на фиг.23.

На этапе ST1001 направление mv линии взгляда в каждом пикселе в поле, представляющем интерес, которое детектируют на этапе ST200 по фиг.20, передают из модуля 100 детектирования движения (фиг.1) в модуль 300 интегрирования интенсивности света. Кроме того, информацию SF управления излучением света, обозначающую структуру излучения света подполей для поля, представляющего интерес, которое было сгенерировано на этапе ST300 по фиг.20, передают из модуля 200 формирования подполя (фиг.1) в модуль 300 интегрирования интенсивности света.

Здесь этап ST1001 соответствует этапу ST401 на фиг.23.

После этого обработка переходит с этапа ST1001 на этап ST1002, и в модуле 300 интегрирования интенсивности света (фиг.8) схема 301 определения области интегрирования интенсивности света выбирает среди пикселей, составляющих поле, представляющее интерес, один из пикселей, который не был выбран как пиксель, представляющий интерес, в качестве пикселя, представляющего интерес. Обработка переходит на этап ST1003.

На этапе ST1003 схема 301 определения области интегрирования интенсивности света устанавливает (выбирает) для пикселя, представляющего интерес, опорную точку, которая используется как исходная (первая) опорная точка, представляющая интерес, среди опорных точек в модели дисплея на основе направления mv линии взгляда в пикселе, представляющем интерес. Обработка переходит на этап ST1004.

На этапе ST1004 схема 301 определения области интегрирования интенсивности света получает для пикселя, представляющего интерес, моменты времени изменения, в которые опорная точка, представляющая интерес, изменяется, как было описано в уравнениях (12) и (13). Кроме того, в каждый момент времени изменения схема 301 определения области интегрирования интенсивности света получает опорную точку, которая используется как новая опорная точка, представляющая интерес. Обработка переходит на этап ST1005.

На этапе ST1005 схема 301 определения области интегрирования света получает область интегрирования интенсивности света, используя направление mv линии взгляда в пикселе, представляющем интерес, моменты времени изменения, полученные на этапе ST1004, и опорную точку, используемую как новая опорная точка, представляющая интерес, в каждый момент времени изменения.